1.本发明涉及人工智能技术领域,尤其涉及一种基于人工智能的静默语音识别的方法、装置、电子设备及计算机可读存储介质。

背景技术:

2.随着语音识别技术的飞速发展,语音接口已经成为当今智能设备(例如:智能手机、智能手表、笔记本电脑)的标准配置。然而,传统的有声语音交互存在以下几个缺点:第一,有声说话在某些情况下是不合适的,例如在开会或者身边有人睡觉的时候。第二,当周围环境非常复杂的时候,如马路上有交通噪音、工业机械噪音等。第三,在公共区域,由于隐私泄露的风险,人们不太愿意使用语音输入。这些传统有声语音交互的缺点,严重限制了语音接口在日常生活中使用的场景。

3.为此,静默语音识别作为一种新的技术,越来越多的进入到人们的生活中,其具体指的是通过非声音信号来对用户说话的内容进行识别。目前业界的一些主流的方法是基于计算机视觉技术来实现的,通过深度视觉神经网络技术,来捕捉嘴唇运动的视觉特征,从而达到语音识别的目的。然而,这些视觉方法都是高度复杂的,并且对光照条件非常敏感,这就意味着它们在黑暗的环境中不能工作。

4.另外,还有一些方法是在用户面部佩戴各种的语音传感器,如emg,rfid,骨传导振动传感器等等,对用户的侵入性很强,对设备的要求较高。还有一类方法使用的是超声波,高频超声波在医学语音中的应用很广,为一些失语患者提供一种发声的方案。然而,这些方法需要使用特殊的超声成像设备,成本较高,适用范围受限,不方便日常使用。

技术实现要素:

5.本发明提供一种基于人工智能的静默语音识别方法、装置、电子设备及计算机可读存储介质,其主要目的在于提高静默语音识别的便捷性和准确性。

6.为实现上述目的,本发明提供的一种基于人工智能的静默语音识别方法,所述方法包括:

7.获取与终端设备发射的静默信号相对应的嘴部运动的反馈信号;

8.对所述反馈信号进行预处理,获取与所述反馈信号对应的相位信号;

9.基于所述相位信号获取与所述嘴部运动对应的相位特征信号;

10.基于所述相位特征信号对预设神经网格模型进行训练,直至所述神经网络模型收敛在预设范围内,形成文字识别模型;

11.基于所述文字识别模型对嘴部运动发出的静默语音信号进行识别。

12.此外,可选的技术方案是,所述获取与终端设备发射的静默信号相对应的嘴部运动的反馈信号的步骤包括:

13.预设启动信号作为所述静默信号的启动条件;

14.基于所述启动条件通过所述终端设备向待检测的嘴部发射所述静默信号;

15.获取经嘴部运动反射回来的与所述静默信号相对应的反馈信号。

16.此外,可选的技术方案是,所述对所述反馈信号进行预处理,获取与所述反馈信号对应的相位信号的步骤包括:

17.对所述反馈信号进行低通滤波处理,获取与所述反馈信号相对应且相互正交的同向分量i和正交分量q;

18.基于所述同向分量i和所述正交分量q,获取与所述反馈信号对应的复合信号;

19.基于所述复合信号确定与所述反馈信号对应的相位信号。

20.此外,可选的技术方案是,所述反馈信号的表达公式如下:

[0021][0022]

所述同向分量i的表达公式如下:

[0023][0024]

所述正交分量q的表达公式如下:

[0025][0026]

其中,所述复合信号的表达公式如下:

[0027][0028]

其中,c表示声音的传播速度,θ

p

表示所述反馈信号的相位偏移量,a

p

表示所述反馈信号的振幅,表示所述反馈信号的相位,p表示传播,d

p

(t)表示传播路径,f表示频率,t表示时间。

[0029]

此外,可选的技术方案是,所述基于所述相位信号获取与所述嘴部运动对应的相位特征信号的步骤包括:

[0030]

分别获取不同频率的发射波的相位信号;其中,所述静默信号包括同时发射的不同频率的多个发射波;

[0031]

基于预设采样时间获取同一频率下相位信号的一阶相位差和二阶相位差;

[0032]

基于所有频率的相位信号的一阶相位差和二阶相位差,获取所述相位特征信号。

[0033]

此外,可选的技术方案是,所述静默信号的表达公式如下:

[0034]

a∑

k

cos[2π(f+kδf)t]

[0035]

t时刻的一阶相位差的表达公式如下:

[0036][0037]

t时刻的二阶相位差的表达公式如下:

[0038][0039]

其中,a表示振幅,k表示第k个发射波,f表示频率,δf表示相邻发射波之间的频率差,t表示时间,表示所述相位信号的相位。

[0040]

此外,可选的技术方案是,所述文字识别模型的形成步骤包括:

[0041]

对所述相位特征信号进行切割处理,获取相互重叠的切片数据;

[0042]

将所述切片数据输入所述神经网络模型的编码部分,获取与所述切片数据相对应的编码输出;

[0043]

将所述编码输出输入所述神经网络模型的解码部分,获取与所述相位特征信号对应的预测文本标签;

[0044]

基于所述预测文本标签的条件概率,确定与所述嘴部的运动相对应的识别结果;

[0045]

基于所述识别结果的损失函数,训练完成所述文字识别模型。

[0046]

为了解决上述问题,本发明还提供一种基于人工智能的静默语音识别装置,所述装置包括:

[0047]

反馈信号获取单元,用于获取与终端设备发射的静默信号相对应的嘴部运动的反馈信号;

[0048]

相位信号获取单元,用于对所述反馈信号进行预处理,获取与所述反馈信号对应的相位信号;

[0049]

相位特征信号获取单元,用于基于所述相位信号获取与所述嘴部运动对应的相位特征信号;

[0050]

文字识别模型形成单元,用于基于所述相位特征信号对预设神经网格模型进行训练,直至所述神经网络模型收敛在预设范围内,形成文字识别模型;

[0051]

识别单元,用于基于所述文字识别模型对嘴部运动发出的静默语音信号进行识别。

[0052]

为了解决上述问题,本发明还提供一种电子设备,所述电子设备包括:

[0053]

存储器,存储至少一个指令;及

[0054]

处理器,执行所述存储器中存储的指令以实现上述所述的基于人工智能的静默语音识别方法。

[0055]

为了解决上述问题,本发明还提供一种计算机可读存储介质,所述计算机可读存储介质中存储有至少一个指令,所述至少一个指令被电子设备中的处理器执行以实现上述所述的基于人工智能的静默语音识别方法。

[0056]

本发明实施例通过可通过终端设备发射静默信号,然后获取与终端设备发射的静默信号相对应的嘴部运动的反馈信号,进而对该反馈信号进行调制解调,以获取对应的相位信息,能够代替传统的多普勒信号,实现基于端到端模型识别用户说话的文字,提高静默信号的识别精确;此外,还可以应用至传统有声识别系统无法工作的场景,例如,图书馆、会议室等安静的环境,以及地铁、马路等嘈杂的环境中,从而实现静默语音识别的便捷性。

附图说明

[0057]

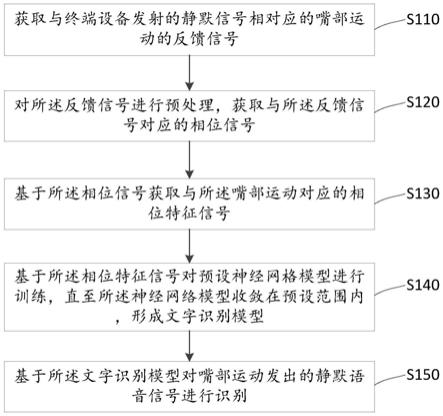

图1为本发明一实施例提供的基于人工智能的静默语音识别方法的流程示意图;

[0058]

图2为本发明一实施例提供的神经网络模型的结构示意图;

[0059]

图3为本发明一实施例提供的基于人工智能的静默语音识别装置的模块示意图;

[0060]

图4为本发明一实施例提供的实现基于人工智能的静默语音识别方法的电子设备的内部结构示意图;

[0061]

本发明目的的实现、功能特点及优点将结合实施例,参照附图做进一步说明。

具体实施方式

[0062]

应当理解,此处所描述的具体实施例仅仅用以解释本发明,并不用于限定本发明。

[0063]

为解决现有静默语音识别存在的准确度差,对识别环境要求较高,例如,需要光照辅助进行嘴唇运动,以及,需要辅助一定的外部设备(例如,emg,rfid,骨传导振动传感器等等,对用户的侵入性很强)等方案存在的各种问题,本发明提供一种基于人工智能的静默语音识别方法,利用反馈信号的相位信息来分析嘴部的细粒度动作,能够提高静默语音识别的精度,进而实现对各种环境下的静默语音识别的有效识别。

[0064]

本发明提供一种基于人工智能的静默语音识别方法,本技术实施例可以基于人工智能技术对相关的数据进行获取和处理。其中,人工智能(artificial intelligence,ai)是利用数字计算机或者数字计算机控制的机器模拟、延伸和扩展人的智能,感知环境、获取知识并使用知识获得最佳结果的理论、方法、技术及应用系统。

[0065]

人工智能基础技术一般包括如传感器、专用人工智能芯片、云计算、分布式存储、大数据处理技术、操作/交互系统、机电一体化等技术。人工智能软件技术主要包括计算机视觉技术、机器人技术、生物识别技术、语音处理技术、自然语言处理技术以及机器学习/深度学习等几大方向。

[0066]

本发明提供一种基于人工智能的静默语音识别方法。参照图1所示,为本发明一实施例提供的基于人工智能的静默语音识别方法的流程示意图。该方法可以由一个装置执行,该装置可以由软件和/或硬件实现。

[0067]

在本实施例中,基于人工智能的静默语音识别方法包括:

[0068]

s100:获取与终端设备发射的静默信号相对应的嘴部运动的反馈信号。

[0069]

s200:对所述反馈信号进行预处理,获取与反馈信号对应的相位信号。

[0070]

s300:基于所述相位信号获取与所述嘴部运动对应的相位特征信号。

[0071]

s400:基于所述相位特征信号对预设神经网格模型进行训练,直至所述神经网络模型收敛在预设范围内,形成文字识别模型。

[0072]

s500:基于所述文字识别模型对嘴部运动发出的静默语音信号进行识别。

[0073]

具体地,在上述步骤s100中,获取与终端设备发射的静默信号相对应的嘴部运动的反馈信号的步骤可进一步包括:

[0074]

s110:预设启动信号作为所述静默信号的启动条件;

[0075]

s120:基于所述启动条件通过所述终端设备向待检测的嘴部发射所述静默信号;

[0076]

s130:获取经嘴部运动反射回来的与所述静默信号相对应的反馈信号。

[0077]

具体地,当用户对终端设备(例如,手机、pad、智能音箱、智能穿戴类)进行讲话时,即当终端设备获取当前用户存在嘴部运动时,可通过终端设备内的扬声器等装置发出预设频率的静默信号,并通过嘴部运动后反射回终端设备,此时,可通过终端设备内的麦克风等装置接收该嘴部运动后反射回来的反馈信号,以便后续对该反馈信号进行处理,识别用户说话的具体内容。

[0078]

此外,在发射静默信号之前,可设置发射静默信号的启动条件,例如,可设置对应的启动信号,当终端检测到该启动信号时,即可向用户的目标区域发射对应的静默信号,该启动信号可以为特定的语音或启动按钮等。

[0079]

在该步骤中,上述预设频率主要是人耳不能听到的超声波频率,具体可根据使用

环境或需求进行设置,通常高于17khz的声波是人耳不能听到的,可据此设置预设频率的大小及个数。

[0080]

具体地,在上述步骤s200中,对所述反馈信号进行预处理,获取与所述反馈信号对应的相位信号的步骤可进一步包括:

[0081]

s210:对所述反馈信号进行低通滤波处理,获取与所述反馈信号相对应且相互正交的同向分量i和正交分量q。

[0082]

其中,假设静默信号表示为acos(2πft),a表示振幅,t表示采样时间,f表示静默信号的频率,假设只有一个传播路径d

p

(t),p表示传播,因此,对应的反馈信号的表达公式可如下:

[0083][0084]

其中,c表示声音的传播速度,θ

p

表示所述反馈信号的相位偏移量,a

p

表示所述反馈信号的振幅,表示所述反馈信号的相位,p表示传播,d

p

(t)表示传播路径,f表示频率,t表示时间。然后,将接受到的反馈信号乘以cos(2πft)以便进行各分量的获取,乘积处理后的信号可表示为:

[0085][0086]

在上述表达式中,第一项视频流为2f的高频信号,可通过低通滤波器lpf进行去除,然后可获取同向分量i,其表达公式如下:

[0087][0088]

同理,可获取所述正交分量q,其表达公式如下:

[0089][0090]

s220:基于所述同向分量i和所述正交分量q,获取与所述反馈信号对应的复合信号。

[0091]

其中,上述同向分量i和正交分量q,相互结合在一起,组合为复合信号的实部和虚部,对应的复合信号的表达公式如下:

[0092][0093]

其中,a

p

和均可通过上述各公式进行确定,进而确定相位信号的表达公式,即下述s230步骤中的内容。

[0094]

s230:基于所述复合信号确定与所述反馈信号对应的相位信号。

[0095]

在上述步骤s300中,由于不同频率的无线信号在空气中传播时,会形成多径效应,产生各自不同的多径衰减。为此,在发射静默信号时,可以同时发射多个频率不同的声波信号(或发射波,下同),以减轻频率选择性衰减,并增强刻画多径环境的能力。

[0096]

为此,在实例性的实施例中,步骤s300基于所述相位信号获取与所述嘴部运动对应的相位特征信号的步骤可进一步包括:

[0097]

s310:分别获取不同频率的发射波的相位信号;其中,所述静默信号包括同时发射的不同频率的多个发射波。

[0098]

s320:基于预设采样时间获取同一频率下相位信号的一阶相位差和二阶相位差。

[0099]

s330:基于所有频率的相位信号的一阶相位差和二阶相位差,获取所述相位特征信号。

[0100]

具体地,终端设备所发出的静默信号可表示为

[0101]

a∑

k

cos[2π(f+kδf)t]

[0102]

其中,a表示振幅,k表示第k个发射波,f表示频率,δf表示相邻发射波之间的频率差,t表示时间,

[0103]

进而,根据采样时间可获取同一频率下的联系两个相位信号之间的一阶相位差和二阶相位差,t时刻的一阶相位差的表达公式如下:

[0104][0105]

所述t时刻的二阶相位差的表达公式如下:

[0106][0107]

其中,a表示振幅,k表示第k个发射波,f表示频率,δf表示相邻发射波之间的频率差,t表示时间,表示所述相位信号的相位。

[0108]

根据上述公式,可获取所有频率下的发射波的相位信号的一阶相位差和二阶相位差,进而对所有频率下的一阶相位差和二阶相位差进行拼接,组成最终的相位特征信号x(t),作为文字识别模型的输入特征或输入信号,其中,行为特征信号可表示为:

[0109]

x(t)=[δφ

p1

(t),δδφ

p1

(t),φ

p2

(t),δδφ

p2

(t)...φ

pk

(t),δδφ

pk

(t)]

[0110]

其中,p表示传播,t表示采样时间,k表示第k个静默信号发射波,表示t时刻的一阶相位差,表示t时刻的二阶相位差。

[0111]

在上述步骤s400中,所述文字识别模型的形成步骤包括:

[0112]

s410:对所述相位特征信号进行切割处理,获取相互重叠的切片数据。

[0113]

其中,在对相位特征信号进行切割的过程中,可确保各切片的长度相同,但是相互之间存在部分重叠的相位特征信息,将切片数据作为输入信号输入神经网络模型中进行训练。假设输入信号共有n个切片,对于第n个切片,输入数据可表示为:

[0114]

x

n(t

×

d)

=[x(τ),x(τ+1),x(τ+2),

…

,x(τ+t

‑

1)]

[0115]

进而,第n+1个切片可表示为:

[0116]

x

n+1(t

×

d)

=[x(τ+t

‑

1),x(τ+t),x(τ+t+1),

…

,x(τ+2t

‑

2)]

[0117]

其中,d表示相位特征信号的维度、τ表示当前切片的开始时间,t表示每个切片的时间长度。可知,上述第n个切片和第n+1个切片存在一个x(τ+t

‑

1)的重合相位特征信息,以此类推,可确定n个切片的具体表示,此外,相邻切片的重叠部分不限于上述一个相位特征信息的情况,重叠部分的长度可根据需求进行灵活的调整和设置。

[0118]

可知,相对传统的采用多普勒频移来估计运动轨迹的方法存在的分辨率也有限,

很难捕捉嘴唇运动这种细颗粒度的动作,本提案利用反馈信号的相位信息来分析嘴部的细粒度动作,能够提高静默语音识别的精度,进而实现对各种环境下的静默语音识别的有效识别。

[0119]

s420:将所述切片数据输入所述神经网络模型的编码部分,获取与所述切片数据相对应的编码输出。

[0120]

其中,神经网络模型可包括解码部分(解码器)和编码部分(编码器),编码部分包括输入层、cnn层、lstm层和输出层;其中,切片数据通过输入层后进入cnn层,通过cnn层获取每个切片数据的特征表示,然后将特征表述输入2层的lstm层中,对特征表述进行时域变化,输出对应的隐变量,然后将隐变量在时域上进行倒置,以缩短信号流和预测文本标签之间的长期依赖关系。

[0121]

具体地在该步骤中,将所有的切片作为输出数据输入神经网络模型的编码部分的nn层,获取每个切片的特征表示fn如下:

[0122]

f

n

=cnn

×3(x

n

)

[0123]

其中,公式中的3表示编码部分的cnn网络有3层的具体示例,在应用过程中,也可以根据使用场景及要求灵活设置神经网络模型的结构。

[0124]

然后,将特征表述输入2层的lstm层中,对特征表述进行时域变化,获取与特征表述对应的隐变量on,该隐变量可表示为:

[0125]

o

n

=lstm

enc

(f

n

,o

n+1

)

[0126]

然后,对上述隐变量进行时域上的倒置处理,以缩短信号流和预测文本标签之间的长期依赖关系,最终编码器的输出可表示为:

[0127]

o=[o

n

,o

n

‑1,

…

,o1]

[0128]

其中,n表示隐变量的个数,与切片的个数是相对应的,具体可将最后一个列向量o1作为整个编码部分的特征表示,并输入解码部分中。

[0129]

s430:将所述编码输出输入所述神经网络模型的解码部分,获取与所述相位特征信号对应的预测文本标签。

[0130]

其中,解码部分可包括lstm层、自注意力层和全连接层,编码部分的lstm层输出可输入解码部分的lstm层中,编码部分的输出层直接与解码部分的自注意力层连接,最终通过全连接层后输出文本标签的概率。通过解码部分对编码器的输出进行刻画,同时采用自注意力机制使得神经网络模型学习编码器输出的特征序列的特定位置,并为每一个编码器的输出状态on分配对应的权重α,权重公式可表示为:

[0131]

α

u

=attention(h

u

‑1,o)

[0132]

其中,h表示在解码器中与编码器的隐变量o

n

相对应的隐状态,其中,初始状态h0是与o1相对应的,u表示解码器的解码步数,即预测出的字的个数,针对每一次解码,均能获取一个对应的文本标签的概率分布。

[0133]

因此,在解码器的每一次解码过程中,会对应生成一个上下文向量c

u

:

[0134]

c

u

=o

·

α

u

[0135]

然后,解码器的每一次解码的预测结果y

u

和隐状态h

u

都能够通过上一步的预测结果进行更新,表示如下:

[0136]

y

u

,h

u

=lstm

dec

(h

u

‑1,c

u

,g

u

‑1)

[0137]

其中,y

u

表示解码器的输出结果,即预测的文本标签的概率,u表示当前个数,g

u

‑1表示上一步预测文本的特征表示,h

u

‑1表示上一解码过程的历史隐状态,进而可根据上一步解码器的预测结果对当前结果进行迭代预测。

[0138]

作为具体示例,图2示出根据本发明实施例的神经网络模型的示意结构。

[0139]

如图2所示,在特征学习部分(featuer learning)的编码部分(encoder)的每个输入x

n

均依次通过cnn网络和lstm进行处理,且每个lsmt的输出均基于前一个lsmt的输出结果以及对应的切片的特征表示f

n

,因此,可将特征表示f1所对应的o1作为word embedding解码器(decoder)的lsmt的输入,同时将编码部分的输出层的数据o直接输入解码器的自注意力层(attention layer),最终通过解码器的全连接层fc和输出层输出各文本标签的概率,即最终的y1至y

u

。

[0140]

s440:基于所述预测文本标签的条件概率,确定与所述嘴部的运动相对应的识别结果。

[0141]

其中,y

u

是神经网络模型预测的文本标签,因此,每一步解码u的文本标签y

u

都可通过上述公式进行表达,进而对于整个输入信号流x和对应的识别文本序列y的条件概率可表示为:

[0142]

号,对应的输出结果可以为一个句子,因此,该识别文本序列y的条件概率,为所有预测出的文本标签的概率的乘积,进而通过条件概率的最大概率即可确定最终的预测文本,作为识别结果。

[0143]

例如,对于每一步文本标签的后验概率分布,可采用束搜索算法得到最终的文字识别结果y,如下:

[0144]

y=[y1,y2,

…

,y

u

]

[0145]

s450:基于所述识别结果的损失函数,训练完成所述文字识别模型。

[0146]

其中,在神经网络模型的训练过程中,可使用损失函数,例如交叉熵损失函数,更新神经网络模型的参数,直至损失函数收敛在预设范围内,完成文字识别模型的训练。

[0147]

根据本发明提供的基于人工智能的静默语音识别方法,可使用智能手机的扬声器发射超声波,然后通过麦克风接收嘴唇移动的方式,来进行静默无声的语音识别,其中使用调制解调的方式来提取信号相位信息,代替传统的多普勒信号,并基于自注意力机制的端到端模型来识别用户说话的文字。可以应用在许多传统有声语音识别系统无法有效工作的场景中。例如,图书馆等需要特别安静的环境,地铁马路等特别嘈杂的环境;此外,本方法中的静默识别还可以和有声识别进行结合,从而进一步提高语音识别文字的准确率

[0148]

如图3所示,是本发明基于人工智能的静默语音识别装置的功能模块图。

[0149]

本发明所述基于人工智能的静默语音识别装置200可以安装于电子设备中。根据实现的功能,所述基于人工智能的静默语音识别装置可以包括:反馈信号获取单元210、相位信号获取单元220、相位特征信号获取单元230、文字识别模型形成单元240和识别单元250。本发所述单元也可以称之为模块,是指一种能够被电子设备处理器所执行,并且能够完成固定功能的一系列计算机程序段,其存储在电子设备的存储器中。

[0150]

在本实施例中,关于各模块/单元的功能如下:

[0151]

反馈信号获取单元210,用于获取与终端设备发射的静默信号相对应的嘴部运动的反馈信号。

[0152]

相位信号获取单元220,用于对所述反馈信号进行预处理,获取与所述反馈信号对应的相位信号。

[0153]

相位特征信号获取单元230,用于基于所述相位信号获取与所述嘴部运动对应的相位特征信号。

[0154]

文字识别模型形成单元240,用于基于所述相位特征信号对预设神经网格模型进行训练,直至神经网络模型收敛在预设范围内,形成文字识别模型。

[0155]

识别单元250,用于基于所述文字识别模型对嘴部运动发出的静默语音信号进行识别。

[0156]

具体地,在上述反馈信号获取单元210中,获取与终端设备发射的静默信号相对应的嘴部运动的反馈信号可进一步包括:

[0157]

条件预设模块,用于预设启动信号作为所述静默信号的启动条件;

[0158]

静默信号发射模块,用于基于所述启动条件通过所述终端设备向待检测的嘴部发射所述静默信号;

[0159]

反馈信号获取模块,用于获取经嘴部运动反射回来的与所述静默信号相对应的反馈信号。

[0160]

具体地,当用户对终端设备(例如,手机、pad、智能音箱、智能穿戴类)进行讲话时,即当终端设备获取当前用户存在嘴部运动时,可通过终端设备内的扬声器等装置发出预设频率的静默信号,并通过嘴部运动后反射回终端设备,此时,可通过终端设备内的麦克风等装置接收该嘴部运动后反射回来的反馈信号,以便后续对该反馈信号进行处理,识别用户说话的具体内容。

[0161]

此外,在发射静默信号之前,可设置发射静默信号的启动条件,例如,可设置对应的启动信号,当终端检测到该启动信号时,即可向用户的目标区域发射对应的静默信号,该启动信号可以为特定的语音或启动按钮等。

[0162]

在该步骤中,上述预设频率主要是人耳不能听到的超声波频率,具体可根据使用环境或需求进行设置,通常高于17khz的声波是人耳不能听到的,可据此设置预设频率的大小及个数。

[0163]

具体地,在上述相位信号获取单元220中,对所述反馈信号进行预处理,获取与所述反馈信号对应的相位信号可进一步包括:

[0164]

分量获取模块,用于对所述反馈信号进行低通滤波处理,获取与所述反馈信号相对应且相互正交的同向分量i和正交分量q。

[0165]

其中,假设静默信号表示为acos(2πft),a表示振幅,t表示采样时间,f表示静默信号的频率,假设只有一个传播路径d

p

(t),p表示传播,因此,对应的反馈信号的表达公式可如下:

[0166]

[0167]

其中,c表示声音的传播速度,θ

p

表示所述反馈信号的相位偏移量,a

p

表示所述反馈信号的振幅,表示所述反馈信号的相位,p表示传播,d

p

(t)表示传播路径,f表示频率,t表示时间。然后,将接受到的反馈信号乘以cos(2πft)以便进行各分量的获取,乘积处理后的信号可表示为:

[0168][0169]

在上述表达式中,第一项视频流为2f的高频信号,可通过低通滤波器lpf进行去除,然后可获取同向分量i,其表达公式如下:

[0170][0171]

同理,可获取所述正交分量q,其表达公式如下:

[0172][0173]

符合信号获取模块,用于基于所述同向分量i和所述正交分量q,获取与所述反馈信号对应的复合信号。

[0174]

其中,上述同向分量i和正交分量q,相互结合在一起,组合为复合信号的实部和虚部,对应的复合信号的表达公式如下:

[0175][0176]

其中,a

p

和均可通过上述各公式进行确定,进而确定相位信号的表达公式,即下述s230步骤中的内容。

[0177]

相位信号确定模块,用于基于所述复合信号确定与所述反馈信号对应的相位信号。

[0178]

在上述相位特征信号获取单元230中,由于不同频率的无线信号在空气中传播时,会形成多径效应,产生各自不同的多径衰减。为此,在发射静默信号时,可以同时发射多个频率不同的声波信号(或发射波,下同),以减轻频率选择性衰减,并增强刻画多径环境的能力。

[0179]

为此,在实例性的实施例中,相位特征信号获取单元230,基于所述相位信号获取与所述嘴部运动对应的相位特征信号可进一步包括:

[0180]

相位信号分别获取模块,用于分别获取不同频率的发射波的相位信号;其中,所述静默信号包括同时发射的不同频率的多个发射波。

[0181]

相位差获取模块,用于基于预设采样时间获取同一频率下相位信号的一阶相位差和二阶相位差。

[0182]

相位特征信号获取模块,用于基于所有频率的相位信号的一阶相位差和二阶相位差,获取所述相位特征信号。

[0183]

具体地,终端设备所发出的静默信号可表示为

[0184]

a∑

k

cos[2π(f+kδf)t]

[0185]

其中,a表示振幅,k表示第k个发射波,f表示频率,δf表示相邻发射波之间的频率差,t表示时间,

[0186]

进而,根据采样时间可获取同一频率下的联系两个相位信号之间的一阶相位差和二阶相位差,t时刻的一阶相位差的表达公式如下:

[0187][0188]

所述t时刻的二阶相位差的表达公式如下:

[0189][0190]

其中,a表示振幅,k表示第k个发射波,f表示频率,δf表示相邻发射波之间的频率差,t表示时间,表示所述相位信号的相位。

[0191]

根据上述公式,可获取所有频率下的发射波的相位信号的一阶相位差和二阶相位差,进而对所有频率下的一阶相位差和二阶相位差进行拼接,组成最终的相位特征信号x(t),作为文字识别模型的输入特征或输入信号,其中,行为特征信号可表示为:

[0192]

x(t)=[δφ

p1

(t),δδφ

p1

(t),φ

p2

(t),δδφ

p2

(t)...φ

pk

(t),δδφ

pk

(t)]

[0193]

其中,p表示传播,t表示采样时间,k表示第k个静默信号发射波,表示t时刻的一阶相位差,表示t时刻的二阶相位差。

[0194]

在上述文字识别模型形成单元240中,所述文字识别模型的形成可包括:

[0195]

切片数据获取模块,用于对所述相位特征信号进行切割处理,获取相互重叠的切片数据。

[0196]

其中,在对相位特征信号进行切割的过程中,可确保各切片的长度相同,但是相互之间存在部分重叠的相位特征信息,将切片数据作为输入信号输入神经网络模型中进行训练。假设输入信号共有n个切片,对于第n个切片,输入数据可表示为:

[0197]

x

n(t

×

d)

=[x(τ),x(τ+1),x(τ+2),

…

,x(τ+t

‑

1)]

[0198]

进而,第n+1个切片可表示为:

[0199]

x

n+1(t

×

d)

=[x(τ+t

‑

1),x(τ+t),x(τ+t+1),

…

,x(τ+2t

‑

2)]

[0200]

其中,d表示相位特征信号的维度、τ表示当前切片的开始时间,t表示每个切片的时间长度。可知,上述第n个切片和第n+1个切片存在一个x(τ+t

‑

1)的重合相位特征信息,以此类推,可确定n个切片的具体表示,此外,相邻切片的重叠部分不限于上述一个相位特征信息的情况,重叠部分的长度可根据需求进行灵活的调整和设置。

[0201]

可知,相对传统的采用多普勒频移来估计运动轨迹的方法存在的分辨率也有限,很难捕捉嘴唇运动这种细颗粒度的动作,本提案利用反馈信号的相位信息来分析嘴部的细粒度动作,能够提高静默语音识别的精度,进而实现对各种环境下的静默语音识别的有效识别。

[0202]

编码输出获取模块,用于将所述切片数据输入所述神经网络模型的编码部分,获取与所述切片数据相对应的编码输出。

[0203]

其中,神经网络模型可包括解码部分(解码器)和编码部分(编码器),编码部分包括输入层、cnn层、lstm层和输出层;其中,切片数据通过输入层后进入cnn层,通过cnn层获

取每个切片数据的特征表示,然后将特征表述输入2层的lstm层中,对特征表述进行时域变化,输出对应的隐变量,然后将隐变量在时域上进行倒置,以缩短信号流和预测文本标签之间的长期依赖关系。

[0204]

具体地在该步骤中,将所有的切片作为输出数据输入神经网络模型的编码部分的nn层,获取每个切片的特征表示fn如下:

[0205]

f

n

=cnn

×3(x

n

)

[0206]

其中,公式中的3表示编码部分的cnn网络有3层的具体示例,在应用过程中,也可以根据使用场景及要求灵活设置神经网络模型的结构。

[0207]

然后,将特征表述输入2层的lstm层中,对特征表述进行时域变化,获取与特征表述对应的隐变量on,该隐变量可表示为:

[0208]

o

n

=lstm

enc

(f

n

,o

n+1

)

[0209]

然后,对上述隐变量进行时域上的倒置处理,以缩短信号流和预测文本标签之间的长期依赖关系,最终编码器的输出可表示为:

[0210]

o=[o

n

,o

n

‑1,

…

,o1]

[0211]

其中,n表示隐变量的个数,与切片的个数是相对应的,具体可将最后一个列向量o1作为整个编码部分的特征表示,并输入解码部分中。

[0212]

预测文本标签获取模块,用于将所述编码输出输入所述神经网络模型的解码部分,获取与所述相位特征信号对应的预测文本标签。

[0213]

其中,解码部分可包括lstm层、自注意力层和全连接层,编码部分的lstm层输出可输入解码部分的lstm层中,编码部分的输出层直接与解码部分的自注意力层连接,最终通过全连接层后输出文本标签的概率。通过解码部分对编码器的输出进行刻画,同时采用自注意力机制使得神经网络模型学习编码器输出的特征序列的特定位置,并为每一个编码器的输出状态on分配对应的权重α,权重公式可表示为:

[0214]

α

u

=attention(h

u

‑1,o)

[0215]

其中,h表示在解码器中与编码器的隐变量o

n

相对应的隐状态,其中,初始状态h0是与o1相对应的,u表示解码器的解码步数,即预测出的字的个数,针对每一次解码,均能获取一个对应的文本标签的概率分布。

[0216]

因此,在解码器的每一次解码过程中,会对应生成一个上下文向量c

u

:

[0217]

c

u

=o

·

α

u

[0218]

然后,解码器的每一次解码的预测结果y

u

和隐状态h

u

都能够通过上一步的预测结果进行更新,表示如下:

[0219]

y

u

,h

u

=lstm

dec

(h

u

‑1,c

u

,g

u

‑1)

[0220]

其中,y

u

表示解码器的输出结果,即预测的文本标签的概率,u表示当前个数,g

u

‑1表示上一步预测文本的特征表示,h

u

‑1表示上一解码过程的历史隐状态,进而可根据上一步解码器的预测结果对当前结果进行迭代预测。

[0221]

识别结果确定模块,用于基于所述预测文本标签的条件概率,确定与所述嘴部的运动相对应的识别结果。

[0222]

其中,y

u

是神经网络模型预测的文本标签,因此,每一步解码u的文本标签y

u

都可通过上述公式进行表达,进而对于整个输入信号流x和对应的识别文本序列y的条件概率可表

示为:

[0223]

号,对应的输出结果可以为一个句子,因此,该识别文本序列y的条件概率,为所有预测出的文本标签的概率的乘积,进而通过条件概率的最大概率即可确定最终的预测文本,作为识别结果。

[0224]

例如,对于每一步文本标签的后验概率分布,可采用束搜索算法得到最终的文字识别结果y,如下:

[0225]

y=[y1,y2,

…

,y

u

]

[0226]

文字识别模型训练完成模块,用于基于所述识别结果的损失函数,训练完成所述文字识别模型。

[0227]

其中,在神经网络模型的训练过程中,可使用损失函数,例如交叉熵损失函数,更新神经网络模型的参数,直至损失函数收敛在预设范围内,完成文字识别模型的训练。

[0228]

如图4所示,是本发明实现基于人工智能的静默语音识别方法的电子设备的结构示意图。

[0229]

所述电子设备1可以包括处理器10、存储器11和总线,还可以包括存储在所述存储器11中并可在所述处理器10上运行的计算机程序,如基于人工智能的静默语音识别程序12。

[0230]

其中,所述存储器11至少包括一种类型的可读存储介质,所述可读存储介质包括闪存、移动硬盘、多媒体卡、卡型存储器(例如:sd或dx存储器等)、磁性存储器、磁盘、光盘等。所述存储器11在一些实施例中可以是电子设备1的内部存储单元,例如该电子设备1的移动硬盘。所述存储器11在另一些实施例中也可以是电子设备1的外部存储设备,例如电子设备1上配备的插接式移动硬盘、智能存储卡(smart media card,smc)、安全数字(secure digital,sd)卡、闪存卡(flash card)等。进一步地,所述存储器11还可以既包括电子设备1的内部存储单元也包括外部存储设备。所述存储器11不仅可以用于存储安装于电子设备1的应用软件及各类数据,例如基于人工智能的静默语音识别程序的代码等,还可以用于暂时地存储已经输出或者将要输出的数据。

[0231]

所述处理器10在一些实施例中可以由集成电路组成,例如可以由单个封装的集成电路所组成,也可以是由多个相同功能或不同功能封装的集成电路所组成,包括一个或者多个中央处理器(central processing unit,cpu)、微处理器、数字处理芯片、图形处理器及各种控制芯片的组合等。所述处理器10是所述电子设备的控制核心(control unit),利用各种接口和线路连接整个电子设备的各个部件,通过运行或执行存储在所述存储器11内的程序或者模块(例如基于人工智能的静默语音识别程序等),以及调用存储在所述存储器11内的数据,以执行电子设备1的各种功能和处理数据。

[0232]

所述总线可以是外设部件互连标准(peripheral component interconnect,简称pci)总线或扩展工业标准结构(extended industry standard architecture,简称eisa)总线等。该总线可以分为地址总线、数据总线、控制总线等。所述总线被设置为实现所述存储器11以及至少一个处理器10等之间的连接通信。

[0233]

图4仅示出了具有部件的电子设备,本领域技术人员可以理解的是,图3示出的结构并不构成对所述电子设备1的限定,可以包括比图示更少或者更多的部件,或者组合某些部件,或者不同的部件布置。

[0234]

例如,尽管未示出,所述电子设备1还可以包括给各个部件供电的电源(比如电池),优选地,电源可以通过电源管理装置与所述至少一个处理器10逻辑相连,从而通过电源管理装置实现充电管理、放电管理、以及功耗管理等功能。电源还可以包括一个或一个以上的直流或交流电源、再充电装置、电源故障检测电路、电源转换器或者逆变器、电源状态指示器等任意组件。所述电子设备1还可以包括多种传感器、蓝牙模块、wi

‑

fi模块等,在此不再赘述。

[0235]

进一步地,所述电子设备1还可以包括网络接口,可选地,所述网络接口可以包括有线接口和/或无线接口(如wi

‑

fi接口、蓝牙接口等),通常用于在该电子设备1与其他电子设备之间建立通信连接。

[0236]

可选地,该电子设备1还可以包括用户接口,用户接口可以是显示器(display)、输入单元(比如键盘(keyboard)),可选地,用户接口还可以是标准的有线接口、无线接口。可选地,在一些实施例中,显示器可以是led显示器、液晶显示器、触控式液晶显示器以及oled(organic light

‑

emitting diode,有机发光二极管)触摸器等。其中,显示器也可以适当的称为显示屏或显示单元,用于显示在电子设备1中处理的信息以及用于显示可视化的用户界面。

[0237]

应该了解,所述实施例仅为说明之用,在专利申请范围上并不受此结构的限制。

[0238]

所述电子设备1中的所述存储器11存储的基于人工智能的静默语音识别程序12是多个指令的组合,在所述处理器10中运行时,可以实现:

[0239]

获取与终端设备发射的静默信号相对应的嘴部运动的反馈信号;

[0240]

对所述反馈信号进行预处理,获取与所述反馈信号对应的相位信号;

[0241]

基于所述相位信号获取与所述嘴部运动对应的相位特征信号;

[0242]

基于所述相位特征信号对预设神经网格模型进行训练,直至所述神经网络模型收敛在预设范围内,形成文字识别模型;

[0243]

基于所述文字识别模型对嘴部运动发出的静默语音信号进行识别。

[0244]

此外,可选的技术方案是,所述获取与终端设备发射的静默信号相对应的嘴部运动的反馈信号的步骤包括:

[0245]

预设启动信号作为所述静默信号的启动条件;

[0246]

基于所述启动条件通过所述终端设备向待检测的嘴部发射所述静默信号;

[0247]

获取经嘴部运动反射回来的与所述静默信号相对应的反馈信号。

[0248]

此外,可选的技术方案是,所述对所述反馈信号进行预处理,获取与所述反馈信号对应的相位信号的步骤包括:

[0249]

对所述反馈信号进行低通滤波处理,获取与所述反馈信号相对应且相互正交的同向分量i和正交分量q;

[0250]

基于所述同向分量i和所述正交分量q,获取与所述反馈信号对应的复合信号;

[0251]

基于所述复合信号确定与所述反馈信号对应的相位信号。

[0252]

此外,可选的技术方案是,所述反馈信号的表达公式如下:

[0253][0254]

所述同向分量i的表达公式如下:

[0255][0256]

所述正交分量q的表达公式如下:

[0257][0258]

其中,所述复合信号的表达公式如下:

[0259][0260]

其中,c表示声音的传播速度,θ

p

表示所述反馈信号的相位偏移量,a

p

表示所述反馈信号的振幅,表示所述反馈信号的相位。

[0261]

此外,可选的技术方案是,所述基于所述相位信号获取与所述嘴部运动对应的相位特征信号的步骤包括:

[0262]

分别获取不同频率的发射波的相位信号;其中,所述静默信号包括同时发射的不同频率的多个发射波;

[0263]

基于预设采样时间获取同一频率下相位信号的一阶相位差和二阶相位差;

[0264]

基于所有频率的相位信号的一阶相位差和二阶相位差,获取所述相位特征信号。

[0265]

此外,可选的技术方案是,所述静默信号的表达公式如下:

[0266]

a∑

k

cos[2π(f+kδf)t]

[0267]

所述t时刻的一阶相位差的表达公式如下:

[0268][0269]

所述t时刻的二阶相位差的表达公式如下:

[0270][0271]

其中,a表示振幅,k表示第k个发射波,f表示频率,δf表示相邻发射波之间的频率差,t表示时间,表示所述相位信号的相位。

[0272]

此外,可选的技术方案是,所述文字识别模型的形成步骤包括:

[0273]

对所述相位特征信号进行切割处理,获取相互重叠的切片数据;

[0274]

将所述切片数据输入所述神经网络模型的编码部分,获取与所述切片数据相对应的编码输出;

[0275]

将所述编码输出输入所述神经网络模型的解码部分,获取与所述相位特征信号对应的预测文本标签;

[0276]

基于所述预测文本标签的条件概率,确定与所述嘴部的运动相对应的识别结果;

[0277]

基于所述识别结果的损失函数,训练完成所述文字识别模型。

[0278]

具体地,所述处理器10对上述指令的具体实现方法可参考图1对应实施例中相关步骤的描述,在此不赘述。

[0279]

进一步地,所述电子设备1集成的模块/单元如果以软件功能单元的形式实现并作为独立的产品销售或使用时,可以存储在一个计算机可读取存储介质中。所述计算机可读介质可以包括:能够携带所述计算机程序代码的任何实体或装置、记录介质、u盘、移动硬盘、磁碟、光盘、计算机存储器、只读存储器(rom,read

‑

only memory)。

[0280]

在本发明所提供的几个实施例中,应该理解到,所揭露的设备,装置和方法,可以通过其它的方式实现。例如,以上所描述的装置实施例仅仅是示意性的,例如,所述模块的划分,仅仅为一种逻辑功能划分,实际实现时可以有另外的划分方式。

[0281]

所述作为分离部件说明的模块可以是或者也可以不是物理上分开的,作为模块显示的部件可以是或者也可以不是物理单元,即可以位于一个地方,或者也可以分布到多个网络单元上。可以根据实际的需要选择其中的部分或者全部模块来实现本实施例方案的目的。

[0282]

另外,在本发明各个实施例中的各功能模块可以集成在一个处理单元中,也可以是各个单元单独物理存在,也可以两个或两个以上单元集成在一个单元中。上述集成的单元既可以采用硬件的形式实现,也可以采用硬件加软件功能模块的形式实现。

[0283]

对于本领域技术人员而言,显然本发明不限于上述示范性实施例的细节,而且在不背离本发明的精神或基本特征的情况下,能够以其他的具体形式实现本发明。

[0284]

因此,无论从哪一点来看,均应将实施例看作是示范性的,而且是非限制性的,本发明的范围由所附权利要求而不是上述说明限定,因此旨在将落在权利要求的等同要件的含义和范围内的所有变化涵括在本发明内。不应将权利要求中的任何附关联图标记视为限制所涉及的权利要求。

[0285]

此外,显然“包括”一词不排除其他单元或步骤,单数不排除复数。系统权利要求中陈述的多个单元或装置也可以由一个单元或装置通过软件或者硬件来实现。第二等词语用来表示名称,而并不表示任何特定的顺序。

[0286]

最后应说明的是,以上实施例仅用以说明本发明的技术方案而非限制,尽管参照较佳实施例对本发明进行了详细说明,本领域的普通技术人员应当理解,可以对本发明的技术方案进行修改或等同替换,而不脱离本发明技术方案的精神和范围。