一种5g虚拟现实医学超声实训系统及其方法

技术领域

1.本发明涉及超声诊断技术领域,具体涉及一种5g虚拟现实医学超声实训系统及其方法。

背景技术:

2.b超由于其非侵入和无辐射的特性,目前广泛用于医学诊断领域。由于b超影像需要医生手动制作以获取清晰稳定的b超影像并进行正确识读,上述过程需要长期的经验积累;而且医生临床经验的积累依赖于病例的数量和病种,对于某些罕见病种临床影像,可能需要等待很长的时间才能获得,对于中小型医院,等待的时间则更加漫长。因此,培训一名合格的b超医生一般需要数年的时间。

3.为了解决上述问题,b超模拟仿真应运而生。在现有专利“混合现实仿真方法与系统”(us20140071165)中,介绍了使用混合现实进行医学教育的方法,重点在虚拟场景与物理实体的定位;在专利“使用触控表面进行增强超声仿真”(us20150154890)中,介绍了使用人体模型、电子标签及仿真探头进行b超诊断模拟的方法;在专利“超声仿真方法”(us20180301063)中,介绍了在ar/vr(augmented reality,增强现实/virtual reality,虚拟现实)环境中进行b超仿真的方法。此外,sonosim(https://sonosim.com)和smjp(https://smjpltd.uk)也已经开始提供商业超声仿真教学课程。

4.但是,现有的基于ar/vr的b超模拟仿真系统为了提升可用性,需要专用的硬件如精密的人体模型及真实的超声波探头以建立仿真环境,成本相对较高,且缺少与受诊者的交互,沉浸度较低。

技术实现要素:

5.本发明所要解决的技术问题在于如何提供一种5g虚拟现实医学超声实训系统及其方法以降低训练成本。

6.本发明通过以下技术手段实现解决上述技术问题的:

7.一种虚拟现实医学超声实训方法,所述方法包括:

8.搭建虚拟环境,并获取虚拟环境中各个物理对象的空间位置以及虚拟对象的空间位置,其中,所述物理对象包括:手持vr控制器;虚拟对象包括:虚拟b超机、虚拟病床、虚拟受诊者中的一种或组合;

9.实时监测物理对象的空间坐标以及空间角度;

10.根据所述空间坐标以及空间角度生成对应的虚拟b超探头;

11.根据所述虚拟b超探头与虚拟对象之间的相位位置以及相对角度,生成对应的虚拟b超影像,并展示给受训者;

12.在虚拟环境中的受训者视线范围内生成对应于虚拟b超探头位姿的局部操作镜像,其中,所述局部操作镜像中对应于虚拟b超探头的标记的位姿与虚拟b超探头的位姿实时一致

13.可选的,所述生成对应的虚拟b超影像,包括:

14.根据探查切面获取匹配的真实b超三维影像,并将真实b超三维影像作为虚拟b超影像。

15.可选的,所在所述根据探查切面获取匹配的真实b超三维影像之后,在将真实b超三维影像作为虚拟b超影像之前,所述根据探查切面生成对应的虚拟b超影像的步骤还包括:

16.利用插值算法对预先录制好的、对应于探查切面的真实的b超影像进行缺少视频帧补充。

17.可选的,所述根据探查切面生成对应的虚拟b超影像,包括:

18.依据预先建立的人体数学模型及声波在人体组织中的属性模型,利用生成算法,实时生成虚拟b超影像。

19.可选的,所述方法还包括:

20.获取受训者的语音指令,生成对应指令下的虚拟受诊者,其中,所述语音指令包括:要求虚拟受诊者改变姿态的指令。

21.可选的,所在生成对应指令下的虚拟受诊者步骤之后,所述方法还包括:

22.在虚拟b超探头被改变姿态后的虚拟受诊者的身体遮挡的情况下,在虚拟环境中的受训者视线范围内生成对应于虚拟b超探头位姿的局部操作镜像,其中,所述局部操作镜像中对应于虚拟b超探头的标记的位姿与虚拟b超探头的位姿实时一致。

23.可选的,所述方法还包括:

24.在局部操作镜像中生成操作指引标记,其中,所述操作指引标记包括:虚拟引导线、按压压力指示中的一种或组合。

25.可选的,所在操作指引标记为按压压力指示时,利用不同深度的颜色进行压力高低的区分标记。

26.可选的,所述方法还包括:

27.在基于虚拟环境由教师对受训者进行教学时,在虚拟环境中分别生成相对人的虚拟化形象;

28.教师通过在虚拟环境中拖动受训者的虚拟化形象到指定位置以调节受训者的观察位置,并根据所述观察位置生成针对该受训者的虚拟场景信息;

29.或者,将自身的视角信息同步至受训者的虚拟场景信息中,并根据该视角信息生成针对该受训者的虚拟场景信息;

30.或者,虚拟环境中生成教师和/或受训者的视线标记。

31.可选的,所述教师以及受训者远程联机。

32.本发明还提供了一种虚拟现实医学超声实训系统,所述系统包括:环境采集单元、物理对象识别与定位单元、虚拟b超影像生成单元、虚拟场景生成单元、虚拟场景显示单元,其中,

33.虚拟场景生成单元,用于搭建虚拟环境;

34.物理对象识别与定位单元用于:获取虚拟环境中各个物理对象的空间位置以及虚拟对象的空间位置,其中,所述物理对象包括:手持vr控制器;虚拟对象包括:虚拟b超机、虚拟病床、虚拟受诊者中的一种或组合;

35.环境采集单元,用于实时监测物理对象的空间坐标以及空间角度;

36.虚拟场景显示单元,用于根据所述空间坐标以及空间角度生成对应的虚拟b超探头并显示给用户;

37.虚拟b超影像生成单元,用于根据所述虚拟b超探头与虚拟对象之间的相位位置以及相对角度,生成对应的虚拟b超影像,并展示给受训者。

38.本发明的优点在于:

39.应用本发明实施例,综合应用虚拟现实、人工智能等技术进行虚拟现实b超培训,不需要专用硬件(仿真探头、仿真人体模型),成本低,应用方便。

40.另外,受训者在虚拟环境中对虚拟受诊者进行诊断,系统通过人工智能技术实时生成对应的b超影像,帮助受训者快速掌握医学超声诊断技能,熟悉各种罕见病例的影像特征。借助与5g的低时延和高带宽,系统进一步实现异地远程虚拟教学实训,并对虚拟空间中的教学互动方式进行了创新,展示了虚拟现实的无限可能性。

附图说明

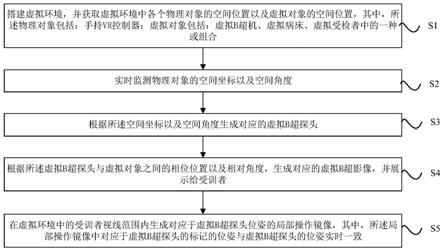

41.图1为本发明实施例提供的一种5g虚拟现实医学超声实训方法的流程示意图;

42.图2为本发明实施例中虚拟场景的初始场景示意图;

43.图3为本发明实施例中受训者进入后的虚拟环境示意图;

44.图4为本发明实施例中生成虚拟b超探头的示意图;

45.图5为本发明实施例中展示虚拟b超影像的虚拟环境示意图;

46.图6为本发明中加入了局部操作镜像后虚拟场景示意图;

47.图7为本发明实施例中虚拟训练时局部操作镜像放大示意图;

48.图8为本发明中观察者在查看操作者操作的虚拟场景示意图;

49.图9为本发明实施例提供的一种5g虚拟现实医学超声实训系统的结构示意图;

50.图10为本发明实施例提供的一种5g虚拟现实医学超声实训方法中视线示意图。

具体实施方式

51.为使本发明实施例的目的、技术方案和优点更加清楚,下面将结合本发明实施例,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有作出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

52.实施例1

53.图1为本发明实施例提供的一种5g虚拟现实医学超声实训方法的流程示意图,如图1所示,

54.s1:搭建虚拟环境,并获取虚拟环境中各个物理对象的空间位置以及虚拟对象的空间位置,其中,所述物理对象包括:手持vr控制器203;虚拟对象包括:虚拟b超机104、虚拟病床101、虚拟受诊者102中的一种或组合。

55.在搭建虚拟环境时,图2为本发明实施例中虚拟场景的初始场景示意图,如图2所示,即在虚拟场景中,具备虚拟b超机104及显示器103、虚拟病床101以及虚拟受诊者102。此时受训者205还未进入虚拟环境。

56.受训者205静坐,戴上vr头显201,手持vr控制器203,进入虚拟b超机104房。受训者205端坐在虚拟b超机104房中,前方是虚拟b超机104,左侧是虚拟就诊者102。受训者205可以使用商用虚拟现实头戴式显示器(例如oculus quest 2、hp reverb g2)进行虚拟现实b超培训,不需要如仿真探头、仿真人体模型等专用硬件。

57.图3为本发明实施例中受训者205进入后的虚拟环境示意图,如图3所示,在受训者205坐好并佩戴好虚拟现实头戴式显示器之后,根据虚拟现实头戴式显示器中自带的位置传感器得到虚拟现实头戴式显示器的空间位置。当受训者205握持手持vr控制器203时,系统利用手持vr控制器203中的位置传感器得到手持vr控制器203的空间位置。

58.s2:实时监测物理对象的空间坐标以及空间角度。

59.在测量到受训者205的头戴式显示器的位置以及手持vr控制器203的位置之后,受训者205的头部与手部会产生位移,因此,头戴式显示器的位置以及手持vr控制器203的位置是动态变化的,因此,需要实时追踪二者的空间坐标以及对应的角度,例如,头戴式显示器的角度主要是受训者205的视角,手持vr控制器203的角度主要是手持vr控制器203中轴线的方向角与高度角。图4为本发明实施例中生成虚拟b超探头401的示意图,如图4所示,在实际应用中,b超探头与受诊者的相对位置可采用多种方法进行表述。以区域方位法为例:首先将人体表面网格化(网格越小,精度越高),每个网格近似成平面;探头与人体接触位置所在网格称为区域;b超探头在该区域平面直角坐标系中的方向以仰角和方位角表达。人体网格化的腹部部分,虚拟b超探头401与虚拟受诊者的相对位置为(区域:403;水平角:33度,仰角:48度)。

60.本发明实施例的虚拟现实头戴式显示装置使用inside-out(内向外追踪)方式实现定位映射功能。采用inside-out定位方式时,环境采集单元主要就是vr头显201上的摄像头阵列。inside-out定位方式的基础是slam(simultaneous localization and mapping),也称为cml(concurrent mapping and localization,即时定位与地图构建),它主要通过计算机视觉cv算法来融合来自多个传感器的输入数据,从而在不断更新的数字映射中确定对象的位置。通过vr头盔上的摄像头阵列可以同时实现vr头显201和两个vr控制器203在三维物理空间的精确定位。在典型的b超实训过程中,受训者205采用静坐姿态,运动部位主要是头部和手,动作幅度不大,inside-out更加适合。

61.s3:根据所述空间坐标以及空间角度生成对应的虚拟b超探头401。

62.系统根据手持vr控制器203的位置以及对应的倾斜角度,生成对应的虚拟b超探头401,对应的虚拟b超探头401的倾斜角度与对应的虚拟b超探头401的倾斜角度一致。

63.为了提高逼真程度,可以将虚拟空间与真实物理空间进行等比例映射,即受训者205手持vr控制器203的位置在哪里,虚拟空间中虚拟b超探头401的位置就在哪里。

64.s4:根据所述虚拟b超探头401与虚拟对象之间的相位位置以及相对角度,生成对应的虚拟b超影像501,并展示给受训者205。

65.根据虚拟b超探头401与虚拟受诊者的相对位置,确定出探查切面,根据探查切面获取匹配的真实b超三维影像,并将真实b超三维影像作为虚拟b超影像501。

66.虚拟b超影像501的生成有两种方式:插值法和生成法,都可用于b超影像生成单元。插值法使用预先录制好真实的b超影像,然后使用算法补充缺少的视频帧,无缝连续播放。

67.生成法通过建立人体数学模型及声波在人体组织中的属性模型,实时计算生成b超影像。具体可以利用《基于几何声学的超声图像仿真》(eurographics workshop on visual computing for biology and medicine(2012))文献公开的生成发进行虚拟b超影像501的生成。

68.随着大数据的快速发展,各类病例的预录真实b超影像已经相对容易获得;使用人工智能技术对b超影像进行实时处理与插帧也已经相对完善,因此,插值法是相对较好的方式。在插值法中,b超影像数据库存储所有的预录真实b超影像,采用三维影像,以便后期重建。预录真实b超影像录入b超影像数据库时,应同时录入相关特征信息(预录特征信息),包括但不限于:

69.受诊者编码:预录真实b超影像对应的受诊者编码。受诊者编码在b超影像数据库中唯一。该受诊者在b超影像数据库中所有预录真实b超影像的受诊者编码相同。

70.采集时间

71.类别:二维/三维

72.人体部位

73.诊断病种

74.受诊者静态信息

75.性别

76.年龄

77.身高

78.体重

79.其他诊断相关信息

80.影像采集动态信息

81.采集时受诊者身体姿态(例如:仰卧/侧卧)

82.采集时受诊者身体状态(例如:闭气/吸气)

83.b超探头与受诊者人体部位的相对位置

84.b超探头与受诊者人体部位的相对区域

85.b超探头与受诊者人体部位的相对角度

86.b超探头与受诊者人体部分的相对距离

87.b超探头与受诊者人体部分的相对压力值所属范围;

88.根据实时特征信息(实训场景设定和虚拟场景生成单元传送的虚拟b超探头401设定及虚拟b超探头401与虚拟受诊者相对位置信息),从b超影像数据库中选择最匹配的真实b超三维影像用于展示.

89.图5为本发明实施例中展示虚拟b超影像501的虚拟环境示意图,如图5所示,将vr控制器203在虚拟空间中映射为虚拟b超探头401,受训者205在虚拟b超机104房内使用虚拟b超探头401对虚拟受诊者102进行诊察。虚拟场景生成单元将b超影像显示在虚拟b超显示器上,供受训者205检视。

90.在将虚拟b超影像501在虚拟显示器103中进行显示时,可以基于3d尺度不变特征变换算法对预录超声三维图像进行变换与拼接(ieee comput graph appl.mar-apr 2011;31(2):36-48.)。或者利用深度学习技术训练b超影像处理模型,也能达到良好的效果。

91.受训者205可以使用vr控制器203上的按钮变更虚拟b超机104的设置,可以通过手部的移动调整虚拟b超探头401的位置,虚拟b超显示器的b超影像随之变化。受训者205可以使用vr控制器203上的按钮拍摄诊断影像。受训者205截取b超影像。取下vr头显201,退出虚拟b超机104房。受训者205在虚拟b超机104房内的完整操作,都由系统自动记录。受训者205根据截取的b超影像进行诊断,与案例设定、训练中使用的预录b超影像的特征信息(诊断病种)进行比对,得到诊断考核得分。

92.s4:在虚拟环境中的受训者视线范围内生成对应于虚拟b超探头位姿的局部操作镜像,其中,所述局部操作镜像中对应于虚拟b超探头的标记的位姿与虚拟b超探头的位姿实时一致。

93.为了方便受训者205观察虚拟b超探头401的位置与角度,可在虚拟环境中的受训者205视线范围内生成对应于虚拟b超探头401位姿的局部操作镜像,其中,所述局部操作镜像中对应于虚拟b超探头401的标记的位姿与虚拟b超探头401的位姿实时一致。当虚拟b超探头401被改变姿态后的虚拟受诊者的身体遮挡时,受训者可以利用局部操作镜像作为参考,以帮助受训者快速定位。

94.受训者205使用vr控制器203启动虚拟b超机104。虚拟场景生成单元将vr控制器203显示为虚拟b超探头401,同时在b超机显示器的左侧显示局部操作镜像。

95.图6为本发明中加入了局部操作镜像后虚拟场景示意图,如图6所示,在受训者205视线前方加入一个局部操作镜像。局部操作镜像包括虚拟受诊者局部体表镜像601和虚拟b超探头镜像603。该虚拟b超探头镜像603与受训者205的手部操作实时同步。在实际操作中,该镜像由于视线限制(受训者205视线主要集中于b超影像)或受诊者姿态限制(例如侧卧)而无法看到。操作增强指引将局部操作镜像和b超影像同时显示在受训者205视线中,受训者205可以精确的控制手部动作,获取准确图像。

96.受训者205在虚拟场景中可以看到自己的虚拟手和手持的虚拟b超探头401。虚拟b超探头401与虚拟受诊者a的相对位置与物理空间中一致。受训者205移动vr控制器203,虚拟空间中的虚拟b超探头401也相应移动。当虚拟b超探头401移动到虚拟受诊者a腹部上方时,局部操作镜像中同步出现虚拟b超探头401,受训者205可以通过局部操作镜像实时掌握虚拟b超探头401与虚拟受诊者a腹部的相对位置。

97.由于没有仿真人体模型,受训者205在虚拟场景中难以进行虚拟b超探头401的精确定位。局部操作镜像在不改变受训者205操作方式的同时,将虚拟b超探头401的动作展现在受训者205眼前,有效解决了虚拟b超探头401精准定位的问题。

98.本发明实施例中使用商用虚拟现实头戴式显示器进行虚拟现实b超实训,不需要专用硬件(仿真探头、仿真人体模型),成本低,应用方便。

99.案例1

100.案例说明

101.考核受训者205对脂肪肝诊断能力。

102.训练场景设定

103.人体部位:腹部

104.诊断病种:脂肪肝:轻度

105.受诊者静态信息

106.性别:男

107.年龄:20-50

108.身高:160cm

–

180cm

109.体重:60kg

–

90kg

110.其他相关信息:其他有助于诊断的信息

111.初始虚拟场景创建

112.虚拟场景创建单元在b超影像数据库中检索符合训练场景设定的预录b超影像,检索到匹配预录b超影像后,根据预录b超影像预录特征信息,创建虚拟就诊者,进而创建虚拟场景:

113.虚拟b超机104房间:长3米,宽3米,高3米

114.虚拟b超机104:

115.虚拟病床101:高1.4米,长2米

116.虚拟就诊者a:

117.受诊者编码:a

118.25岁男性,身高1.75米,体重85kg(肥胖)

119.其他相关信息:就诊原因患者主诉,发现肝功能异常2天

…

120.此虚拟场景中只有1个人员,所有功能单元都运行在受训者205vr头显201上。

121.案例2

122.案例说明

123.指导教师801指导受训者205对胆囊结石进行诊断。

124.训练场景设定

125.人体部位:腹部

126.诊断病种:胆囊多发结石

127.受诊者静态信息

128.性别:男

129.年龄:55

130.身高:173cm

131.体重:71kg

132.其他相关信息:其他有助于诊断的信息

133.初始虚拟场景创建

134.虚拟场景创建单元在b超影像数据库中检索符合训练场景设定的预录b超影像,检索到匹配预录b超影像后,根据预录b超影像预录特征信息,创建虚拟就诊者,进而创建虚拟场景:

135.虚拟b超机104房:长3米,宽3米,高3米

136.虚拟b超机104:

137.虚拟病床101:高1.4米,长2米

138.虚拟就诊者a:

139.受诊者编码:a

140.55岁男性,身高1.73米,体重71kg

141.其他相关信息:就诊原因患者主诉右上腹痛

……

142.此虚拟场景中有三个虚拟角色:

143.指导者:对应现实中的指导教师801

144.受训者205:对应现实中的受训者205

145.受诊者:虚拟受诊者a

146.在本发明实施例的一种进一步改进方式中,受训者205可以通过语音指令要求虚拟受诊者改变姿态(例如仰卧/侧卧),环境采集单元将语音指令传送到虚拟场景生成单元,虚拟场景生成单元识别语音指令,按照指令改变虚拟受诊者102的姿态,受训者205对改变后的姿态进行检查。

147.受训者205可以通过语音指令要求虚拟受诊者102改变状态(例如吸气/闭气),环境采集单元将语音指令传送到虚拟场景生成单元,虚拟场景生成单元识别语音指令,按照指令改变虚拟受诊者102的状态,b超影像也相应发生变化。

148.进一步的,在操作指引标记605为按压压力指示时,利用不同深度的颜色进行压力高低的区分标记。

149.根据预录真实b超影像的特征信息,最佳诊断位置为区域403,水平角α,仰角β,如图中虚线所示。由于是考核式训练,操作指引标记605并不显示。

150.受训者205指令虚拟受诊者a憋气,虚拟受诊者a的腹部状态改为憋气。

151.虚拟b超探头401在虚拟受诊者a腹部移动时,相对压力为一般。

152.图7为本发明实施例中虚拟训练时局部操作镜像放大示意图,如图7所示,当虚拟b超探头401移动到腹部位置(区域z,水平角α,仰角β,压力一般)时,由于虚拟受诊者a肥胖,腹部脂肪堆积,实时b超影像不清晰。虚拟b超探头401下移,虚拟受诊者a体表区域z逐渐变红,视觉反馈应力增加,达到最佳位置。局部操作镜像的压力视觉反馈功能,可以在没有仿真人体模型的情况下帮助受训者205掌握操作的力道。

153.进一步的,在局部操作镜像中生成操作指引标记605,其中,所述操作指引标记605包括:虚拟引导线、按压压力指示中的一种或组合。

154.针对特定的病例场景,局部操作镜像还可以显示操作指引标记605。操作指引标记605是一条可见的虚拟有向线,向受训者205指示最佳的位置(区域、角度、距离)。当虚拟b超探头401与操作指引标记605重合后,可获得正确的b超影像。局部操作镜像中的操作指引标记605,可以帮助受训者205快速定位诊断部位,强化训练效果。

155.局部操作镜像还可以显示虚拟b超探头401与虚拟受诊者接触的相对压力。当虚拟b超探头401与虚拟受诊者接触时,相对压力为正常,虚拟受诊者局部体表镜像正常显示;虚拟b超探头401继续下压,虚拟受诊者局部体表镜像颜色变化(例如变为红色),显示相对压力重显示红色区块701。

156.受训者205可以在虚拟空间中手动调整局部操作镜像的位置和角度,以便更高效的查看。

157.在本发明实施例的一种进一步改进方式中,受训者及教师均佩戴vr头显201,vr头显201采用inside-out方式定位,vr头显201的环境采集单元将采集到的周围环境数据传送至vr头显201上的物理对象识别与定位单元。物理对象识别与定位单元对环境采集单元采集的数据进行实时分析,在物理空间内的三维位置进行实时定位,并将定位信息和用户信

息通过5g网络实时发送至远端应用服务器的虚拟场景生成单元。虚拟场景生成单元负责三维虚拟场景的生成。并根据用户信息将用户添加到三维虚拟场景中,将虚拟现实场景通过5g网络发送到远程用户vr头显201的虚拟场景显示单元。受训者和教师进入同一个三维虚拟场景。

158.由于教师要对受训者进行指导,因此在教师vr头显201和受训者vr头显201之间,还有双向的语音传输通道。

159.教师与受训者进入虚拟训练,以

160.虚拟b超机104房中有两个角色:

161.操作者802:进行b超诊察操作。

162.观察者801:观察操作者802的操作。

163.虚拟训练分为两个阶段:

164.演示阶段:教师为操作者802,进行b超诊察操作,受训者为观察者801,进行观察。

165.在演示阶段,教师作为操作者802的角色坐在真实座椅2011上进行操作演示,受训者作为观察者801的角色进行观察。

166.观察者801在虚拟b超机104机房中,可实时查看操作者802的操作。观察者801采用上帝视角,使用vr控制器203在虚拟b超机104房任意移动三维位置,通过vr头显201的移动调整视角。

167.观察者801和作为操作者802的教师通过5g语音进行交流。为了使双方的交流可视化,观察者801在虚拟场景中采用拟人化形象。操作者802通过语音指示观察者801在指定位置观察,也可以直接拖动观察者801的拟人化形象到指定位置。

168.图8为本发明中演示阶段观察者801在查看操作者802操作的虚拟场景示意图,如图8所示,观察者801在虚拟b超机104机房中,可实时查看操作者802的操作。观察者801采用上帝视角,使用vr控制器203在虚拟b超机104房任意移动三维位置,通过vr头显201的移动调整视角。

169.利用虚拟现实的虚拟性,观察者801可以在三维空间的任意位置以任意角度学习操作者802的操作。在语音指示之外,操作者802可以直接拖动观察者801的虚拟角色到虚拟空间的指定位置,观察者801的视角同步转移到相应位置,方便观察者801观察。

170.在演示阶段结束后进入实训阶段,实训阶段中,受训者为操作者802的角色,进行b超诊察操作,教师为观察者801的角色,进行观察。

171.教师退出虚拟环境中的操作者802所处的角色,由受训者接替,教师接替观察者801角色。除了角色变化,其他流程与演示阶段相同。

172.操作者802和观察者801通过5g语音进行交流。

173.本发明实施例中利用低延时高速率网络(例如5g/光纤/wifi6),实现远程虚拟空间的实操教学。

174.在实际应用中,教师以及受训者远程联机进入同一个虚拟环境中。本发明实施例所指远程联机的含义为:教师可以与受训者在同一个教室内,或者在不同的教室内,或者教室与受训者可以在不同的行政区划内,例如,教师位于上海静安区,受训者可以位于上海闸北区、北京朝阳区、或者美国华盛顿等。

175.实施例2

176.与本发明实施例1相对应,本发明实施例2提供了一种5g虚拟现实医学超声实训系统。

177.图9为本发明实施例提供的一种5g虚拟现实医学超声实训系统的结构示意图,如图9所示,系统包括:环境采集单元、物理对象识别与定位单元、虚拟b超影像生成单元、虚拟场景生成单元、虚拟场景显示单元,其中,

178.虚拟场景生成单元,用于搭建虚拟环境;并虚拟场景生成单元将虚拟场景、虚拟对象(受训者205手持超声探头)及虚拟b超影像501进行融合,通过虚拟场景显示单元展示给受训者205;

179.物理对象识别与定位单元用于:获取虚拟环境中各个物理对象的空间位置以及虚拟对象的空间位置,其中,所述物理对象包括:手持vr控制器;虚拟对象包括:虚拟b超机、虚拟病床、虚拟受诊者中的一种或组合;物理对象识别与定位单元行在虚拟现实头戴显示装置上,负责对环境采集单元采集的数据进行实时分析,实现对vr头显201和vr控制器203在物理空间内的三维位置进行实时定位,并将定位信息实时发送至虚拟场景生成单元。物理对象识别与定位单元实时对受训者205头部(通过vr头显201)和手部(通过vr控制器203)进行定位,虚拟场景生成单元将物理空间的定位信息转换为虚拟空间中受训者205的视角及虚拟b超探头401的位置。

180.环境采集单元,用于实时监测物理对象的空间坐标以及空间角度;环境采集单元运行在虚拟现实头戴显示装置上,负责采集受训者205周围的环境数据(视频数据、音频数据、定位数据),以便在虚拟空间中对受训者205进行定位和动作跟踪。采用outside-in定位方式时,环境采集单元就是外部定位基站。

181.虚拟场景显示单元,用于根据所述空间坐标以及空间角度生成对应的虚拟b超探头并显示给用户;虚拟场景显示单元运行在虚拟现实头戴显示装置上,连接虚拟现实头戴显示装置的显示单元,受训者205戴上vr头显201后,进入虚拟现实空间,进行实训。虚拟场景生成单元负责三维虚拟场景的生成,可运行在虚拟现实头戴显示装置或远程服务器上,当虚拟场景涉及多人协作时,必须运行在远程服务器上。初始虚拟场景为虚拟b超机104房,场景中包括虚拟b超机104、虚拟病床101、虚拟受诊者。上述虚拟对象均为三维对象,形状与对应的真实物体一致。

182.虚拟b超影像生成单元,用于根据所述虚拟b超探头与虚拟对象之间的相位位置以及相对角度,生成对应的虚拟b超影像,并展示给受训者。虚拟场景生成单元还用于将虚拟b超探头401与虚拟受诊者的相对位置(区域、角度、距离)传送至虚拟b超影像生成单元。虚拟b超影像生成单元根据实训场景设定、虚拟受诊者102姿态和状态、虚拟b超探头401与虚拟受诊者的相对位置生成相应的b超影像。

183.虚拟b超影像生成单元和虚拟场景生成单元运行在同一位置,如虚拟现实头戴显示装置或远程服务器上。

184.系统工作原理为:环境采集单元采集受训者205周围的环境数据(视频数据、定位数据);物理对象识别与定位单元识别出周围物理环境中的物理对象(受训者205、受训者205手持vr控制器203),定位物理对象在周围物理环境中的位置,将位置传送到虚拟场景生成单元;环境采集单元(vr头显201上的摄像头)开始持续进行视频采集。物理对象识别与定位单元开始持续对受训者205的动作进行跟踪。

185.虚拟场景生成单元生成初始虚拟场景(虚拟b超机104、虚拟病床101、虚拟受诊者102),将物理对象(受训者205手持vr控制器203)转换为虚拟对象(受训者205手持超声探头),并添加到映射到虚拟场景的对应位置上,并将虚拟对象(b超探头)与虚拟受诊者102的相对位置传送给虚拟b超影像生成单元;

186.虚拟b超影像生成单元根据虚拟对象(b超探头)与虚拟受诊者102的相对位置生成相应的虚拟b超影像501,传送至虚拟场景生成单元。

187.本系统还包括b超影像处理单元,用于根据真实b超影像的预录特征信息和实时特征信息的差异,对真实b超三维影像进行处理,输出实时b超影像到虚拟场景生成单元。

188.实施例3

189.本发明实施例3在实施例1的基础上增加了以下步骤:

190.系统还支持虚拟教学模式。此时,虚拟场景中有两个以上的人员参与,其中一个为教师,其他人为受训者。教师对使用虚拟b超机虚拟受诊者进行诊断,受训者对教师的诊断过程进行观摩。

191.受训者可以使用vr控制器在虚拟环境任意移动三维位置,通过vr头显的移动调整视角。相应的,系统自动感知受训者在虚拟环境中的位置,并根据对应的位置实时更新受训者眼镜中能看到的虚拟场景信息,其中,虚拟环境也称为虚拟b超机房。

192.为了方便教师指导受训者,教师可以通过5g语音指示受训者在指定位置观察,受训者可以通过5g语音进行反馈,或者教师可以使用vr控制器在虚拟环境任意移动受训者的位置,以方便受训者观察,进而提高教学效果。

193.进一步的,教师还可以把受训者引入教师视角。此时,受训者的视角与教师相同,看到的内容与教师一致。例如,教师要求受训者学习自己手部的动作,把受训者引入教师视角,教师注视并移动自己的手部(虚拟),同时进行语音讲解,受训者以教师的视角进行观察,效果更佳。

194.受训者在正常观察时,也可以主动切换到教师的视角,以便更好的学习。

195.更进一步的,图10为本发明实施例提供的一种5g虚拟现实医学超声实训方法中视线示意图,如图10所示,本发明实施例还包括视线可视化功能:

196.在虚拟教学模式中,受训者有时需要跟踪教师的视线,以便更好的观察;同时,教师有时也需要掌握受训者的视线,以便提升教学效果。

197.黄斑中心凹1001与瞳孔中心1003的连线称为视轴,即人眼实际注视方向,并向外延伸到虚拟场景中。

198.在虚拟场景中,虚拟视线1007以一条从虚拟角色眼睛到虚拟受诊者102的半透明的可见光线条展示,在正常情况下不可见。在实际中,可以将两个眼睛对应的视线的角平分线作为生成的虚拟视线,或者使用两个眼睛之一的视线作为生成的虚拟视线。环境采集单元使用眼动跟踪系统跟踪佩戴者眼睛1000的视线1005。

199.用户可以控制虚拟视线的显示与隐藏,例如:

200.教师需要所有受训者跟踪自己的视线,此时,所有的受训者都可以看到教师的虚拟视线,受训者的视线不可见。

201.受训者a可以个性化设置跟踪教师的视线,此时,仅受训者a可以看到教师的虚拟视线,其他受训者和教师都看不到教师的虚拟视线。

202.教师需要引导受训者b的视线,此时,教师可以看到受训者b的虚拟视线和自己的虚拟视线,当两个视线汇聚于一个虚拟受诊者102,引导完成。

203.以上实施例仅用以说明本发明的技术方案,而非对其限制;尽管参照前述实施例对本发明进行了详细的说明,本领域的普通技术人员应当理解:其依然可以对前述各实施例所记载的技术方案进行修改,或者对其中部分技术特征进行等同替换;而这些修改或者替换,并不使相应技术方案的本质脱离本发明各实施例技术方案的精神和范围。