1.本技术涉及人工智能技术领域,尤其涉及一种语音合成模型的训练方法、装置、设备及介质。

背景技术:

2.随着深度学习技术的发展,可以将深度学习应用于文字转语音的任务之中,其中主要包含文本语音转换(text to speech,tts)技术。虽然tts模型可以将文字转为较为自然的语音信号,但是在文字转为情感化语音方面,由于tts模型在训练过程中对高质量高数量的语音数据集的需求,使得人工对tts模型所使用数据集进行情感标注变得困难。因此,如何在不对数据集进行情感标注的前提下,仍然可以使用tts模型将文字转为情感化语音是有待解决的问题。

技术实现要素:

3.本技术实施例提供了一种语音合成模型的训练方法、装置、设备及介质,可实现在不对训练样本进行情感标注的前提下,仍然可以使用tts模型将文字转为情感化语音,提高语音合成模型的训练效率。

4.一方面,本技术实施例提供一种语音合成模型的训练方法,该方法包括:

5.获取训练样本,训练样本包括第一训练文本信息以及第一训练文本信息对应的训练语音信息;

6.通过语音合成模型中的全局风格标签(global style token,gst)模型对第一训练文本信息进行情感识别处理,得到第一训练文本信息的情感向量,并将第一训练文本信息的情感向量嵌入语音合成模型中的tts模型;

7.通过tts模型对第一训练文本信息和第一训练文本信息的情感向量进行语音合成处理,得到第一训练文本信息对应的预测语音信息;

8.将第一训练文本信息对应的预测语音信息和训练语音信息进行比较,得到语音合成损失值;

9.基于语音合成损失值对tts模型的参数和gst模型的参数进行调整,以对语音合成模型进行训练,得到训练后的语音合成模型,训练后的语音合成模型包括训练后的gst模型和训练后的tts模型。

10.在一个实施例中,通过语音合成模型中的gst模型对第一训练文本信息进行情感识别处理,得到第一训练文本信息的情感向量之前,还可以实施以下过程:

11.通过跨域语音情绪识别(speechemotion recognition,ser)模型对第一训练文本信息进行情感分类处理,得到第一训练文本信息的第一情感标签,第一情感标签用于指示第一训练文本信息的情感类别;

12.通过gst模型对第一训练文本信息进行情感分类处理,得到第一训练文本信息的第二情感标签;

13.将第一情感标签和第二情感标签进行比较,得到情感损失值;

14.基于情感损失值调整gst模型的参数,得到调整后的gst模型;

15.通过语音合成模型中的gst模型对第一训练文本信息进行情感分类处理,得到第一训练文本信息的情感向量的具体实施过程为:

16.通过调整后的gst模型对第一训练文本信息进行情感识别处理,得到第一训练文本信息的情感向量。

17.在一个实施例中,通过跨域ser模型对第一训练文本信息进行情感分类处理,得到第一训练文本信息的第一情感标签的具体实施过程为:

18.基于最大均值差异(maximum mean discrepancy,mmd)算法选择和第一训练文本信息之间的相似度大于预设比例阈值的第二训练文本信息;

19.通过跨域ser模型对第二训练文本信息进行情感分类处理,得到第一情感标签。

20.在一个实施例中,通过语音合成模型中的gst模型对第一训练文本信息进行情感识别处理,得到第一训练文本信息的情感向量的具体实施过程为:

21.通过gst模型中的参考编码器对第一训练文本信息进行编码,得到参考向量;

22.使用注意机制计算参考向量和初始化向量之间的相似度,得到一组权重值;

23.将一组权重值与初始化向量进行加权运算,得到第一训练文本信息的情感向量。

24.在一个实施例中,通过语音合成模型中的tts模型对第一训练文本信息和第一训练文本信息的情感向量进行语音合成处理,得到第一训练文本信息对应的预测语音信息的具体实施过程为:

25.通过tts模型对第一训练文本信息进行语言学习,得到第一训练文本信息的底层结构特征;

26.通过tts模型对第一训练文本信息的底层结构特征和第一训练文本信息的情感向量进行解码处理,得到第一训练文本信息对应的预测语音信息。

27.在一个实施例中,基于语音合成损失值对语音合成模型中的tts模型的参数和gst模型的参数进行调整,以对语音合成模型进行训练,得到训练后的语音合成模型之后,还可以实施以下过程:

28.获取目标文本信息;

29.通过训练后的gst模型对目标文本信息进行情感预测,得到目标文本信息的情感向量;

30.通过训练后的tts模型对目标文本信息和目标文本信息的情感向量进行语音合成处理,得到目标文本信息对应的预测语音信息。

31.在一个实施例中,获取目标文本信息的具体实施过程为:

32.显示目标文本信息;

33.在接收到对目标文本信息的语音合成指令时,获取目标文本信息;

34.所述通过训练后的tts模型对目标文本信息和目标文本信息的情感向量进行语音合成处理,得到目标文本信息对应的预测语音信息之后,还包括:

35.输出目标文本信息对应的预测语音信息。

36.另一方面,本技术实施例提供了一种语音合成模型的训练装置,该语音合成模型的训练装置包括:

37.获取单元,用于获取训练样本,训练样本包括第一训练文本信息以及第一训练文本信息对应的训练语音信息;

38.处理单元,用于通过语音合成模型中的gst模型对第一训练文本信息进行情感识别处理,得到第一训练文本信息的情感向量,并将第一训练文本信息的情感向量嵌入tts模型;

39.处理单元,还用于通过语音合成模型中的tts模型对第一训练文本信息和第一训练文本信息的情感向量进行语音合成处理,得到第一训练文本信息对应的预测语音信息;

40.处理单元,还用于将预测语音信息和训练语音信息进行比较,得到语音合成损失值;

41.处理单元,还用于基于语音合成损失值对语音合成模型中的tts模型的参数和gst模型的参数进行调整,以对语音合成模型进行训练,得到训练后的语音合成模型,训练后的语音合成模型包括训练后的gst模型和训练后的tts模型。

42.再一方面,本技术实施例提供一种电子设备,包括处理器、存储器和通信接口,处理器、存储器和通信接口相互连接,其中,存储器用于存储支持终端执行上述方法的计算机程序,计算机程序包括程序指令,处理器被配置用于调用程序指令,执行如下步骤:获取训练样本,训练样本包括第一训练文本信息以及第一训练文本信息对应的训练语音信息;通过语音合成模型中的gst模型对第一训练文本信息进行情感识别处理,得到第一训练文本信息的情感向量,并将第一训练文本信息的情感向量嵌入语音合成模型中的tts模型;通过tts模型对第一训练文本信息和第一训练文本信息的情感向量进行语音合成处理,得到第一训练文本信息对应的预测语音信息;将第一训练文本信息对应的预测语音信息和训练语音信息进行比较,得到语音合成损失值;基于语音合成损失值对tts模型的参数和gst模型的参数进行调整,以对语音合成模型进行训练,得到训练后的语音合成模型,训练后的语音合成模型包括训练后的gst模型和训练后的tts模型。

43.又一方面,本技术实施例提供了一种计算机可读存储介质,计算机可读存储介质存储有计算机程序,计算机程序包括程序指令,程序指令当被处理器执行时使处理器执行上述语音合成模型的训练方法。

44.本技术实施例中,通过语音合成模型中的gst模型对第一训练文本信息进行情感识别处理,得到第一训练文本信息的情感向量,并将第一训练文本信息的情感向量嵌入语音合成模型中的tts模型,进而通过tts模型基于第一训练文本信息和情感向量进行语音合成,可实现在不对训练样本进行情感标注的前提下,仍然可以使用tts模型将文字转为情感化语音,提高语音合成模型的训练效率。

附图说明

45.为了更清楚地说明本技术实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本技术的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

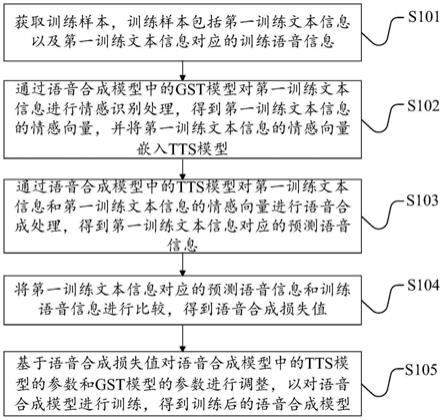

46.图1是本技术实施例提供的一种语音合成模型的训练方法的流程示意图;

47.图2是本技术实施例提供的一种语音合成模型的训练系统的架构示意图;

48.图3是本技术实施例提供的一种语音合成方法的流程示意图;

49.图4是本技术实施例提供的一种语音合成模型的训练装置的结构示意图;

50.图5是本技术实施例提供的一种电子设备的结构示意图。

具体实施方式

51.本技术实施例提供了一种语音合成模型的训练方法,通过语音合成模型中的gst模型对第一训练文本信息进行情感识别处理,得到第一训练文本信息的情感向量,并将第一训练文本信息的情感向量嵌入语音合成模型中的tts模型,进而通过tts模型基于第一训练文本信息和情感向量进行语音合成,不需要人工情感标注的训练样板,仍然可以进行情感语音合成,节省了大量的人力资源与时间资源,可更快的建立需要的情感tts。基于训练后的语音合成模型,可在对语音合成得到的预测语音信息的质量没有影响的情况下,产生富含情感的语音。

52.本技术实施例中的语音合成模型的训练方法可以应用在第一电子设备中,其中,第一电子设备可以为智能手机、平板电脑、笔记本电脑、台式计算机、智能车载设备以及智能可穿戴设备中的任意一种或多种。可选的,第一电子设备也可以为服务器,该服务器可以是独立的物理服务器,也可以是多个物理服务器构成的服务器集群或者分布式系统等。也就是说,服务器可以是独立的服务器,也可以是提供云服务、云数据库、云计算、云函数、云存储、网络服务、云通信、中间件服务、域名服务、安全服务、内容分发网络(contentdelivery network,cdn)、以及大数据和人工智能平台等基础云计算服务的云服务器。

53.本技术实施例可以基于人工智能技术对相关的数据进行获取和处理。其中,人工智能(artificial intelligence,ai)是利用数字计算机或者数字计算机控制的机器模拟、延伸和扩展人的智能,感知环境、获取知识并使用知识获得最佳结果的理论、方法、技术及应用系统。

54.人工智能基础技术一般包括如传感器、专用人工智能芯片、云计算、分布式存储、大数据处理技术、操作/交互系统、机电一体化等技术。人工智能软件技术主要包括计算机视觉技术、机器人技术、生物识别技术、语音处理技术、自然语言处理技术以及机器学习/深度学习等几大方向。

55.请参见图1,图1是本技术实施例提供的一种语音合成模型的训练方法的流程示意图;如图1所示的语音合成模型的训练方法可由第一电子设备来执行,该方案包括但不限于步骤s101

‑

步骤s105,其中:

56.s101,获取训练样本,训练样本包括第一训练文本信息以及第一训练文本信息对应的训练语音信息。

57.第一电子设备可以获取训练样本,例如某个用户输入关于“祝你生日快乐”的音频数据,那么第一电子设备可以将该音频数据作为训练语音信息,该训练语音信息对应的第一训练文本信息可以为“祝你生日快乐”。

58.可以理解的是,训练样本可以是用户输入至第一电子设备的,例如第一电子设备通过麦克风采集训练语音信息,并通过第一电子设备的输入装置(例如触控面板或者键盘等)采集该训练语音信息对应的训练文本信息。可选的,训练样本也可以是第一电子设备从

本地存储器中获取的,也可以是第一电子设备从其他设备中获取的,还可以是第一电子设备通过互联网下载得到的,具体不受本技术实施例的限制。

59.s102,通过语音合成模型中的gst模型对第一训练文本信息进行情感识别处理,得到第一训练文本信息的情感向量,并将第一训练文本信息的情感向量嵌入语音合成模型中的tts模型。

60.本技术实施例中的gst模型相对传统的gst模型添加了一个基于风格标签(style token)权重的辅助监督情感预测任务,从而使gts模型更好的建模和情感相关的风格特征。第一电子设备将获取到的第一训练文本信息输入至gst模型,gst模型可以为第一训练文本信息中不同情感的字符串添加对应的情感条件,得到该第一训练文本信息的情感向量,情感向量包括该第一训练文本信息中不同情感的字符串对应的情感单元向量。

61.作为一种可行的实施方式,本技术实施例在训练过程中,可以通过跨域ser模型为tts模型提供情感标签。具体的,第一电子设备可以通过跨域ser模型对第一训练文本信息进行情感分类处理,得到第一训练文本信息的第一情感标签,第一情感标签用于指示第一训练文本信息的情感类别;通过gst模型对第一训练文本信息进行情感分类处理,得到第一训练文本信息的第二情感标签;将第一情感标签和第二情感标签进行比较,得到情感损失值;基于情感损失值调整gst模型的参数,得到调整后的gst模型。然后,第一电子设备可以通过调整后的gst模型对第一训练文本信息进行情感识别处理,得到第一训练文本信息的情感向量。

62.作为一种可行的实施方式,第一电子设备可以通过跨域ser模型对第一训练文本信息进行情感分类处理,得到第一训练文本信息的第一情感标签的方式可以为:第一电子设备基于mmd算法选择和第一训练文本信息之间的相似度大于预设比例阈值的第二训练文本信息,通过跨域ser模型对第二训练文本信息进行情感分类处理,得到第一情感标签。

63.本技术实施例中,由于tts模型和跨域ser模型所使用的数据集在说话人、记录设备、录音环境上存在差异,因此为了保证两个数据集在分布上的相似性,可以使用mmd算法,通过最小化mmd损失,来减小两个数据集间的分布差异。

64.具体的,mmd算法是一种用于检验两个分布是否相似的方法,被验证适用于跨域ser模型。本技术实施例使用mmd算法减小两数据集之间的差异,其实是用mmd算法来选择一个和tts数据集(即第一训练样本)较为相似的ser数据集(即第二训练样本)。

65.在获取ser以及tts数据集的特征以后,使用mmd算法,将ser数据集作为d

s

,将tts数据集作为d

t

,通过减少以下公式计算的mmd loss值(mmd损失值)来减少两个数据集之间的分布差异。

[0066][0067]

其中s

i

,s

j

分别是d

s

,d

t

中获取的特征,m,n分别是d

s

,d

t

的数据集中样本的个数,k(.,.)是核函数是多个rbf核的线性组合。

[0068]

基于此,第一电子设备通过跨域ser模型对第一训练文本信息进行情感分类处理,

得到第一训练文本信息的第一情感标签的过程,具体可以为:跨域ser模型使用mmd算法选择和第一训练文本信息较为相似的第二训练文本信息,使用跨域ser模型中的卷积神经网络(convolutional neural networks,cnn)

‑

循环神经网络(recurrent neural network,rnn)获取第二训练文本信息的特征向量,将特征向量输入至跨域ser模型中的情感分类器,通过情感分类器对特征向量进行情感分类处理,得到第一情感标签。

[0069]

跨域ser模型是预先训练好的,在本技术实施例中可以不再训练跨域ser模型。其中,跨域ser模块的训练过程为:获取训练样本,训练样本包括ser数据,以及人工标注的该ser数据的情感标签;然后通过跨域ser模型获取ser数据的特征向量,将特征向量输入至情感分类器,得到该特征向量的情感分类,将得到的情感分类和第三训练样本中的情感标签进行比较,得到情感分类器的损失值,根据该损失值对情感分类器进行训练,以实现对跨域ser模块的训练。

[0070]

作为一种可行的实施方式,第一电子设备通过语音合成模型中的gst模型对第一训练文本信息进行情感识别处理,得到第一训练文本信息的情感向量的实施过程可以为:通过gst模型中的参考编码器对第一训练文本信息进行编码,得到参考向量,使用注意机制计算参考向量和初始化向量之间的相似度,得到一组权重值,将所述一组权重值与初始化向量进行加权运算,得到第一训练文本信息的情感向量。

[0071]

具体实现中,第一电子设备将第一训练文本信息输入至gst模型,gst模型可以使用参考编码器将第一训练文本信息进行编码,得到参考向量,接着将参考向量传入style token层,使用注意机制计算参考向量和每个token之间的相似度(其中token是随机初始化的一组向量,即将韵律分解为tokens),最后输出一组权重值(表示每个style token对参考向量的贡献),然后gst模型将权重与token的加权和即风格向量嵌入tts模型,即给原本的文本特征添加了第二情感标签。

[0072]

本技术实施例相较于传统的gst模型,在style token层添加了辅助情感预测器,将style token层获得的token权重输入辅助情感预测器,使用dnn将第一训练文本信息分类至不同的情感类别,再将此时获得的情感类别和原本通过跨域ser模型获得的第一情感标签进行比较,得到情感损失值,根据情感损失值调整gst模型的token权重。然后将权重与token的加权和(即情感向量)嵌入tts模型。

[0073]

s103,通过tts模型对第一训练文本信息和第一训练文本信息的情感向量进行语音合成处理,得到第一训练文本信息对应的预测语音信息。

[0074]

作为一种可行的实施方式,tts模型可以为tacotron2模型。tacotron2模型可以包括文本编码器,注意力机制模块和解码器,由于编码

‑

解码方式是序列到序列的转换,可能出现序列无法对齐的情况,因此通过注意力机制模块可保证序列元素的对齐。

[0075]

示例性的,注意力机制模块可以包括senet(squeeze

‑

and

‑

excitation networks,压缩和激励网络)或者cbam(convolutional block attention module,基于卷积块的注意机制)等。senet的原理是:通过学习的方式来自动获取到每个特征通道的重要程度,然后依照这个重要程度去提升有用的特征并抑制对当前任务用处不大的特征。cbam包含2个独立的子模块,通道注意力模块(channel attention module,cam)和空间注意力模块(spartial attention module,sam),分别进行通道与空间上的attention。这样不只能够节约参数和计算力,并且保证了其能够做为即插即用的模块集成到现有的网络架构中去。

[0076]

可以理解的是,本技术实施例中的tts模型包含但不限定于tacotron2模型,例如tts模型可以为端到端对抗式tts模型(end

‑

to

‑

end adversarial text

‑

to

‑

speech,eats)或者clarinet模型等,clarinet模型指的是基于wavenet的并行音频波形(raw audio waveform)生成模型,wavenet模型是一种序列生成模型。

[0077]

s104,将第一训练文本信息对应的预测语音信息和训练语音信息进行比较,得到语音合成损失值。

[0078]

具体实现中,第一电子设备可以获取预测语音信息的音频特征,以及训练语音信息的音频特征,然后将预测语音信息的音频特征和训练语音信息的音频特征进行比较,得到语音合成损失值。

[0079]

s105,基于语音合成损失值对tts模型的参数和gst模型的参数进行调整,以对语音合成模型进行训练,得到训练后的语音合成模型,训练后的语音合成模型包括训练后的gst模型和训练后的tts模型。

[0080]

具体实现中,第一电子设备可以基于语音合成损失值对tts模型的参数进行调整,得到训练后的tts模型,并基于语音合成损失值对gst模型的style token权重进行调整,得到训练后的gst模型,实现gst

‑

tts联合训练,从而实现对语音合成模型的训练,得到训练后的语音合成模型。

[0081]

本技术实施例中,在文字转为情感化语音方面,由于tts模型对高质量、高数量的语音数据集的需求,使得人工对tts模型所使用数据集进行情感标注变得困难,而本技术实施例通过上述训练过程可实现在不对训练样本进行情感标注的前提下,仍然可以使用tts模型将文字转为情感化语音。

[0082]

本技术实施例中,通过语音合成模型中的gst模型对第一训练文本信息进行情感识别处理,得到第一训练文本信息的情感向量,并将第一训练文本信息的情感向量嵌入语音合成模型中的tts模型,进而通过tts模型基于第一训练文本信息和情感向量进行语音合成,可实现在不对训练样本进行情感标注的前提下,仍然可以使用tts模型将文字转为情感化语音,提高语音合成模型的训练效率。

[0083]

作为一种可行的实施方式,基于图1描述的语音合成模型的训练方法,本技术实施例提供语音合成模型的训练系统,如图2所示,图2为语音合成模型的训练系统的架构示意图。语音合成模型的训练系统可以包括gst模型、tts模型以及跨域ser模型。语音合成模型的训练系统可以运行在第一电子设备中,第一电子设备可以获取训练样本,训练样本包括第一训练文本信息及其对应的训练语音信息。然后第一电子设备可以通过跨域ser模型对第一训练文本信息进行情感分类处理,得到第一训练文本信息的第一情感标签,该第一情感标签用于指示第一训练文本信息的情感类别。第一电子设备可以通过gst模型对第一训练文本信息进行情感分类处理,得到第一训练文本信息的第二情感标签。第一电子设备可以将第一情感标签和第二情感标签进行比较,得到情感损失值,并基于情感损失值调整gst模型的style token权重。gst模型根据调整后的style token权重得到情感向量,并将情感向量嵌入tts模型。tts模型可以包括文本编码器,注意力机制模块和解码器,文本编码器可以对第一训练文本信息进行语言学习,以确定该第一训练文本信息的底层结构特征。注意力机制模型可以对第一训练文本信息的底层结构特征和情感向量进行对齐,然后通过解码器得到该目标文本信息对应的预测语音信息。tts模型将处理得到的预测语音信息和训练

语音信息进行比较,得到语音合成损失值,基于语音合成损失值对tts模型的参数和gst模型的style token权重进行调整,得到训练后的tts模型和训练后的gst模型,实现gst

‑

tts联合训练。

[0084]

请参见图3,图3是本技术实施例提供的一种语音合成方法的流程示意图;如图3所示的语音合成方法可由第二电子设备来执行,该方案包括但不限于步骤s301

‑

步骤s303,其中:

[0085]

s301,获取目标文本信息。

[0086]

在一个示例中,第二电子设备运行有阅读客户端,阅读客户端提供了听书功能,如果用户对某个文本信息(例如小说或者诗歌等)提交听书指令,那么第二电子设备在检测到听书指令之后可以获取该目标文本信息。

[0087]

在另一个示例中,第二电子设备运行有即时通讯客户端,在用户驾车或者处于颠簸环境等不方便浏览设备的场景中,即时通讯客户端中的某个会话界面包括至少一个文本信息,如果用户需要将某个文本信息转换成语音,那么用户可以对该文本信息提交语音转换指令,第二电子设备在检测到语音转换指令之后,可以获取该目标文本信息。

[0088]

在另一个示例中,用户在与第二电子设备中的智能客服客户端进行交互时,如果用户通过第二电子设备向智能客服客户端提交交互信息(交互信息的类型可以是文本或者语音),智能客服客户端可以基于交互信息确定待输出至用户的目标文本信息。

[0089]

在另一个示例中,第二电子设备在智能诊疗或者远程会诊等过程中,如果病人由于身体等原因导致无法浏览设备(例如病人无法挪动身体,且第二电子设备与病人之间存在一定距离),那么对端用户输入的文本信息,其中该文本信息为目标文本信息,示例性的,以智能诊疗为例,对端用户可以指的是智能诊疗助手;以远程会诊为例,对端用户可以指的是医生,具体不受本技术实施例的限制。

[0090]

其中,第二电子设备可以为智能手机、平板电脑、笔记本电脑、台式计算机、智能车载设备以及智能可穿戴设备中的任意一种或多种。第二电子设备可以和第一电子设备为同一设备,或者,第二电子设备可以和第一电子设备为不同设备,具体不受本技术实施例的限定。

[0091]

s302,通过训练后的gst模型对目标文本信息进行情感预测,得到目标文本信息的情感向量。

[0092]

具体实现中,训练后的语音合成模型包括训练后的gst模型和训练后的tts模型,训练后的gst模型相对传统的gst模型添加了一个基于style token权重的辅助监督情感预测任务,从而使gts更好的建模和情感相关的风格特征。第二电子设备将获取到的目标文本信息输入至训练后的gst模型,训练后的gst模型可以为目标文本信息中不同情感的字符串添加对应的情感条件,得到该目标文本信息的情感向量,情感向量包括该目标文本信息中不同情感的字符串对应的情感单元向量。

[0093]

s303,通过训练后的tts模型对目标文本信息和目标文本信息的情感向量进行语音合成处理,得到目标文本信息对应的预测语音信息。

[0094]

具体实现中,第二电子设备可以将目标文本信息输入至训练后的tts模型,训练后的tts模型可以对该目标文本信息进行语言学习,以确定该目标文本信息的底层结构特征。同时,训练后的gst模型得到该文本信息的情感向量之后,可以将该情感向量输入至训练后

的tts模型。训练后的tts模型在获取到目标文本信息的底层结构特征和情感向量之后,可以对目标文本信息的底层结构特征和情感向量进行解码处理,得到该目标文本信息对应的预测语音信息。

[0095]

在一个可行的实施例中,第二电子设备得到目标文本信息对应的预测语音信息之后,可以输出该预测语音信息。具体实现中,第二电子设备获取到预测语音信息之后,可以显示该预测语音信息,在用户对该预测语音信息进行播放操作(例如单击或者长按该预测语音信息等)之后,第二电子设备可以响应该播放操作生成播放指令,并播放该预测语音信息。或者,第二电子设备获取到预测语音信息之后,可以直接播放该预测语音信息。本技术实施例通过直接播放预测语音信息,可便于用户在不浏览第二电子设备的情况下也可以知悉目标文本信息的具体内容。

[0096]

传统的语音合成模型合成的语音的音频机械感严重,或者即使语调符合人类的说话模式,由于情感的缺乏使听众无法完全的沉浸于场景(例如听书)之中,导致用户流失。基于此,本技术实施例通过训练后的语音合成模型对目标文本信息进行情感预测,得到该目标文本信息的情感向量,通过训练后的语音合成模型对该目标文本信息和情感向量进行处理,得到该目标文本信息对应的预测语音信息,可确保语音合成得到的预测语音信息富含情感,进而提升用户黏度。

[0097]

本技术实施例还提供了一种计算机存储介质,该计算机存储介质中存储有程序指令,该程序指令被执行时,用于实现上述实施例中描述的相应方法。

[0098]

再请参见图4,图4是本技术实施例的提供一种语音合成模型的训练装置的结构示意图。

[0099]

本技术实施例的装置的一个实现方式中,装置包括如下结构。

[0100]

获取单元401,用于获取训练样本,训练样本包括第一训练文本信息以及第一训练文本信息对应的训练语音信息;

[0101]

处理单元402,用于通过语音合成模型中的gst模型对第一训练文本信息进行情感识别处理,得到第一训练文本信息的情感向量,并将第一训练文本信息的情感向量嵌入tts模型;

[0102]

处理单元402,还用于通过语音合成模型中的tts模型对第一训练文本信息和第一训练文本信息的情感向量进行语音合成处理,得到第一训练文本信息对应的预测语音信息;

[0103]

处理单元402,还用于将预测语音信息和训练语音信息进行比较,得到语音合成损失值;

[0104]

处理单元402,还用于基于语音合成损失值对语音合成模型中的tts模型的参数和gst模型的参数进行调整,以对语音合成模型进行训练,得到训练后的语音合成模型,训练后的语音合成模型包括训练后的gst模型和训练后的tts模型。

[0105]

在一个实施例中,处理单元402,还用于在通过语音合成模型中的gst模型对所述第一训练文本信息进行情感识别处理,得到所述第一训练文本信息的情感向量之前,通过跨域ser模型对第一训练文本信息进行情感分类处理,得到第一训练文本信息的第一情感标签,第一情感标签用于指示第一训练文本信息的情感类别;

[0106]

处理单元402,还用于通过gst模型对第一训练文本信息进行情感分类处理,得到

第一训练文本信息的第二情感标签;

[0107]

处理单元402,还用于将第一情感标签和第二情感标签进行比较,得到情感损失值;

[0108]

处理单元402,还用于基于情感损失值调整gst模型的参数,得到调整后的gst模型;

[0109]

处理单元402通过语音合成模型中的gst模型对第一训练文本信息进行情感分类处理,得到第一训练文本信息的情感向量,包括:

[0110]

通过调整后的gst模型对第一训练文本信息进行情感识别处理,得到第一训练文本信息的情感向量。

[0111]

在一个实施中,处理单元402通过跨域ser模型对第一训练文本信息进行情感分类处理,得到第一训练文本信息的第一情感标签,包括:

[0112]

基于mmd算法选择和第一训练文本信息之间的相似度大于预设比例阈值的第二训练文本信息;

[0113]

通过跨域ser模型对第二训练文本信息进行情感分类处理,得到第一情感标签。

[0114]

在一个实施例中,处理单元402通过语音合成模型中的gst模型对第一训练文本信息进行情感识别处理,得到第一训练文本信息的情感向量,包括:

[0115]

通过gst模型中的参考编码器对第一训练文本信息进行编码,得到参考向量;

[0116]

使用注意机制计算参考向量和初始化向量之间的相似度,得到一组权重值;

[0117]

将一组权重值与初始化向量进行加权运算,得到第一训练文本信息的情感向量。

[0118]

在一个实施例中,处理单元402通过语音合成模型中的tts模型对第一训练文本信息和第一训练文本信息的情感向量进行语音合成处理,得到第一训练文本信息对应的预测语音信息,包括:

[0119]

通过tts模型对第一训练文本信息进行语言学习,得到第一训练文本信息的底层结构特征;

[0120]

通过tts模型对第一训练文本信息的底层结构特征和第一训练文本信息的情感向量进行解码处理,得到第一训练文本信息对应的预测语音信息。

[0121]

在一个实施例中,获取单元401,还用于在处理单元402基于语音合成损失值对语音合成模型中的tts模型的参数和gst模型的参数进行调整,以对语音合成模型进行训练,得到训练后的语音合成模型之后,获取目标文本信息;

[0122]

处理单元402,还用于通过训练后的gst模型对目标文本信息进行情感预测,得到目标文本信息的情感向量;

[0123]

处理单元402,还用于通过训练后的tts模型对目标文本信息和目标文本信息的情感向量进行语音合成处理,得到目标文本信息对应的预测语音信息。

[0124]

在一个实施例中,获取单元401获取目标文本信息,包括:

[0125]

显示所述目标文本信息;

[0126]

在接收到对所述目标文本信息的语音合成指令时,获取所述目标文本信息;

[0127]

所述装置还可以包括:

[0128]

输出单元403,用于在处理单元402通过训练后的tts模型对目标文本信息和目标文本信息的情感向量进行语音合成处理,得到目标文本信息对应的预测语音信息之后,输

出目标文本信息对应的预测语音信息。

[0129]

本技术实施例中,通过语音合成模型中的gst模型对第一训练文本信息进行情感识别处理,得到第一训练文本信息的情感向量,并将第一训练文本信息的情感向量嵌入语音合成模型中的tts模型,进而通过tts模型基于第一训练文本信息和情感向量进行语音合成,可实现在不对训练样本进行情感标注的前提下,仍然可以使用tts模型将文字转为情感化语音,提高语音合成模型的训练效率。

[0130]

再请参见图5,图5是本技术实施例提供的一种电子设备的结构示意图,本技术实施例的电子设备包括供电模块等结构,并包括处理器501、存储器502以及通信接口503。处理器501、存储器502以及通信接口503之间可以交互数据,由处理器501实现相应的数据处理方案。

[0131]

存储器502可以包括易失性存储器(volatile memory),例如随机存取存储器(random

‑

access memory,ram);存储器502也可以包括非易失性存储器(non

‑

volatile memory),例如快闪存储器(flash memory),固态硬盘(solid

‑

state drive,ssd)等;存储器502还可以包括上述种类的存储器的组合。

[0132]

处理器501可以是中央处理器501(central processing unit,cpu)。处理器501也可以是由cpu和gpu的组合。在电子设备中,可以根据需要包括多个cpu和gpu进行相应的数据处理。在一个实施例中,存储器502用于存储程序指令。处理器501可以调用程序指令,实现如本技术实施例中上述涉及的各种方法。

[0133]

在第一个可能的实施方式中,电子设备的处理器501,调用存储器502中存储的程序指令,用于执行如下操作:

[0134]

获取训练样本,训练样本包括第一训练文本信息以及第一训练文本信息对应的训练语音信息;

[0135]

通过语音合成模型中的gst模型对第一训练文本信息进行情感识别处理,得到第一训练文本信息的情感向量,并将第一训练文本信息的情感向量嵌入tts模型;

[0136]

通过语音合成模型中的tts模型对第一训练文本信息和第一训练文本信息的情感向量进行语音合成处理,得到第一训练文本信息对应的预测语音信息;

[0137]

将预测语音信息和训练语音信息进行比较,得到语音合成损失值;

[0138]

基于语音合成损失值对语音合成模型中的tts模型的参数和gst模型的参数进行调整,以对语音合成模型进行训练,得到训练后的语音合成模型,训练后的语音合成模型包括训练后的gst模型和训练后的tts模型。

[0139]

在一个实施例中,处理器501在通过语音合成模型中的gst模型对所述第一训练文本信息进行情感识别处理,得到所述第一训练文本信息的情感向量之前,还可以实施以下过程:

[0140]

通过跨域ser模型对第一训练文本信息进行情感分类处理,得到第一训练文本信息的第一情感标签,第一情感标签用于指示第一训练文本信息的情感类别;

[0141]

通过gst模型对第一训练文本信息进行情感分类处理,得到第一训练文本信息的第二情感标签;

[0142]

将第一情感标签和第二情感标签进行比较,得到情感损失值;

[0143]

基于情感损失值调整gst模型的参数,得到调整后的gst模型;

[0144]

处理器501通过语音合成模型中的gst模型对第一训练文本信息进行情感分类处理,得到第一训练文本信息的情感向量的具体实施过程可以为:

[0145]

通过调整后的gst模型对第一训练文本信息进行情感识别处理,得到第一训练文本信息的情感向量。

[0146]

在一个实施中,处理器501通过跨域ser模型对第一训练文本信息进行情感分类处理,得到第一训练文本信息的第一情感标签的具体实施过程可以为:

[0147]

基于mmd算法选择和第一训练文本信息之间的相似度大于预设比例阈值的第二训练文本信息;

[0148]

通过跨域ser模型对第二训练文本信息进行情感分类处理,得到第一情感标签。

[0149]

在一个实施例中,处理器501通过语音合成模型中的gst模型对第一训练文本信息进行情感识别处理,得到第一训练文本信息的情感向量的具体实施过程可以为:

[0150]

通过gst模型中的参考编码器对第一训练文本信息进行编码,得到参考向量;

[0151]

使用注意机制计算参考向量和初始化向量之间的相似度,得到一组权重值;

[0152]

将一组权重值与初始化向量进行加权运算,得到第一训练文本信息的情感向量。

[0153]

在一个实施例中,处理器501通过语音合成模型中的tts模型对第一训练文本信息和第一训练文本信息的情感向量进行语音合成处理,得到第一训练文本信息对应的预测语音信息的具体实施过程可以为:

[0154]

通过tts模型对第一训练文本信息进行语言学习,得到第一训练文本信息的底层结构特征;

[0155]

通过tts模型对第一训练文本信息的底层结构特征和第一训练文本信息的情感向量进行解码处理,得到第一训练文本信息对应的预测语音信息。

[0156]

在一个实施例中,处理器501基于语音合成损失值对语音合成模型中的tts模型的参数和gst模型的参数进行调整,以对语音合成模型进行训练,得到训练后的语音合成模型之后,还可以实施以下过程:

[0157]

通过通信接口503获取目标文本信息;

[0158]

通过训练后的gst模型对目标文本信息进行情感预测,得到目标文本信息的情感向量;

[0159]

通过训练后的tts模型对目标文本信息和目标文本信息的情感向量进行语音合成处理,得到目标文本信息对应的预测语音信息。

[0160]

在一个实施例中,处理器501通过通信接口503获取目标文本信息的具体实施过程可以为:

[0161]

显示目标文本信息;

[0162]

在接收到对目标文本信息的语音合成指令时,获取目标文本信息;

[0163]

处理器501在通过训练后的tts模型对目标文本信息和目标文本信息的情感向量进行语音合成处理,得到目标文本信息对应的预测语音信息之后,还可以实施以下过程:

[0164]

通过通信接口503输出目标文本信息对应的预测语音信息。

[0165]

本技术实施例中,通过语音合成模型中的gst模型对第一训练文本信息进行情感识别处理,得到第一训练文本信息的情感向量,并将第一训练文本信息的情感向量嵌入语音合成模型中的tts模型,进而通过tts模型基于第一训练文本信息和情感向量进行语音合

成,可实现在不对训练样本进行情感标注的前提下,仍然可以使用tts模型将文字转为情感化语音,提高语音合成模型的训练效率。

[0166]

本领域普通技术人员可以理解实现上述实施例方法中的全部或部分流程,是可以通过计算机程序来指令相关的硬件来完成,所述的程序可存储于一计算机可读取存储介质中,该程序在执行时,可包括如上述各方法的实施例的流程。其中,所述的存储介质可为磁碟、光盘、只读存储记忆体(read

‑

only memory,rom)或随机存储记忆体(random access memory,ram)等。所述的计算机可读存储介质可主要包括存储程序区和存储数据区,其中,存储程序区可存储操作系统、至少一个功能所需的应用程序等;存储数据区可存储根据区块链节点的使用所创建的数据等。

[0167]

其中,本技术所指区块链是分布式数据存储、点对点传输、共识机制、加密算法等计算机技术的新型应用模式。区块链(blockchain),本质上是一个去中心化的数据库,是一串使用密码学方法相关联产生的数据块,每一个数据块中包含了一批次网络交易的信息,用于验证其信息的有效性(防伪)和生成下一个区块。区块链可以包括区块链底层平台、平台产品服务层以及应用服务层等。

[0168]

以上所揭露的仅为本技术的部分实施例而已,当然不能以此来限定本技术之权利范围,本领域普通技术人员可以理解实现上述实施例的全部或部分流程,并依本技术权利要求所作的等同变化,仍属于发明所涵盖的范围。