1.本公开涉及一种用于执行语音识别的方法和装置,更具体地,涉及一种用于执行针对唤醒词启用(例如,对语音干扰具有鲁棒性的语音唤醒(wov))的前端处理的语音识别操作方法和装置。

背景技术:

2.随着已经开发了组合地执行各种功能的电子装置,已经发布了配备有语音识别功能的电子装置以提高可操作性。语音识别功能可以通过以免提方式(例如,无需单独的按钮操作或触摸模块的接触)识别用户的语音来容易地控制装置。

3.根据语音识别功能,例如,诸如智能电话的便携式终端和诸如电视(tv)、冰箱等的家用电器可以在不用按下单独的按钮的情况下执行呼叫功能或写入文本消息,并且可以容易地设置各种功能,例如方向导航、因特网搜索、警报设置等。

4.为了通过位于距离语音识别装置很远距离处的用户的语音来控制,语音识别装置必须能够即使在噪声环境中也确保稳定的性能。为了确保稳定的性能,可以使用语音唤醒(wov)技术,其中用户向语音识别装置通知何时开始语音识别操作。为了唤醒语音识别装置,用户可以说出唤醒词(例如,先前添加的在主指令词之前要确定的词)。wov技术是语音控制中的第一步,因此需要高精确度。

5.另一方面,人工智能(ai)系统是一种具有人类级别的智能的计算机系统。与现有的基于规则的智能系统不同,ai系统是一种可以自主地训练自己、做出决策并且变得越来越智能的系统。ai系统被使用得越多,ai系统的识别率就可改进得越高并且ai系统可以更准确地理解用户偏好,因此,现有的基于规则的智能系统逐渐被基于深度学习的ai系统所替代。

6.ai技术是指机器学习(深度学习)和利用机器学习的元素技术(element technology)。

7.机器学习是一种对输入数据的特征进行自主地分类/学习的算法技术。元素技术是一种利用诸如深度学习的机器学习算法的技术,并且包括诸如语言理解、视觉理解、推理/预测、知识表示和运动控制等技术领域。

8.ai技术被应用于如下的各种领域。语言理解是用于识别和应用/处理人类语言/字符的技术,并且包括自然语言处理、机器翻译、对话系统、查询响应、语音识别/合成等。推理预测是一种获取和逻辑地推断和预测信息的技术,并且包括基于知识/概率的推理、优化预测、基于偏好的规划、推荐等。知识表示是用于将人类体验信息自动处理成知识数据的技术,并且包括知识构建(数据生成/分类)、知识管理(数据利用)等。

技术实现要素:

9.技术问题

10.当语音识别装置在存在包括语音的噪声的环境(例如看电视的环境)中操作时,因

为现有的前端处理技术不能正确地操作(或者甚至不执行前端处理),存在语音识别装置的唤醒成功率显著恶化的问题。

11.技术方案

12.根据本公开的实施例,语音识别方法包括:接收第一多声道音频信号;从第一多声道音频信号中包括的每个声道音频信号中获取针对每个频带的语音信号特性和噪声信号特性;通过基于语音信号特性、噪声信号特性以及在一定时间之前获取的语音信号特性对所述第一多声道音频信号进行波束形成,生成具有经增强语音分量的信号;基于具有经增强语音分量的信号启用语音识别操作;对第二多声道音频信号进行语音识别并输出语音识别结果。

附图说明

13.从结合附图的以下描述中,本公开的某些实施例的上述和其它方面、特征和优点将变得更加明显,其中:

14.图1是用于说明在存在语音干扰的环境中语音识别操作的唤醒成功率恶化的问题的图;

15.图2a是用于描述根据本公开的实施例的语音识别系统的图;

16.图2b是用于描述根据本公开的实施例的语音识别系统的图;

17.图2c是用于描述根据本公开的实施例的语音识别系统的图;

18.图3a是根据本公开的实施例的语音识别装置的框图;

19.图3b是根据本公开的实施例的语音识别装置的框图;

20.图3c是根据本公开的实施例的语音识别服务器的框图;

21.图4示出唤醒方法;

22.图5示出根据本公开的实施例的双唤醒方法;

23.图6是示出根据本公开的实施例而并行地执行的双波束形成方法的图;

24.图7是示出根据本公开的实施例而使用的短时傅里叶变换(stft)的图;

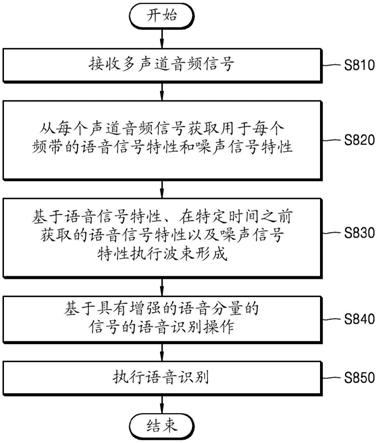

25.图8是根据本公开的实施例的语音识别方法的流程图;

26.图9是根据本公开的实施例的语音识别方法的详细流程图;

27.图10示出根据本公开的实施例的基于神经网络的掩码计算方法;

28.图11示出根据本公开的另一个实施例的基于神经网络的掩码计算方法;以及

29.图12是说明根据本公开的另一个实施例而选择性地执行的双波束形成方法的图。

具体实施方式

30.当语音识别装置在存在包括语音的噪声的环境(例如电视观看环境)中操作时,因为现有的前端处理技术不能正确地操作(或者甚至不执行前端处理),存在这样的问题,即语音识别装置的唤醒成功率显著恶化。

31.另外的方面将部分地在随后的描述中阐述,并且部分地将从描述中显而易见,或者可以通过本公开的所呈现的实施例的实践来获知。

32.根据本公开的实施例,语音识别方法包括:接收第一多声道音频信号;从第一多声道音频信号中包括的每个声道音频信号中获取针对每个频带的语音信号特性和噪声信号

特性;通过基于语音信号特性、噪声信号特性以及在一定时间之前获取的语音信号特性对第一多声道音频信号进行波束形成,生成具有经增强语音分量的信号;基于具有经增强语音分量的信号启用语音识别操作;对第二多声道音频信号进行语音识别并输出语音识别结果。

33.根据本公开的另一个实施例,语音识别装置包括接收器、至少一个处理器和输出接口,接收器配置成接收第一多声道音频信号;至少一个处理器配置成从包含于第一多声道音频信号中的每一声道音频信号获取用于每一频带的语音信号特性和噪声信号特性,通过基于语音信号特性、噪声信号特性和在一定时间之前获取的语音信号特性对第一多声道音频信号执行波束形成来生成具有经增强语音分量的信号,基于具有经增强语音分量的信号启用语音识别操作,以及对第二多声道音频信号进行语音识别;输出接口配置为输出语音识别结果。

34.根据本公开的另一个实施例,提供了一种计算机可读记录介质,其中存储有用于执行语音识别方法的程序,语音识别方法包括:接收第一多声道音频信号;从第一多声道音频信号中包括的每个声道音频信号中获取针对每个频带的语音信号特性和噪声信号特性;通过基于语音信号特性、噪声信号特性和在一定时间之前获取的语音信号特性对第一多声道音频信号进行波束形成,生成具有经增强语音分量的信号;基于具有经增强语音分量的信号启用语音识别操作;对第二多声道音频信号进行语音识别并输出语音识别结果。

35.根据实施例,提供了一种语音识别方法,包括:接收第一多声道音频信号;获取与第一多声道音频信号中包括的声道音频信号对应的频带中的至少一个频带的语音信号特性或噪声信号特性中的至少一个;通过基于语音信号特性、噪声信号特性以及针对在获取第二帧的时间之前的特定时间段内获取的且针对第一帧获取的语音信号特性对第一多声道音频信号进行波束形成来生成具有经增强语音分量的信号;确定经增强语音分量是否包括唤醒词;以及基于确定出经增强语音分量包括唤醒词:确定唤醒;以及基于具有经增强语音分量的信号来启用语音识别操作。

36.根据实施例,执行波束形成可以包括从当前语音去除当前语音之前的语音的估计噪声属性。

37.根据实施例,语音识别方法还可以包括:基于在语音识别操作被启用之后接收到第二多声道音频信号,对第二多声道音频信号执行语音识别。

38.根据实施例,语音识别方法还可以包括:输出语音识别结果或执行与语音识别结果相对应的特定操作。

39.根据实施例,生成具有经增强语音分量的信号可以包括:通过基于语音信号特性和噪声信号特性对第一多声道音频信号执行第一波束形成来生成第一增强信号;以及通过基于语音信号特性和在m帧之前获取的语音信号特性对第一多声道音频信号进行第二波束形成来生成第二增强信号。

40.根据实施例,启用语音识别操作可以包括:基于确定出唤醒词被包括在第一增强信号或第二增强信号中来启用语音识别操作。

41.根据实施例,第二多声道音频信号可以包括在用户说出唤醒词之后说出的语音信号。

42.第二增强信号可以是通过从语音信号特性中去除在m帧之前获取的语音信号特性

而获得的信号。

43.根据实施例,获取语音信号特性和噪声信号特性可以包括:通过对每个声道音频信号执行频率转换来获取频率窗口值;以及

44.通过应用掩码,从每个所获取的频率窗口值中获取每个频带的语音交叉功率谱密度(psd)和噪声交叉psd。

45.第一多声道音频信号可以包括通过m个声道接收的m个音频信号,语音交叉psd和噪声交叉psd是m

×

m矩阵的形式。

46.根据实施例,语音识别方法估计用于获取语音信号特性和噪声信号特性的掩码,其中掩码的估计包括:通过对第一多声道音频信号应用中值滤波器将第一多声道音频信号转换为单声道音频信号;通过对单声道音频信号的神经网络分析,估计针对每个频段的掩码值。

47.执行语音识别和输出语音识别结果可以包括:根据基于确定出唤醒词被包括在第一增强信号中而启用语音识别操作,对第二多声道音频信号执行自适应波束形成;以及根据基于确定唤醒词不包括在第一增强信号中但唤醒词包括在第二增强信号中而启用语音识别操作,对第二多声道音频信号进行固定波束形成。

48.根据实施例,语音识别方法还可以包括执行自适应波束形成,所述自适应波束形成包括通过在第二多声道音频信号的每一帧更新参数来基于更新的参数执行波束形成,并且其中,执行固定波束形成包括基于在生成第二增强信号中使用的参数对第二多声道音频信号执行波束形成。

49.可以从包括在语音识别装置中的多个麦克风接收第一多声道音频信号和第二多声道音频信号。

50.根据实施例,语音识别装置可以包括接收器、至少一个处理器,

51.其中,接收器配置为接收第一多声道音频信号,至少一个处理器配置成:接收第一多声道音频信号;获取与第一多声道音频信号中包含的声道音频信号对应的频带中的至少一个频带的语音信号特性或噪声信号特性中的至少一个;通过基于语音信号特性、噪声信号特性以及在获取第二帧之前的特定时间段内获取的且针对第一帧获取的语音信号特性对第一多声道音频信号进行波束形成来生成具有经增强语音分量的信号;确定经增强语音分量是否包括唤醒词;以及基于确定出经增强语音分量包括唤醒词:确定唤醒;以及基于具有经增强语音分量的信号来启用语音识别操作。

52.处理器还配置成通过从当前语音移除当前语音之前的语音的估计噪声属性来执行波束形成。

53.接收器可以包括多个麦克风。

54.可以从多个麦克风接收第一多声道音频信号和第二多声道音频信号。

55.根据实施例,一种其中存储有计算机程序代码的非暂时性计算机可读记录介质,计算机程序代码在被执行时使得执行以下方法:接收第一多声道音频信号;获取与第一多声道音频信号中包括的声道音频信号对应的频带的至少一个频带的语音信号特性或噪声信号特性中的至少一个;通过基于语音信号特性、噪声信号特性以及在获取第二帧的时间之前的特定时间段内获取的且针对第一帧获取的语音信号特性对第一多声道音频信号进行波束形成来生成具有经增强语音分量的信号,并且确定经增强语音分量是否包括唤醒

词;以及基于确定出经增强语音分量包括唤醒词:确定唤醒;以及基于具有经增强语音分量的信号来启用语音识别操作。

56.根据实施例,用于电子数字语音助理装置的前端处理方法可以包括:通过对多声道音频信号执行波束形成来生成语音增强信号;以及基于语音增强信号确定是否唤醒,其中执行波束形成包括从当前语音中去除当前语音之前的语音的估计噪声属性。

57.根据实施例,执行波束形成包括:使用特征值(gev)波束形成器,该gev波束形成器获取用于构成滤波器的滤波器系数,该滤波器使通过对多声道音频信号进行频率转换而获取的每个时间

‑

频率窗口值的信噪比(snr)最大化。

58.发明的实施例

59.在下文中,将参考附图详细描述本公开的实施例,使得本领域的普通技术人员可以容易地实现本公开。然而,本公开可以以许多不同的形式来体现,而不限于这里描述的本公开的实施例。为了清楚地描述本公开,省略了与本公开的描述无关的部分,并且附图中相同的附图标记表示相同的元件。

60.在整个公开内容中,表述“a、b或c中的至少一个”表示:仅a;仅b;仅c;a和b两者;a和c两者;b和c两者;所有的a、b和c;或其变体。

61.应当理解,当区域被称为“连接到”另一个区域时,该区域可以直接连接到所述另一个区域,或者可以通过其间的插入区域电连接到另一个区域。还应理解,本文所用的术语“包括”和/或“包含”表明所陈述的特征或组分的存在,但不排除存在或添加一个或多个其它的特征或组分。

62.在整个公开中使用的表述“根据实施例”不一定表示本公开的相同实施例。

63.本公开的上述实施例可以针对功能块组件和各种处理步骤来进行描述。这些功能块中的一些或全部可以通过被配置成执行指定功能的任何数量的硬件和/或软件组件来实现。例如,根据本公开的功能块可以通过一个或多个微处理器或通过用于某种功能的电路组件来实现。此外,例如,根据本公开的功能块可以用任何编程或脚本语言来实现。功能块可以用在一个或多个处理器上执行的算法来实现。此外,在此描述的公开可以采用根据相关技术的用于电气配置、信号处理和/或控制、数据处理等的任何数量的技术。词语“模块”和“配置”被广义地使用,而不限于本公开的机械或物理实施例。

64.此外,在所呈现的各个附图中示出的连接线或连接器旨在表示各个元件之间的示例性功能关系和/或物理或逻辑联接。应当注意,在实际装置中可以存在许多替代或附加的功能关系、物理连接或逻辑连接。

65.在下文中,将参考附图详细描述本公开。

66.语音识别接口最近已经成为用于控制智能设备的代表性元件。为了通过位于离语音识别装置相当远的距离处的用户的语音来控制,语音识别装置必须能够即使在噪声环境中也确保稳定的性能。为了确保稳定的性能,可以使用语音唤醒(wov)技术,其中用户通知语音识别装置何时开始语音识别操作。为了唤醒语音识别装置,用户说出唤醒词(唤醒关键字)。唤醒关键字可以被添加到存储一个或多个唤醒关键字的存储器中。唤醒关键字可以在处理器接受指令(例如,主指令)之前被识别。wov技术可以是语音控制的第一步,因此可能需要高精确度。

67.当语音信号被传送到语音识别装置时,由位于远离语音识别装置的距离处的用户

发出的语音信号的质量可能由于噪声和混响(reverberation)而严重恶化。根据实施例,如图1所示,当语音识别装置30在从噪声生成装置(例如,电视20)输出包括语音的噪声的环境中操作时,存在这样的问题,即唤醒语音识别装置30的成功率因用户10的唤醒词显著恶化。根据实施例,用户可能位于远离语音识别装置30的位置处。根据实施例,“远离”可以包括,例如,在房间的另一侧和/或在使得噪声生成装置或对象(例如,电视20)比远处的用户10更靠近语音识别装置30的位置处。

68.为了在存在语音噪声的环境(例如,输出具有歌词的歌曲的环境或聚集许多人的环境和/或从电视输出语音噪声的环境)中提高语音识别的准确性,可以使用根据本公开的实施例的多声道语音增强方法。

69.根据一般的多声道语音增强方法,在存在语音噪声的环境中,难以单独处理通过多声道接收的音频信号之中的、包括目标语音信号的音频信号和包括语音噪声的音频信号。然而,根据本公开的实施例,从通过多声道接收的音频信号之中确定包括唤醒词的音频信号并且将其传送到唤醒模块,从而改善用于唤醒的语音识别性能。

70.根据本公开的实施例,对多声道音频信号执行波束形成,并且因此,具有增强的目标语音分量的信号被传送到唤醒模块,从而可以改善用于唤醒的语音识别性能。根据本公开的实施例,提供了一种能够实现对语音干扰环境具有鲁棒性的唤醒词检测的前端处理方法。

71.图2a是用于描述根据本公开的实施例的语音识别系统的图。

72.如图2a所示,根据本公开的实施例的语音识别系统可以包括语音识别装置200。

73.例如,如图2a所示,语音识别装置200可以是基于人工智能技术的数字语音辅助设备。然而,本公开的实施例不限于图2a中所示的示例。语音识别装置200可以是家用电器(例如电视、冰箱、洗衣机等)、智能电话、个人计算机(pc)、可穿戴设备、个人数字助理(pda)、媒体播放器、微服务器或全球定位系统(gps)装置、电子书终端、数字广播终端、导航装置、自助服务终端(kiosk)、运动图像专家组(mpeg)

‑

1音频层iii(mp3)播放器、数字相机、或另外的移动或非移动计算装置,但不限于此。

74.根据本公开的实施例,语音识别装置200可以包括多个麦克风,用于接收在不同方向接收的音频信号。例如,当语音识别装置200是球形或圆柱形时,语音识别装置200可以包括布置在语音识别装置200的表面上的多个麦克风(例如,以规则的间隔布置在语音识别装置200的表面上)。例如,根据实施例,语音识别装置200可以包括以45度间隔设置在语音识别装置200的侧表面上的八个麦克风,从而接收从360度的所有方向接收的八个声道音频信号。然而,本公开的实施例不限于此。语音识别装置200可以通过各种数量的声道接收音频信号,例如,2个声道、4个声道、6个声道或8个声道。然而,本公开的实施例不限于此。

75.根据本公开的实施例,语音识别装置200可以对所接收的音频信号执行前端处理,以便提高语音识别的准确性。例如,语音识别装置200可以对所接收的多声道音频信号执行波束形成,以生成具有经增强目标语音信号的信号,并基于增强的信号执行语音识别。

76.当对多声道音频信号执行波束形成时,根据本公开的实施例的语音识别装置200可以指示确定的波束的方向。例如,当语音识别装置200包括多个麦克风时,语音识别装置200可以通过将发光二极管(led)布置在与每个麦克风所布置的位置对应的位置处通过使用至少一个led来指示波束形成的方向。或者,语音识别装置200可以通过围绕语音识别装

置200设置多个led或圆形led来指示通过多个麦克风接收的音频信号之中的、被确定为包括目标语音的麦克风的方向。

77.例如,当语音识别装置200执行自适应波束形成时,由于发出语音命令的用户10移动,语音识别装置200可以通过led指示用户10移动的位置(或更新的波束的方向)。作为另一个示例,当语音识别装置200执行固定波束形成时,语音识别装置200可以通过led指示固定波束的方向。

78.此外,根据本公开的实施例的语音识别装置200可以通过使用wov功能来启用语音识别功能。根据本公开的实施例的语音识别装置200可以针对先前确定的唤醒词连续地监视信号,从而当用户10说出唤醒词时启用整个语音识别功能。当语音识别装置200被唤醒时,语音识别装置200可以对唤醒词之后由用户10发出的命令执行语音识别,输出语音识别结果,或者执行与语音识别结果相对应的特定操作。

79.图2b是用于描述根据本公开的实施例的语音识别系统的图。如图2b所示,根据本公开的实施例的语音识别系统可以包括第一语音识别装置200a和第二语音识别装置200b。第一语音识别装置200a和第二语音识别装置200b可以通过线缆连接或者无线连接。第一语音识别装置200a和第二语音识别装置200b可以统称为语音识别装置200。

80.例如,根据实施例,第一语音识别装置200a可以是接收语音信号并输出语音识别结果的数字语音辅助装置。然而,本公开的实施例不限于此。第一语音识别装置200a可以是移动计算装置或非移动计算装置,例如可穿戴设备、智能电话、平板pc、pc或智能电视。第二语音识别装置200b可以是移动计算装置或非移动计算装置,例如智能电话、平板pc、pc或智能电视。第一语音识别装置200a可以与第二语音识别装置200b互操作。

81.根据本公开的实施例的第一语音识别装置200a和第二语音识别装置200b可以发送和接收控制信号或共享数据。

82.根据本公开的实施例的第一语音识别装置200a可以接收包括由用户10(例如,经由第一语音识别装置200a的麦克风)发出的语音信号的音频信号,并且将所接收的音频信号或与所接收的音频信号相对应的压缩信号发送到第二语音识别装置200b。第二语音识别装置200b可以基于从第一语音识别装置200a接收的信号执行语音识别。或者,第一语音识别装置200a可接收包括用户10发出的语音信号的音频信号,并将从所接收的音频信号中检测到的语音信号发送到第二语音识别装置200b。或者,第一语音识别装置200a可接收包括用户10发出的语音信号的音频信号,并将从所接收的音频信号中检测到的语音信号的特征发送到第二语音识别装置200b。

83.此外,根据本公开的实施例的语音识别装置200可以对所接收的音频信号执行前端处理,以便提高语音识别的准确性。前端处理可以由第一语音识别装置200a执行或者可以由第二语音识别装置200b执行。或者,前端处理可以部分地由第一语音识别装置200a和第二语音识别装置200b中的每一个执行。

84.作为示例,根据实施例,第一语音识别装置200a可以将所接收的音频信号或压缩后的信号发送到第二语音识别装置200b,并且第二语音识别装置200b可以对所接收的信号执行前端处理并执行语音识别。例如,第一语音识别装置200a可以接收包括用户10发出的语音信号的多声道音频信号,并将所接收的多声道音频信号发送到第二语音识别装置200b。第二语音识别装置200b可以对所接收的多声道音频信号执行波束形成以生成具有经

增强目标语音信号的信号,并基于增强的信号执行语音识别。

85.作为另一个示例,第一语音识别装置200a可以对所接收的音频信号执行前端处理,并将对其执行了前端处理的信号发送到第二语音识别装置200b。根据实施例,第二语音识别装置200b可以对对其执行了前端处理的信号执行语音识别。例如,根据实施例,第一语音识别装置200a可以接收包括由用户10发出的语音信号的多声道音频信号,并对所接收的多声道音频信号执行波束形成,从而生成具有经增强目标语音信号的信号。根据实施例,第一语音识别装置200a可以将增强的信号发送到第二语音识别装置200b,并且第二语音识别装置200b可以基于所接收的增强的信号执行语音识别。

86.此外,根据本公开的实施例的语音识别装置200可以通过使用wov功能来启用语音识别功能。wov操作可以由第一语音识别装置200a执行或者可以由第二语音识别装置200b执行。或者,wov操作可以部分地由第一语音识别装置200a和第二语音识别装置200b中的每一个执行。

87.作为示例,根据实施例,第二语音识别装置200b可以连续地监视唤醒词是否包括在通过第一语音识别装置200a接收的音频信号中。根据实施例,当用户10说出唤醒词时,第二语音识别装置200b可以启用整个语音识别功能。根据实施例,第二语音识别装置200b可以对用户10在唤醒词之后发出的命令执行语音识别,并且通过第一语音识别装置200a输出语音识别结果或者执行与语音识别结果相对应的特定操作。

88.作为另一个示例,根据实施例,第一语音识别装置200a可以连续地监视唤醒词是否被包括在所接收的音频信号中。当用户10说出唤醒词时,第一语音识别装置200a可以向第二语音识别装置200b通知唤醒词被说出的信息,从而唤醒第二语音识别装置200b的语音识别功能。第二语音识别装置200b可以对用户10在唤醒词之后发出的命令执行语音识别,并且通过第一语音识别装置200a输出语音识别结果或者执行与语音识别结果相对应的特定操作。

89.此外,图2c是用于描述根据本公开的实施例的语音识别系统的图。如图2c所示,根据本公开的实施例的语音识别系统可以包括语音识别装置200和语音识别服务器220。语音识别装置200和语音识别服务器220可以通过线缆连接或无线连接。根据本公开的实施例的语音识别服务器220可以与语音识别装置200共享数据。

90.例如,根据实施例,语音识别装置200可以是接收语音信号并输出语音识别结果的数字语音辅助装置。然而,本公开的实施例不限于此。语音识别装置200可以是移动计算装置或非移动计算装置,例如可穿戴设备、智能电话、平板pc、pc或智能电视。

91.根据本公开的实施例,语音识别装置200可以接收包括由用户10发出的语音信号的音频信号,并且将所接收的音频信号或与所接收的音频信号相对应的压缩信号发送到语音识别服务器220。第二语音服务器220可以基于从语音识别装置200接收的信号执行语音识别。或者,语音识别装置200可以接收包括用户10发出的语音信号的音频信号,并将从所接收的音频信号中检测到的语音信号发送到语音识别服务器220。或者,语音识别装置200可接收包括用户10发出的语音信号的音频信号,并将从所接收的音频信号中检测到的语音信号的特征发送到语音识别服务器220。

92.此外,根据本公开的实施例的语音识别装置200可以对所接收的音频信号执行前端处理,以便提高语音识别的准确性。前端处理可以由语音识别装置200执行或者可以由语

音识别服务器220执行。或者,前端处理可以部分地由语音识别装置200和语音识别服务器220中的每一个执行。

93.作为示例,语音识别装置200可以将所接收的音频信号或压缩信号发送到语音识别服务器220,并且语音识别服务器220可以对所接收的信号执行前端处理并执行语音识别。例如,语音识别装置200可以接收包括用户10发出的语音信号的多声道音频信号,并将所接收的多声道音频信号发送到语音识别服务器220。语音识别服务器220可以对所接收的多声道音频信号执行波束形成,以生成具有经增强目标语音信号的信号,并基于增强的信号执行语音识别。

94.作为另一个示例,语音识别装置200可以对所接收的音频信号执行前端处理,并将对其执行了前端处理的信号发送到语音识别服务器220。语音识别服务器220可以对执行了前端处理的信号执行语音识别。例如,语音识别装置200可以接收包括由用户10发出的语音信号的多声道音频信号,并对所接收的多声道音频信号执行波束形成,从而生成具有经增强目标语音信号的信号。语音识别装置200可以将增强的信号发送到语音识别服务器220,并且语音识别服务器220可以基于所接收的增强的信号执行语音识别。

95.此外,根据本公开的实施例的语音识别装置200可以通过使用wov功能来启用语音识别功能。wov操作可以由语音识别装置200执行,或者可以由语音识别服务器220执行。或者,wov操作可以部分地由语音识别装置200和语音识别服务器220中的每一个执行。

96.作为一个示例,语音识别服务器220可以连续地监视唤醒词是否包括在通过语音识别装置200接收的音频信号中。当用户10说出唤醒词时,语音识别服务器220可以启用语音识别功能(例如,整个语音识别功能)。语音识别服务器220可以对用户10在唤醒词之后发出的命令执行语音识别,并且通过语音识别装置200输出语音识别结果,或者执行与语音识别结果相对应的特定操作。根据实施例,在识别到唤醒词之后,可以向用户提示指示语音启用功能已经被初始化/启动的提示信息,并且语音识别装置200准备好通过语音接收命令。

97.作为另一个示例,语音识别装置200可以连续地监视唤醒词是否被包括在所接收的音频信号中。当用户10说出唤醒词时,语音识别装置200可以向语音识别服务器220通知唤醒词被说出的信息,从而唤醒语音识别服务器220的语音识别功能。根据实施例,语音识别服务器220可以对用户10在唤醒词之后发出的命令执行语音识别,并且通过语音识别装置200输出语音识别结果,或者执行与语音识别结果相对应的特定操作。

98.如图2a、图2b和图2c所示,根据本公开的实施例的语音识别系统可以包括至少一个语音识别装置,并且还可以包括设备和/或语音识别服务器。在下文中,为了便于描述,将描述由“语音识别装置”执行的语音识别方法。然而,下面描述的语音识别装置的一些或全部操作可以由用于连接语音识别装置和语音识别服务器的设备执行,并且可以部分地由多个语音识别装置执行。

99.图3a是根据本公开的实施例的语音识别装置的框图。如图3a所示,根据本公开的实施例的语音识别装置200可以包括接收器310、处理器320和输出接口330。然而,语音识别装置200可以由比图3a中所示的所有组件更多的组件来实现。图3b是根据本公开的实施例的语音识别装置的框图。

100.例如,如图3b所示,根据本公开的实施例的语音识别装置200还可以包括通信接口340和存储器350。

101.另外,图3a和图3b为了方便起见示出语音识别装置200包括一个处理器320,但是本公开的实施例不限于此,并且语音识别装置301可以包括多个处理器。当语音识别装置200包括多个处理器时,以下描述的处理器320的操作可以由多个处理器单独执行。例如,根据实施例,处理器可以包括通用处理器和图形处理单元(gpu)。gpu可以专用于学习模型。gpu可以具有比通用处理器更快的处理速度。

102.根据实施例,接收器310可以接收音频信号。例如,接收器310可以通过使用麦克风将外部声音转换为电声数据来直接接收音频信号。接收器310可以通过多个声道(例如,多个麦克风)接收多声道音频信号。

103.或者,接收器310可以接收从外部设备发送的音频信号。在图3a和图3b中,根据实施例,接收器310可以包括在语音识别装置200中,但是根据本公开的另一个实施例的接收器310可以包括在单独的装置中并且通过线缆连接到或无线连接到语音识别装置200。

104.根据实施例,接收器310可以接收多声道音频信号。根据实施例,多声道音频信号可以包括分别从多个声道接收的多个音频信号。

105.根据本公开的实施例的处理器320可以对通过接收器310接收的音频信号执行语音识别。此外,处理器320可以对所接收的音频信号执行前端处理,以便提高语音识别的准确性。例如,处理器320可以对所接收的多声道音频信号执行波束形成,以生成具有经增强目标语音信号的信号,并基于增强的信号执行语音识别。此外,处理器320可以通过使用wov功能来启用语音识别功能。

106.在下文中,将详细描述根据本公开的实施例的由处理器320执行的前端处理方法。

107.根据实施例,处理器320可以从包括在第一多声道音频信号中的每个声道音频信号获取用于每个频带的语音信号特性和噪声信号特性。

108.根据实施例,处理器320可以通过对每个声道音频信号执行频率转换来获取频率窗口值(frequency bin value)。根据实施例,处理器320可以通过将掩码应用到所获取的频率窗口值来将所获取的频率窗口值划分为对应于语音的值和对应于噪声的值。根据实施例,处理器320可以分别基于对应于语音的值和对应于噪声的值来获取每个频带的语音交叉功率谱密度(交叉psd)和噪声交叉psd。

109.例如,根据实施例,当第一多声道音频信号包括通过m个声道接收的m个音频信号时,语音交叉psd和噪声交叉psd可以是m

×

m矩阵的形式。

110.根据实施例,处理器320可以估计用于获取语音信号特性和噪声信号特性的掩码。根据实施例,处理器320可以通过对第一多声道音频信号应用中值滤波器来将第一多声道音频信号转换为单声道音频信号,以估计掩码。根据实施例,处理器320可以通过对单声道音频信号的神经网络分析来估计每个频带的掩码值。

111.根据实施例,处理器320可以基于语音信号特性、在特定时间之前获取的语音信号特性、以及噪声信号特性对第一多声道音频信号执行波束形成。根据实施例,处理器320可以作为波束形成的结果生成具有经增强语音分量的信号。例如,该特定时间可以是考虑了唤醒词和帧单元的预定长度而预先确定的时间。

112.根据实施例,处理器320可以通过基于语音信号特性和噪声信号特性对第一多声道音频信号执行第一波束形成来生成第一增强信号。根据实施例,处理器320可以通过基于语音信号特性和在m帧之前获取的语音信号特性对第一多声道音频信号执行第二波束形成

来生成第二增强信号。第二增强信号可以是其中从针对当前帧获取的语音信号特性中去除了在m帧之前获取的语音信号特性的信号。

113.根据实施例,处理器320可以基于具有经增强语音分量的信号来启用语音识别操作。

114.根据实施例,处理器320可以根据基于第一波束形成生成的第一增强信号和基于第二波束形成生成的第二增强信号来启用语音识别操作。根据实施例,处理器320可以基于确定出第一增强信号或第二增强信号中包括预设词来启用语音识别操作。

115.根据实施例,处理器320可以对新接收的第二多声道音频信号执行语音识别。根据实施例,处理器320可以对第二多声道音频信号执行语音识别,该第二多声道音频信号包括在用户已经说出预设词(例如,唤醒词)之后说出的语音信号。例如,当第一多声道音频信号是包括唤醒词的信号时,第二多声道音频信号可以是包括在唤醒词之后发出的用户命令的信号。

116.根据实施例,当基于确定出在第一增强信号中包括预设词(例如,唤醒词)而启用语音识别操作时,处理器320可以对新接收的第二多声道音频信号执行自适应波束形成。处理器320可以更新关于在第一多声道音频信号之后接收的第二多声道音频信号的参数,从而基于更新的参数执行自适应波束形成。例如,处理器320可以在第二多声道音频信号的每一帧更新参数,从而基于更新的参数执行自适应波束形成。或者,处理器320可以以某一帧间隔更新波束形成参数,从而基于更新的参数执行自适应波束形成。

117.同时,当基于确定出在第一增强信号中不包括预设词但是在第二增强信号中包括预设词而启用语音识别操作时,处理器320可以对第二多声道音频信号执行固定波束形成。处理器320可以基于在生成第二增强信号中使用的参数,对在第一多声道音频信号之后接收的第二多声道音频信号执行固定波束形成。

118.根据实施例,根据本公开的实施例的处理器320可以从输入的音频信号中提取语音信号的频率特性,并且使用声学模型和语言模型来执行语音识别。频率特性可以是指通过分析声音输入的频谱而提取的声音输入的频率分量的分布。因此,如图3b所示,语音识别装置200还可以包括存储语音模型和语言模型的存储器350。

119.输出接口330可以输出对语音信号执行语音识别的结果。输出接口330可以向用户通知语音识别的结果,或者将该结果发送到外部设备(例如,智能电话、家用电器、可穿戴设备、边缘设备、服务器等)。例如,输出接口330可以包括能够可听地输出音频信号的扬声器或能够显示视频信号的显示器。

120.或者,输出接口330可执行对应于语音识别结果的操作。例如,语音识别装置200可以确定语音识别装置200的与语音识别结果对应的功能,并通过输出接口330输出可显示信息(例如,执行该功能的图形用户界面)。或者,语音识别装置200可以将对应于语音识别结果的关键字(例如,经由通信接口340)发送到外部服务器,从服务器(例如,经由通信接口340)接收与所发送的关键字相关的信息,并通过输出接口330在屏幕上输出该信息。

121.图3b的通信接口340可以通过有线通信或无线通信与外部设备、装置或服务器通信。通信接口340可以从外部设备接收音频信号、语音信号、语音信号的特征、语音识别结果、与唤醒词有关的信息、用于前端处理的参数等。或者,通信接口340可以将音频信号、语音信号、语音信号的特征、语音识别结果、与唤醒词有关的信息、用于前端处理的参数等发

送到外部设备。根据本公开的实施例的通信接口340可以包括短距离通信模块、有线通信模块、移动通信模块、广播接收模块等。

122.根据实施例,图3b的存储器350可以存储用于执行语音识别的声学模型、语言模型、用于执行说话者识别的针对登记说话者的语音信号的登记说话者模型、语音识别历史、与唤醒词有关的信息、以及从前一帧获取的信号特性。

123.此外,图3c是根据本公开的实施例的语音识别服务器的框图。如图3c所示,根据本公开的实施例的语音识别装置200可以包括通信接口360和处理器370。图3c的通信接口360和处理器370可以对应于图3a和图3b的通信接口340和处理器320,因此将省略其多余的描述。

124.根据实施例,根据本公开的实施例的语音识别装置200可以通过通信接口360从语音识别装置200接收音频信号或压缩信号。或者,语音识别服务器220可以通过通信接口360接收由语音识别装置200对其执行了前端处理的信号。处理器370可以对所接收的信号执行语音识别。

125.作为示例,根据实施例,处理器370可以通过基于从前一帧获取的语音信号的特性对第一多声道音频信号的当前帧执行波束形成来生成具有经增强语音分量的信号。或者,处理器370可以从语音识别装置200接收具有经增强语音分量的信号。根据实施例,处理器370可以基于具有经增强语音分量的信号来启用语音识别操作,并且对新接收的第二多声道音频信号执行语音识别。

126.作为另一个示例,根据实施例,处理器370可以基于从语音识别装置200接收的指示唤醒已经成功执行的信号来启用语音识别操作,并且对新接收的第二多声道音频信号执行语音识别。

127.根据实施例,处理器370可以控制通信接口360将语音识别结果发送到语音识别装置200。

128.在下文中,将描述根据本公开的实施例的语音识别装置200或语音识别服务器220的详细操作方法。下面描述的方法的每个操作可以由上述语音识别装置200和/或语音识别服务器220的相应配置来执行。为了便于描述,尽管描述了语音识别装置200是操作的主体的示例,但是即使当用于连接多个语音识别装置的装置或语音识别服务器是操作的主体时,也可以应用以下描述。

129.图4示出唤醒方法。

130.在使用利用wov技术的语音识别装置中,由位于远距离的用户发出的语音信号在被发送到语音识别装置时可能由于噪声和混响而在质量方面严重劣化。因此,在确定唤醒词是否包括在由语音识别装置接收的音频信号中之前,需要前端处理,用于去除包括在音频信号中的噪声和混响。

131.特别地,多声道语音增强可用于通过位于远离语音识别装置的距离处的用户的语音来提高唤醒精确度。例如,波束形成可以用作多声道语音增强方法。波束形成是指设计时空滤波器以增强目标信号。

132.前端处理方法可以包括:通过对多声道音频信号执行波束形成来生成语音增强信号(401),以及基于语音增强信号确定是否唤醒(403)。

133.根据一般的前端处理方法,可以使用广义特征值(gev)波束形成器。根据下面的公

式1,gev波束形成器可以获取这样的参数,该参数使通过对多声道音频信号进行频率转换而获取的每个时间

‑

频率窗口值的信噪比(snr)最大化。例如,gev波束形成器可以获取用于构成用于增强目标语音信号的滤波器的滤波器系数。

134.【公式1】

[0135][0136]

r

s

(f,n)=λr

n

(f,n)w

[0137]

在【公式1】中,p{a}可以表示a的第一主分量。r

s

(f,n)可以是每个时间

‑

频率窗口的语音信号特性,r

n

(f,n)可以是每个时间

‑

频率窗口的噪声信号特性。例如,r

s

(f,n)可以是清晰语音的交叉psd,并且r

n

(f,n)可以是噪声的交叉psd。f表示指示频率窗口的频率索引,并且n表示作为波束形成目标的多声道音频信号的帧索引。例如,当多声道音频信号是m声道输入信号时,r

s

(f,n)和r

n

(f,n)可以由m

×

m矩阵表示。

[0138]

在图4的唤醒操作403中,语音识别装置200可以通过波束形成来分析其中增强了目标语音分量的信号,并且确定先前确定的唤醒词是否包括在该信号中。当先前确定的唤醒词被包括在该信号中时,语音识别装置200可以唤醒语音识别功能。

[0139]

然而,图4所示的前端处理方法是基于这样的假设,即目标语音信号和噪声信号的频谱分布可以彼此区分开来。因此,当如以上参考图1所描述的那样语音噪声被包括在噪声信号中时,唤醒精确度可能变差。

[0140]

具体描述为什么在存在语音噪声的环境中唤醒精确度可能恶化的原因:在前端处理操作中,可以估计用于确定在每个时间

‑

频率窗口中语音分量占主导地位还是噪声分量占主导地位的频谱掩码。在每个时间

‑

频率窗口内,估计的掩码可以包括指示语音分量的比例的语音掩码和指示噪声分量的比例的噪声掩码。在语音干扰环境中,可能在很大程度上估计出其中语音噪声占主导地位的时间

‑

频率窗口的语音掩码。因此,可能通过在波束形成操作中增强包括语音噪声的语音分量来输出质量劣化的信号。

[0141]

为了解决这个问题,本公开提出了一种用于对语音干扰具有鲁棒性的wov的新的前端处理方法。对于对语音干扰具有鲁棒性的操作,根据本公开的实施例的语音识别装置200还可以包括对语音干扰具有鲁棒性的波束形成器。

[0142]

根据本公开的实施例的对语音干扰具有鲁棒性的波束形成器可操作以从当前帧的语音特性中去除在特定时间之前的帧的语音特性。该特定时间可以根据唤醒词的长度、用户的发声特性以及用户发出唤醒词所需的时间而改变。

[0143]

例如,基于在非常短的时间(例如,小于1秒)内发出唤醒词的特性,对语音干扰具有鲁棒性的波束形成器可以使用在特定时间(例如,1秒)之前的语音输入特性和当前的语音输入特性之间的差来执行波束形成。

[0144]

如图5所示,根据本公开的实施例的语音识别装置200可以包括:执行用于前端处理的一般波束形成方法的第一波束形成器511和执行新提出的波束形成方法的第二波束形成器512、以及基于其中语音分量由第一波束形成器511和第二波束形成器512增强了的信号来确定是否唤醒的双唤醒模块420。

[0145]

同时,根据本公开的实施例,除了图5所示的波束形成之外,还可以执行各种前端处理操作。例如,在执行波束形成之前,可以执行自动回声消除(aec)、残余回声降低(残余回声抑制)等。此外,可以对通过对多声道音频信号执行波束形成而输出的单声道信号附加

地执行噪声抑制。

[0146]

根据实施例,由图5的第一波束形成器511执行的一般波束形成方法可以与由图4的波束形成器401执行的方法相同,因此省略了冗余描述。

[0147]

如【公式2】所示,可以将修改的噪声信号特性应用于包括在第二波束形成器512中的新提出的波束形成器gev

prop

。

[0148]

【公式2】

[0149][0150][0151]

在【公式2】中,r

s

(f,n

‑

m)表示m帧之前的语音信号特性。例如,r

s

(f,n

‑

m)可以是从m帧的前一帧获取的语音交叉psd。

[0152]

所提出的波束形成器gev

prop

可操作以从当前帧的输入中去除与m帧之前的帧的语音信号特性相对应的分量。

[0153]

例如,根据实施例,当一个帧是16ms并且m是60时,所提出的波束形成器gev

prop

可以操作以从当前语音的特性中去除0.96秒之前的语音的估计属性。因此,在本公开中提出的波束形成器gev

prop

即便在语音干扰环境中也可以去除语音噪声并且输出具有增强的目标语音的信号,从而改善唤醒性能。

[0154]

然而,在本公开中提出的波束形成器gev

prop

不限于【公式2】,并且可以使用整个输入信号特性r(f,n)来代替语音信号特性r

s

(f,n)。

[0155]

如图5所示,甚于根据本公开的实施例的对语音干扰具有鲁棒性的双唤醒方法,可以同时生成通过一般前端处理方法所形成的输出和通过对语音干扰具有鲁棒性的前端处理方法所形成的输出。

[0156]

根据实施例,执行一般波束形成方法的第一波束形成器511和执行新提出的波束形成方法的第二波束形成器512可以彼此互补。因此,根据本公开的实施例的语音识别装置可以并行地使用第一波束形成器511和第二波束形成器512来执行语音增强,从而生成两个单独增强的语音信号。每个增强的语音信号都可以被提供给双唤醒模块520,并且双唤醒模块520可以基于增强的语音信号来确定是否唤醒。

[0157]

作为示例,当确定先前确定的唤醒词被包括在从第一波束形成器511输出的第一增强信号或从第二波束形成器512输出的第二增强信号中时,双唤醒模块520可以确定唤醒语音识别功能。

[0158]

作为另一示例,根据实施例,双唤醒模块520可以基于先前确定的唤醒词被包括在第一增强信号中的置信度得分或先前确定的唤醒词被包括在第二增强信号中的置信度得分中的至少一个来确定唤醒语音识别功能。

[0159]

同时,当基于前端处理输出信号在语音干扰环境中唤醒语音识别功能时,根据本公开的实施例的语音识别装置200可以在对应于前端处理输出信号的方向上利用固定波束形成来执行语音识别。

[0160]

根据本公开的实施例的语音识别装置200可以通过在一般环境中执行自适应波束形成来自适应地执行波束形成,同时跟随移动声源的位置。同时,语音识别装置200可以假

定说话者在语音干扰环境中发出在与说话者发出唤醒词的位置相同的位置持续的命令,并执行固定的波束形成,从而最小化语音噪声的干扰并提高语音识别的精确度。

[0161]

下面将参考图9更详细地描述在唤醒之后在自动语音识别(asr)操作中选择性地执行自适应波束形成和固定波束形成的特定方法。

[0162]

在下文中,将参考图6描述图5所示的根据本公开的实施例的双波束形成器的特定操作。

[0163]

根据本公开的实施例的语音识别装置200可以对多声道音频信号执行加窗和频率转换(操作610)。例如,根据本公开的实施例的语音识别装置200可以执行加窗和短时傅里叶变换(stft)。

[0164]

如图7所示,根据本公开的实施例的语音识别装置200可以对通过以特定时间间隔对所接收的音频进行采样而获取的音频信号710执行加窗,从而获取预定时域的帧720。语音识别装置200可以通过对帧720执行时间

‑

频率转换730来获取每个频带的频率窗口值740。

[0165]

下面将描述将k阶stft应用于通过m个麦克风输入的m声道音频信号的示例性实施例。在对每个声道的音频信号执行用于每个帧的复快速傅里叶变换(complex fast fourier transform)之后,可以由复快速傅里叶变换信号的一半获取(k/2+1)阶频率窗口值。

[0166]

根据本公开的实施例的语音识别装置200可以针对所获取的频率窗口值740来估计掩码(操作620)。

[0167]

根据实施例,语音识别装置200可以估计频谱掩码,该频谱掩码指示每个频率窗口上的语音分量或噪声分量的存在。所估计的掩码可用于计算构成时空滤波器的系数(即,波束形成器的参数)所必需的语音信号统计数据和噪声信号统计数据。

[0168]

根据本公开的实施例的语音识别装置200可以估计两个掩码。所估计的掩码中的一个可以指示哪些时间

‑

频率窗口可能由语音支配。另一个可以指示哪些时间

‑

频率窗口大概由噪声支配。

[0169]

所估计的掩码可用于估计每个频带的噪声信号特性和语音信号特性。

[0170]

语音识别装置200可以通过将估计的掩码值应用到每个频率窗口来区分对应于清晰语音的部分和对应于音频信号中的噪声的部分。语音识别装置200可以分别计算语音交叉psd和噪声交叉psd作为语音信号特性和噪声信号特性。

[0171]

当接收到m声道音频信号时,语音识别装置200可以将每个时间频率窗口的m声道输入特性指示为m

×

m交叉psd。m

×

m交叉psd中的对角线值可以表示每个声道音频信号的功率。在m

×

m交叉psd中,非对角线值可以意味着两个声道音频信号之间的相关性,并且相位值可以意味着两个声道音频信号之间的时间延迟。

[0172]

根据本公开的实施例,为了改善基于波束形成的语音识别的性能,可以使用利用了神经网络的支持神经网络的广义特征向量(nn

‑

gev)波束形成器。nn

‑

gev波束形成是基于深度学习的时间

‑

频率掩码估计和gev波束形成的组合。将参考下面的图10和图11更详细地描述使用基于nn的分类器来估计掩码的特定方法。

[0173]

根据实施例,语音识别装置200可以通过基于针对当前帧估计的掩码更新针对前一帧获取的噪声信号特性来新获取噪声信号特性(操作630)。语音识别装置200可以通过基

于针对当前帧估计的掩码更新针对前一帧获取的语音信号特性来新获取语音信号特性(操作640)。

[0174]

根据实施例,语音识别装置200可以基于针对当前帧获取的噪声信号特性和语音信号特性来执行波束形成(操作651)。根据实施例,波束形成(操作651)可以与由图4的波束形成器401执行的方法相同,因此省略了冗余描述。

[0175]

根据实施例,语音识别装置200可以通过对波束形成的结果执行傅里叶逆变换和重叠相加(操作661)来生成具有经增强语音分量的输出信号。

[0176]

同时,语音识别装置200可基于从当前帧获取的语音信号特性和在m帧之前获取的语音信号特性645来执行本公开中新提出的对语音干扰具有鲁棒性的波束形成(操作652)。波束形成(操作652)与由图5的第二波束形成器512执行的方法相同,因此省略了冗余描述。

[0177]

接下来,语音识别装置200可以通过对波束形成的结果执行快速傅里叶逆变换和重叠相加来生成具有经增强语音分量的输出信号(操作662)。

[0178]

如上所述,根据使用根据本公开的实施例的波束形成方法的前端处理技术,可以从通过多声道接收的音频信号之中确定包括唤醒词的音频信号并将其发送到唤醒模块,并且因此可以改善用于唤醒的语音识别性能。因此,根据使用根据本公开的实施例的波束形成方法的前端处理技术,即使在远离语音识别装置200的用户的发声方面,也可以改善语音识别性能。

[0179]

此外,基于根据相关技术的基于单个声道(或包括一个参考声道和一个辅助声道的两个声道)的自适应噪声消除(anc)方法,存在的缺点在于,由于即使在没有语音干扰的一般环境中也会输出失真的语音信号,因此在asr中可能无法预期高性能。

[0180]

然而,根据本公开的实施例,可在执行图6所示的波束形成651和652之后执行各种后处理操作。例如,可以通过对波束形成的结果应用附加的后置滤波器来进一步减小失真。根据本公开的实施例的前端处理方法可以通过执行盲分析归一化(ban,blind analytic normalization)滤波作为后滤波的示例来执行最小方差无失真响应(mvdr)波束形成。根据本公开的实施例的前端处理方法可以使用mvdr波束形成方法在一般环境以及语音干扰环境中输出无失真的语音增强信号,其中mvdr波束形成方法在gev波束形成结果中另外使用ban滤波器。

[0181]

根据本公开的实施例,从先前接收的帧中获取的滤波器系数不按原样应用于当前帧,而是使用关于过去估计的语音分量的统计数据(例如,语音交叉psd)和当前估计的语音分量的统计数据来确定当前帧的滤波器系数,并且因此可以输出进一步无失真的语音增强信号。

[0182]

此外,根据本公开的实施例获取的交叉psd可以用于各种前端技术,例如噪声抑制和声源定位以及波束形成。

[0183]

在下文中,参考图8,将描述根据上述公开的实施例的语音识别装置200被唤醒并使用双波束形成方法执行语音识别的整个操作方法。

[0184]

图8所示的语音识别方法可以包括由图3a、图3b或图3c中的任何一个所示的语音识别装置200和语音识别服务器220处理的操作。因此,即使在下面省略时,关于语音识别装置200和语音识别服务器220提供的描述也可以应用于图8的语音识别方法。省略了冗余的描述。

[0185]

在操作s810,根据本公开的实施例的语音识别装置200可以接收第一多声道音频信号。

[0186]

根据实施例,多声道音频信号可以包括分别从包括在语音识别装置200中的多个麦克风接收的音频信号。

[0187]

在操作s820中,根据本公开的实施例的语音识别装置200可以从包括在第一多声道音频信号中的每个声道音频信号获取用于每个频带的语音信号特性和噪声信号特性。

[0188]

根据实施例,语音识别装置200可以通过对每个声道音频信号执行频率转换来获取频率窗口值。语音识别装置200可以通过估计掩码并将所估计的掩码应用到所获取的频率窗口值来将所获取的频率窗口值划分为对应于语音的值和对应于噪声的值。语音识别装置200可以分别基于对应于语音的值和对应于噪声的值来获取针对每个频带的语音交叉psd和噪声交叉psd。

[0189]

例如,当第一多声道音频信号包括通过m个声道接收的m个音频信号时,语音识别装置200可以针对每个频率窗口获取关于m个声道音频信号的m

×

m语音交叉psd和m

×

m噪声交叉psd。

[0190]

根据实施例,语音识别装置200可以通过使用神经网络来估计用于获取语音信号特性和噪声信号特性的掩码。根据实施例,语音识别装置200可以通过对第一多声道音频信号应用中值滤波器来将第一多声道音频信号转换为单声道音频信号,并且可以通过对单声道音频信号的神经网络分析来估计每个频带的掩码值。

[0191]

在操作s830中,根据本公开的实施例的语音识别装置200可以基于语音信号特性、在特定时间之前获取的语音信号特性以及噪声信号特性对第一多声道音频信号执行波束形成,从而生成具有经增强语音分量的信号。

[0192]

根据实施例,语音识别装置200可以通过基于在操作s820中获取的针对当前帧的语音信号特性和噪声信号特性对第一多声道音频信号执行第一波束形成来生成第一增强信号。第一增强信号可以是其中从音频信号中去除了噪声信号特性的信号。

[0193]

此外,语音识别装置200可以通过基于针对当前帧的语音信号特性和针对m帧之前的帧所获取的语音信号特性,对第一多声道音频信号执行第二波束形成来生成第二增强信号。根据实施例,第二增强信号可以是其中从语音信号特性中去除了在m帧之前获取的语音信号特性的信号。

[0194]

在操作s840,根据本公开的实施例的语音识别装置200可以基于具有经增强语音分量的信号来启用语音识别操作。

[0195]

根据实施例,语音识别装置200可以基于确定出第一增强信号或第二增强信号中包括预设词来启用语音识别操作。

[0196]

在操作s850,根据本公开的实施例的语音识别装置200可以对新接收的第二多声道音频信号执行语音识别,并输出语音识别的结果。第二多声道音频信号可以包括在用户已经说出预设词(例如,唤醒词)之后说出的语音信号。例如,当第一多声道音频信号是包括唤醒词的信号时,第二多声道音频信号可以是包括在唤醒词之后发出的用户语音命令的信号。

[0197]

根据实施例,根据本公开的实施例的语音识别装置200可以根据在唤醒期间使用的波束形成方法来选择性地使用自适应波束形成和固定波束形成。

[0198]

根据实施例,在操作s840中,当语音识别操作基于确定出预设词被包括在第一增强信号中而被启用时,语音识别装置200可以对第二多声道音频信号执行自适应波束形成。语音识别装置200可以更新关于第二多声道音频信号的参数,从而基于更新的参数执行自适应波束形成。语音识别装置200可以计算关于第二多声道音频信号的至少一个帧的语音信号特性和噪声信号特性,并且基于计算结果更新波束形成器的参数。

[0199]

例如,语音识别装置200可以在第二多声道音频信号的每一帧更新参数,从而基于更新的参数执行自适应波束形成。或者,语音识别装置200可以在某一帧间隔更新波束形成参数,从而基于更新的参数执行自适应波束形成。

[0200]

根据自适应波束形成,可以分析新接收的多声道音频信号的至少一个帧的目标信号分量和噪声信号分量,并且可以基于分析结果来更新用于增强目标信号的滤波器系数。因此,根据自适应波束形成,可以使用自适应可变波束来执行波束形成。

[0201]

同时,在操作s840中,当语音识别操作基于确定出预设词不包括在第一增强信号中但预设词包括在第二增强信号中而被启用时,语音识别装置200可以对第二多声道音频信号执行固定波束形成。语音识别装置200可以基于在生成第二增强信号中使用的参数,对第二多声道音频信号执行固定波束形成。语音识别装置200可以使用在唤醒期间使用的波束形成器的参数对新接收的多声道音频信号执行波束形成。

[0202]

如图9所示,为了在语音干扰环境中保持高唤醒成功率,根据本公开的实施例的语音识别装置200可以在唤醒操作中执行双前端处理过程(s910)和双唤醒过程(s920)。

[0203]

在操作s910中,语音识别装置200可以并行执行一般前端处理和对语音干扰具有鲁棒性的前端处理以用于双前端处理。具体地,语音识别装置200可以执行双波束形成,其中并行地执行一般波束形成和新提出的对对语音干扰具有鲁棒性的波束形成。关于并行执行的双波束形成,可以应用图5和图6的描述。省略了冗余的描述。

[0204]

在操作s920中,语音识别装置200可以基于其中通过一般波束形成增强了语音分量的信号或者其中通过对语音干扰具有鲁棒性的波束形成增强了语音分量的信号来确定是否唤醒。

[0205]

基于在操作s920中确定唤醒语音识别功能,在操作s930中,语音识别装置200可以对唤醒词之后发出的主指令(命令)执行语音识别,并输出语音识别结果。

[0206]

基于在操作s920中确定唤醒语音识别功能,在操作s931中,语音识别装置200可以确定是否基于通过一般波束形成增强了的信号来确定唤醒词。

[0207]

根据实施例,根据基于通过一般波束形成增强了的信号确定出唤醒(s931=yes),在操作s933,语音识别装置200可以对新接收的多声道音频信号执行自适应波束形成。根据实施例,新接收的多声道音频信号可以包括用户在唤醒词之后发出的主指令。

[0208]

根据基于通过一般波束形成增强了的信号未确定出唤醒(s931=否),语音识别装置200可以在操作s935中固定波束。根据实施例,在操作s935,语音识别装置200可以对新接收的多声道音频信号执行固定波束形成。

[0209]

在识别相对短长度(例如,小于1秒)的唤醒词的唤醒操作中,可以通过使用对语音干扰具有鲁棒性的波束形成来改善语音干扰环境中的唤醒性能。然而,在对相对长的长度(例如,1秒或更长)的话语执行语音识别的asr操作中,当使用对语音干扰具有鲁棒性的波束形成时,不能保证语音识别性能。

[0210]

因此,在语音识别装置200通过对语音干扰具有鲁棒性的波束形成而唤醒之后,语音识别装置200可以在预处理用于asr的音频信号中使用一般波束形成方法。语音识别装置200被唤醒可以意味着对语音干扰具有鲁棒性的波束形成被操作来正确地以说话者的发声为目标。因此,语音识别装置200即使在语音干扰环境中也可以通过在唤醒时保持波束来改善语音识别性能。

[0211]

当语音识别装置200基于通过对语音干扰具有鲁棒性的波束形成增强了的信号被唤醒时,需要波束固定,但是当语音识别装置200基于一般波束形成被唤醒时,可以使用自适应波束。

[0212]

同时,根据本公开的实施例的语音识别装置200可以使用利用了神经网络的gev波束形成器来改善基于波束形成的语音识别性能。

[0213]

图10示出根据本公开的实施例的基于神经网络的掩码计算方法。如图10所示,根据实施例,语音识别装置200可以通过针对多声道音频信号1010对每个声道的音频信号进行神经网络分析来区分语音分量和噪声分量(1020)。语音识别装置200可以对语音分量和噪声分量(1031,1032)中的每一个应用中值滤波器。语音识别装置200可以基于应用了中值滤波器的语音分量和应用了中值滤波器的噪声分量来估计掩码(1040)。语音识别装置200可以基于估计的掩码来获取语音交叉psd(1051),并且获取噪声交叉psd(1052)。语音识别装置200可以基于语音交叉psd和噪声交叉psd执行gev波束形成(1060)。

[0214]

同时,根据本公开的另一个实施例,可以使用图11所示的基于神经网络的掩码计算方法。为了减少前端处理期间所需的计算过载,可以在对多声道音频信号1110执行神经网络分析之前应用中值滤波器。

[0215]

如图11所示,语音识别装置200可以通过应用中值滤波器(1120)将多声道音频信号1110转换为单声道音频信号。语音识别装置200可以对单声道音频信号执行优化的神经网络分析(1130)。语音识别装置200可以通过神经网络分析来估计源频谱。语音识别装置200可以基于通过神经网络分析估计的源频谱来估计掩码(1140)。语音识别装置200可以基于估计的掩码来获取语音交叉psd(1151)并获取噪声交叉psd(1152)。语音识别装置200可以基于语音交叉psd和噪声交叉psd执行双波束形成(1060)。双波束形成可以意味着并行地基于针对当前帧的语音信号特性和噪声信号特性执行一般波束形成,并且基于针对当前帧的语音信号特性和m帧之前的语音信号特性执行对语音干扰具有鲁棒性的波束形成。

[0216]

如以上参考图3a至图9所描述的那样,根据本公开的实施例的语音识别装置200可以并行地使用一般波束形成器和对语音干扰具有鲁棒性的波束形成器来对多声道音频信号执行语音增强。根据本公开的实施例的语音识别装置200可以基于由两个波束形成器生成的两个语音信号来确定是否唤醒。

[0217]

然而,本公开不限于本公开的上述实施例。例如,当由于硬件限制而不可能并行操作两个波束形成器时,可以选择性地使用一般波束形成器和对语音干扰具有鲁棒性的波束形成器。

[0218]

如图12所示,根据本公开的另一个实施例的语音识别装置200可以通过语音活动检测(vad)模块相对于多声道音频信号来检测语音操作(s1210)。当语音噪声被包括在多声道音频信号中时,语音识别装置200可以确定语音是否继续用于m帧或更多帧(s1220)。

[0219]

根据实施例,当语音继续用于m帧或更多帧时,语音识别装置200可以确定语音识

别装置200处于语音干扰环境中,并且通过仅打开对语音干扰具有鲁棒性的波束形成器来执行波束形成(s1231)。语音识别装置200可以在语音不继续用于m帧或更多帧时确定语音识别装置200处于没有语音干扰的一般环境中,并且通过仅打开一般波束形成器来执行波束形成(s1232)。

[0220]

因此,根据图12中所示的本公开的另一个实施例的语音识别装置200可基于执行一般波束形成的结果和执行对语音干扰具有鲁棒性的波束形成的结果中的一者来执行确定是否唤醒的单次唤醒,从而减少功率消耗和计算负载。

[0221]

本公开的实施例可以在包括存储在计算机可读存储介质上的指令的软件程序中实现。

[0222]

根据实施例,计算机可以包括根据本公开的实施例的图像发送装置和图像接收装置,它们是能够从存储介质调用存储的指令并且根据所调用的指令执行根据本公开的实施例的操作的装置。

[0223]

根据实施例,可以以非暂时性存储介质的形式提供计算机可读存储介质。这里,“非暂时性”意味着存储介质不包括信号并且是有形的,但是不区分数据是半永久地还是临时地存储在存储介质上。

[0224]

此外,可以在计算机程序产品中提供根据本公开的实施例的电子装置或方法。计算机程序产品可以作为产品在卖方和买方之间交易。

[0225]

根据实施例,计算机程序产品可以包括软件程序和其中存储有软件程序的计算机可读存储介质。例如,计算机程序产品可以包括软件程序形式的产品(例如,可下载的应用),该软件程序通过电子装置的制造商或电子市场(例如,google play store和app store)电子分发。对于电子分发,软件程序的至少一部分可以被存储在存储介质上或者可以被临时生成。在这种情况下,存储介质可以是制造商的服务器、电子市场的服务器或临时存储sw程序的继电器的存储介质。

[0226]

根据实施例,在包括服务器和终端(例如,图像发送装置或图像接收装置)的系统中,计算机程序产品可以包括服务器的存储介质或者终端的存储介质。或者,当存在与服务器或终端通信的第三装置(例如,智能电话)时,计算机程序产品可以包括第三装置的存储介质。或者,计算机程序产品可以包括软件程序本身,该软件程序本身从服务器传输到终端或第三装置,或者从第三装置传输到终端。

[0227]

在这种情况下,服务器、终端和第三装置中的一个可以执行计算机程序产品以执行根据本公开的实施例的方法。或者,服务器、终端和第三装置中的两个或更多可以执行计算机程序产品以分发根据本公开的实施例的方法。

[0228]

例如,服务器(例如,云服务器或ai服务器等)可以执行存储在服务器中的计算机程序产品,以控制与服务器通信的终端执行根据本公开的实施例的方法。

[0229]

对于另一示例,第三装置可以执行计算机程序产品以控制与第三装置通信的终端执行根据本公开的实施例的方法。例如,第三装置可以远程控制图像发送装置或图像接收装置来发送或接收打包图像。

[0230]

当第三装置执行计算机程序产品时,第三装置可以从服务器下载计算机程序产品并执行下载的计算机程序产品。或者,第三装置可执行以预下载方式提供的所提供的计算机程序产品以执行根据本公开的实施例的方法。