一种用于ar眼镜的语音信息处理方法及系统

技术领域

1.本技术涉及计算机技术领域,具体而言,涉及一种用于ar眼镜的语音信息处理方法及系统。

背景技术:

2.语音识别功能目前在手机上已经越来越普遍了,逐渐成为一种新的输入方式,解决了很多的交互场景的问题。但是,在使用手机的语音识别功能时,需要靠近手机或者保证周围环境的安静才能达到良好的识别效果,如果要识别对话的对方的内容,举到对方面前也是比较尴尬的事情。

3.目前,市场上现有技术的缺点:

4.(1)手机上的语音识别和翻译,需要手动点击开始结束,而且无法识别对方还是自己的语音内容;

5.(2)手机识别和翻译,需要安静的环境或靠近才能解决周围噪音对语音识别造成的影响。

6.(3)使用手机在进行语音识别和翻译的时候,需要实时操作,有累赘感。

7.针对相关技术中手机上的语音识别和翻译,需要手动点击开始结束,而且无法识别对象,需要安静的环境或靠近才能降低周围噪音对语音识别造成的影响,需要实时操作,有累赘感的问题,目前尚未提出有效的解决方案。

技术实现要素:

8.本技术的主要目的在于提供一种用于ar眼镜的语音信息处理方法及系统,以解决上述问题。

9.为了实现上述目的,根据本技术的一个方面,提供了一种用于ar眼镜的语音信息处理方法。

10.根据本技术的用于ar眼镜的语音信息处理方法包括:

11.通过两个或多个麦克风组成的麦克风阵列收音;

12.通过本地算法运算或者云端计算识别对话人的声音;

13.通过语音处理算法将语音数据识别为文本信息;

14.通过无线网络连接模块将数据发送给云端服务器并接收服务器返回的信息;

15.将接收到的云端服务器的返回处理信息,展示在ar眼镜片上。

16.进一步的,还包括通过集成运算单元执行算法运算并控制整个系统的工作逻辑。

17.进一步的,所述通过两个或多个麦克风组成的麦克风阵列收音具体包括:

18.通过物理结构实现人声和环境声的定向采集,提高定向音频的敏锐度;

19.通过波束形成技术实现人声的算法增强。

20.进一步的,所述通过物理结构实现人声和环境声的定向采集,包括通过调整麦克风的不同指向,配合外部的收音结构获取到不同方向上的声音,收音结构包括但不限于特

殊设计的圆筒状或圆锥状结构、密封机构在内的一种或几种。

21.进一步的,针对眼镜佩戴者前方的一个特定角度内的音频做定向增强,对于其他区域的声音采用弱化处理,可以保证对话者的语音能够确保清晰听到。

22.进一步的,所述通过波束形成技术实现人声的算法增强,包括:

23.运用波束形成技术形成指向性,让指向轴方向的声音转为指向标方向,来降低环境中的干扰噪音;

24.透过噪音抑制功能降低残留在指向轴方向的固定噪音。

25.进一步的,所述通过本地算法运算或者云端计算识别对话人的声音还包括:

26.将对话人的语音翻译成其他语言;

27.将佩戴者的语音翻译成对话人的语言或文字。

28.进一步的,所述将语音数据识别为文本信息,还包括语音识别算法。

29.进一步的,所述将数据发送给云端服务器并接收服务器返回的信息还包括:

30.与其他设备相连,由该设备与云端服务器连接进行数据的发送与接收。

31.为了实现上述目的,根据本技术的另一方面,提供了一种ar眼镜,具有用于识别对方语音的语音信息处理系统。

32.根据本技术的ar眼镜,具有用于识别对方语音的语音信息处理系统包括:

33.显示模块包括1片或两片ar显示的镜片单元;

34.传输模块包含wi

‑

fi、蓝牙、移动网络的一种或多种;

35.传感器包括麦克风;

36.电池模块包括电池和电源管理单元;

37.控制模块,包含ar眼镜的计算单元和用户交互控制单元。

38.进一步的,所述显示模块还包括不限于指示灯、除ar显示单元外的显示屏幕的一种或多种。

39.进一步的,所述传感器还包括不限于rgb摄像头、tof摄像头、激光雷达、陀螺仪、重力加速度计、地磁传感器、距离传感器、扬声器的一种或多种。

40.进一步的,所述控制模块:

41.所述ar眼镜的计算单元包括不限于cpu、内存、存储的一种或多种;

42.所述用户交互控制单元包括不限于按键、触屏、震动感应、遥控器的一种或多种。

43.在本技术实施例中,采用麦克风阵列技术、声源定位、声纹识别的方式,通过波束形成技术实现声源定位和降噪功能,通过物理结构实现人声和环境声的定向采集,提高定向音频的敏锐度,实现交流更高效,无需操作手机的技术效果,进而解决了依赖手机,需要手动控制,而且无法识别对象,需要安静的环境或靠近才能降低周围噪音对语音识别造成的影响,需要实时操作,有累赘感的技术问题。

附图说明

44.构成本技术的一部分的附图用来提供对本技术的进一步理解,使得本技术的其它特征、目的和优点变得更明显。本技术的示意性实施例附图及其说明用于解释本技术,并不构成对本技术的不当限定。在附图中:

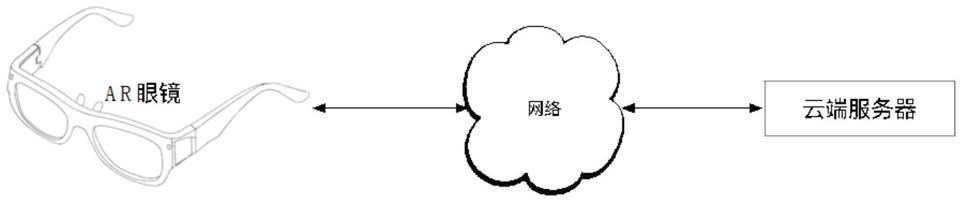

45.图1是根据本技术实施例的ar眼镜直接连接云端服务器示意图;

46.图2是根据本技术实施例的ar眼镜通过手机连接云端服务器示意图;

47.图3是根据本技术实施例的ar眼镜麦克风不同指向的收音效果对比图;

48.图4是根据本技术实施例的ar眼镜的组成部分示意图;

49.图5是根据本技术实施例的双麦克风ar眼镜布局示意图;

50.图6是根据本技术实施例的多麦克风ar眼镜布局示意图;

51.图7是根据本技术实施例的ar眼镜的定向语音增强示意图。

具体实施方式

52.为了使本技术领域的人员更好地理解本技术方案,下面将结合本技术实施例中的附图,对本技术实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本技术一部分的实施例,而不是全部的实施例。基于本技术中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都应当属于本技术保护的范围。

53.需要说明的是,本技术的说明书和权利要求书及上述附图中的术语“第一”、“第二”等是用于区别类似的对象,而不必用于描述特定的顺序或先后次序。应该理解这样使用的数据在适当情况下可以互换,以便这里描述的本技术的实施例。此外,术语“包括”和“具有”以及他们的任何变形,意图在于覆盖不排他的包含,例如,包含了一系列步骤或单元的过程、方法、系统、产品或设备不必限于清楚地列出的那些步骤或单元,而是可包括没有清楚地列出的或对于这些过程、方法、产品或设备固有的其它步骤或单元。

54.在本技术中,术语“上”、“下”、“左”、“右”、“前”、“后”、“顶”、“底”、“内”、“外”、“中”、“竖直”、“水平”、“横向”、“纵向”等指示的方位或位置关系为基于附图所示的方位或位置关系。这些术语主要是为了更好地描述本发明及其实施例,并非用于限定所指示的系统、元件或组成部分必须具有特定方位,或以特定方位进行构造和操作。

55.并且,上述部分术语除了可以用于表示方位或位置关系以外,还可能用于表示其他含义,例如术语“上”在某些情况下也可能用于表示某种依附关系或连接关系。对于本领域普通技术人员而言,可以根据具体情况理解这些术语在本发明中的具体含义。

56.此外,术语“安装”、“设置”、“设有”、“连接”、“相连”、“套接”应做广义理解。例如,可以是固定连接,可拆卸连接,或整体式构造;可以是机械连接,或电连接;可以是直接相连,或者是通过中间媒介间接相连,又或者是两个系统、元件或组成部分之间内部的连通。对于本领域普通技术人员而言,可以根据具体情况理解上述术语在本发明中的具体含义。

57.需要说明的是,在不冲突的情况下,本技术中的实施例及实施例中的特征可以相互组合。下面将参考附图并结合实施例来详细说明本技术。

58.根据本发明实施例,如图1所示,提供了一种用于ar眼镜的语音信息处理方法,该方法包括如下的步骤:

59.通过两个或多个麦克风组成的麦克风阵列收音,如图3所示,具体包括:

60.通过物理结构实现人声和环境声的定向采集,即通过调整麦克风的不同指向,配合外部的收音结构获取到不同方向上的声音,提高定向音频的敏锐度,收音结构包括但不限于特殊设计的圆筒状或圆锥状结构、密封机构在内的一种或几种;

61.通过波束形成技术实现人声的算法增强,即运用波束形成技术形成指向性,让指

向轴方向的声音转为指向标方向,来降低环境中的干扰噪音,透过噪音抑制功能降低残留在指向轴方向的固定噪音。

62.通过本地算法运算或者云端计算识别对话人的声音,将对话人的语音翻译成其他语言,将佩戴者的语音翻译成对话人的语言或文字。

63.通过语音处理算法、语音识别算法将语音数据识别为文本信息。

64.通过无线网络连接模块将数据发送给云端服务器并接收服务器返回的信息,如图2所示,还包括与其他设备相连,由该设备与云端服务器连接进行数据的发送与接收。

65.将接收到的云端服务器的返回处理信息,包括不限于识别和翻译的结果,展示在ar眼镜片上,并通过包括不限于扬声器、耳机在内的一种或几种,语音输出云端服务器的返回信息。

66.进一步的实施例中,还包括通过集成运算单元执行算法运算并控制整个系统的工作逻辑。

67.从以上的描述中,可以看出,本发明实现了如下技术效果:

68.在本技术实施例中,采用麦克风阵列技术、声源定位、声纹识别的方式,通过波束形成技术实现声源定位和降噪功能,通过物理结构实现人声和环境声的定向采集,提高定向音频的敏锐度,实现交流更高效,无需操作手机的技术效果。

69.需要说明的是,步骤可以在诸如一组计算机可执行指令的计算机系统中执行,并且,在某些情况下,可以以不同于此处的顺序执行所示出或描述的步骤。

70.根据本发明实施例,如图4所示,还提供了一种ar眼镜,具有用于识别对方语音的语音信息处理系统,所述语音信息处理系统包括:

71.显示模块,包括1片或两片ar显示的镜片单元组成,也包括但不限于指示灯、除ar显示单元外的显示屏幕在内的一种或几种。显示模块实现ar视频信号的显示,也实现ar眼镜工作状态的显示,例如电池电量、当前工作模式。

72.传输模块实现无线网络传输,包含wi

‑

fi、蓝牙、移动网络在内的一种或多种。

73.传感器除了包括麦克风之外,还包括但不限于rgb摄像头、tof摄像头、激光雷达、陀螺仪、重力加速度计、地磁传感器、距离传感器、扬声器在内的一种或多种。

74.电池模块包括电池和电源管理单元,实现ar眼镜的电源供应及充放电管理。

75.控制模块,包含ar眼镜的计算单元,包括但不限于cpu、内存、存储在内的一种或多种,和用户交互控制单元。用户交互控制单元包括不限于按键、触屏、震动感应、遥控器在内的一种或多种,实现ar眼镜工作状态的控制,例如开关、修改设置在内的操作。

76.在一种实施例中,如图5所示,ar眼镜只有两个麦克风,麦克风1可以布置在左侧或右侧眼镜腿位置,方向朝向下方或者内侧,用于接收佩戴者的语音信息,麦克风2位于眼镜框上,朝向前方的对话者,用于接收对话者的声音,通过波束形成算法实现降噪功能,并通过声源定位功能识别对话者和佩戴者的声音。

77.在另一种实施例中,如图6所示,ar眼镜有三个或多个麦克风,其中麦克风 1位于眼镜腿上,朝向下方或者佩戴者,用于获取佩戴者的语音信息,麦克风2位于眼镜框上,朝向前方的对话者,用于接收对话者的声音信息,其他的麦克风可以朝向前方,也可以朝向外侧,通过波束形成算法实现降噪功能,并通过声源定位功能识别对话者和佩戴者的声音。

78.在另一种实施例中,如图7所示,ar眼镜的麦克风阵列能够针对眼镜佩戴者前方的

一个特定角度内的音频做定向增强,对于其他区域的声音采用弱化处理,保证对话者的语音能够确保清晰听到定向增强的角度内的音频。

79.经过多次实验调整,使ar眼镜的麦克风阵列对于ar眼镜佩戴者前方45度角内的音频定向加强的效果最佳,同时能够弱化其他区域的声音。

80.显然,本领域的技术人员应该明白,上述的本发明的各模块或各步骤可以用通用的计算系统来实现,它们可以集中在单个的计算系统上,或者分布在多个计算系统所组成的网络上,可选地,它们可以用计算系统可执行的程序代码来实现,从而,可以将它们存储在存储系统中由计算系统来执行,或者将它们分别制作成各个集成电路模块,或者将它们中的多个模块或步骤制作成单个集成电路模块来实现。这样,本发明不限制于任何特定的硬件和软件结合。

81.以上所述仅为本技术的优选实施例而已,并不用于限制本技术,对于本领域的技术人员来说,本技术可以有各种更改和变化。凡在本技术的精神和原则之内,所作的任何修改、等同替换、改进等,均应包含在本技术的保护范围之内。