一种基于cnn的粤剧流派分类和识别方法

技术领域

1.本发明涉及粤剧唱腔分类技术领域,更具体的说是涉及一种基于cnn的粤剧流派分类和识别方法。

背景技术:

2.粤剧作为我国十大地方剧种之一,特色鲜明,同时已于2006年被列入第一批国家级非物质文化遗产名录,将其接入互联网数字音乐资源库将有利于对我国这一宝贵文化遗产进行管理、保护与传承。如单纯依靠人工,不仅缺乏效率,而且成本高昂,事倍功半。因此,通过科学的量化和建模方法自动地对唱腔进行规范,建立粤剧音频数据库,对推动粤剧唱腔流派的研究具有深远意义。

3.目前,在对粤剧唱腔特征分析和分类算法方法方面的研究相对较少。许多研究者尝试用深度学习的方法代替传统方法进行音乐分类,利用模型根据输入的训练样本自动地学习音乐信号更高层次的特征表达。由于戏曲属于音乐形式的一种,所以可以借鉴基于深度学习的音乐处理方法,但是粤剧特有的乐律特性和其片段间存在上下文依赖的特点并未分析研究,所以使用基于深度学习的方法来进行粤剧唱腔分析是很具挑战性的。

技术实现要素:

4.有鉴于此,本发明提供了一种基于cnn的粤剧流派分类和识别方法,采用深度学习方法对粤剧流派进行分类和识别,预测结果更准确。

5.为了实现上述目的,本发明采用如下技术方案:

6.一种基于cnn的粤剧流派分类和识别方法,包括以下步骤:

7.获取音频数据样本集,并对所述音频数据样本集进行预处理,得到梅尔频谱图;

8.构建基于cnn网络的粤剧流派分类模型;

9.利用所述梅尔频谱图对所述粤剧流派分类模型进行训练和测试;

10.利用训练好的粤剧流派分类模型对待预测的粤剧音频文件的流派进行识别和分类,输出预测结果。

11.优选的,在上述一种基于cnn的粤剧流派分类和识别方法中,对所述音频数据样本集进行预处理,得到梅尔频谱图,包括以下步骤:

12.使用python程序将所述音频数据样本集切片为多个等时长的音频文件;

13.对所述音频文件进行分帧操作,并采用50%的重叠率对每相邻两帧信号进行加窗操作;

14.采用快速傅里叶变换对每帧信号做快速傅里叶变换,得到频谱图;

15.采用梅尔滤波器组对所述频谱图进行处理,得到梅尔频谱图。

16.优选的,在上述一种基于cnn的粤剧流派分类和识别方法中,所述粤剧流派分类模型的网络结构包括输入层、卷积层、池化层、全连接层、softmax层和输出层;所述卷积层后面接dropout层。

17.优选的,在上述一种基于cnn的粤剧流派分类和识别方法中,利用混淆矩阵对所述粤剧流派分类模型输出的预测结果进行可视化评判。

18.可选的,在上述一种基于cnn的粤剧流派分类和识别方法中,所述音频数据样本集包括70%的训练集和30%的测试集。

19.经由上述的技术方案可知,与现有技术相比,本发明公开提供了一种基于cnn的粤剧流派分类和识别方法,采用深度学习方法,对粤剧音频文件进行切片、分帧和加窗操作,能够降低cnn网络对音强的敏感性、提高对不同音强音频的适应能力,且能根据所提取特征去学习更深更好的特征,更适用于对粤剧唱腔流派的分类并能提高分类准确度和识别速度。

附图说明

20.为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本发明的实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据提供的附图获得其他的附图。

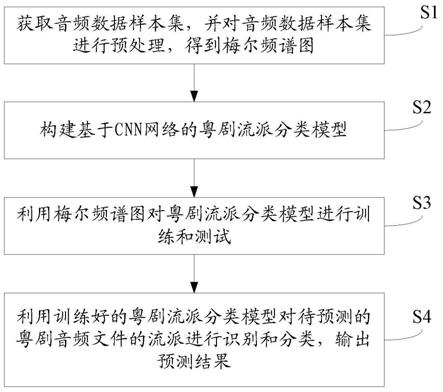

21.图1附图为本发明提供的基于cnn的粤剧流派分类和识别方法的流程图;

22.图2附图为本发明提供的对音频文件的分帧示意图;

23.图3附图为本发明提供的罗家宝粤剧唱段

‑‑

从频率标度到梅尔标度的映射图;

24.图4附图为本发明提供的罗家宝粤剧唱段的频谱图;

25.图5附图为本发明提供的梅尔频谱图的获取过程图;

26.图6附图为本发明提供的罗家宝粤剧唱段的梅尔频谱图;

27.图7附图为本发明提供的粤剧流派分类模型的网络结构图;

28.图8附图为本发明提供的粤剧流派分类模型的训练集误差和测试集误差的变化曲线图;

29.图9附图为本发明提供的粤剧流派分类模型的训练集准确率和测试集准确率的变化曲线图;

30.图10附图为本发明提供的混淆矩阵示意图。

具体实施方式

31.下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

32.如图1所示,本发明实施例公开了一种基于cnn的粤剧流派分类和识别方法,包括以下步骤:

33.s1、获取音频数据样本集,并对音频数据样本集进行预处理,得到梅尔频谱图;

34.s2、构建基于cnn网络的粤剧流派分类模型;

35.s3、利用梅尔频谱图对粤剧流派分类模型进行训练和测试;

36.s4、利用训练好的粤剧流派分类模型对待预测的粤剧音频文件的流派进行识别和

分类,输出预测结果。

37.本发明实施例所采集的音频数据样本集来源于中国戏曲网、戏曲在线等戏曲资源网站以及qq音乐、网易云音乐两大音乐平台。

38.采集音频数据样本集后,对音频数据样本集依次进行切片、分帧和加窗等预处理。具体包括以下步骤:

39.使用python程序将音频数据样本集切片为多个等时长的音频文件。

40.对音频文件进行分帧操作,并采用50%的重叠率对每相邻两帧信号进行加窗操作。由于语音信号是非平稳信号(语音信号由发声器官振动产生的,但发声器官的运动状态不可预测,且受环境影响)。研究表明,在10~30ms内,语音信号的频谱特征可以看做基本不变(因为声道肌肉的振动音频是有极限的)。考虑到粤剧唱段信号内部的连续性,为了避免物理隔断导致一定信息的丢失,一般采用重叠分帧。如图2音频文件分帧示意图所示,展示了一个30秒时长的粤剧唱段音频样本的分帧过程,时长为1.5秒,重叠率为50%(相邻两帧之前会有50%的重叠),丢弃样本最后不足时长的部分。

41.采用快速傅里叶变换对每帧信号做快速傅里叶变换(fft),得到频谱图。其中采样窗口长度为1024,fft变换计算获取整个音频文件的频谱信息,每次计算向前滑动128个样本,这样采样窗口就会互相重叠。

42.采用梅尔滤波器组对频谱图进行处理,得到梅尔频谱图。声音信号本是一维的时域信号,直观上很难看出频率变化规律。采用梅尔频谱图可以更直观、具体地看到相关音频的特征。梅尔频谱就是一个在梅尔刻度下的spectrogram,是通过spectrogram与若干个梅尔滤波器点乘得到的。普通的频率标度与梅尔频率标度的映射关系如下式所示,以罗家宝粤剧唱段为例的hz到mel的映射图如图3所示;

[0043][0044]

音频文件经分帧(长时信号分帧为短时信号)、加窗,通过对每一帧做傅里叶变换(fft)将音频信号从时域映射到频域(音频信号的重叠窗口部分执行),最后把每一帧的结果沿另一个维度堆叠起来,得到频谱图,如图4所示。

[0045]

从频谱图中提取梅尔频谱的过程为:对时域信号进行傅里叶变换转换到频域,然后再利用梅尔频率刻度的滤波器组对应频域信号进行处理,就可以得到梅尔频谱,如图5所示。图6为罗家宝粤剧唱段的梅尔频谱,横坐标表示时间,纵坐标表示频率,颜色深浅代表能量的大小,梅尔声谱的频率刻度呈指数分布。

[0046]

本发明实施例采用的卷积神经网络(convolutional neural networks,cnn)是一类包含卷积计算且具有深度结构的前馈神经网络(feedforward neural networks),是深度学习(deep learning)的代表算法之一。卷积神经网络具有表征学习(representation learning)能力,能够按其阶层结构对输入信息进行平移不变分类(shift

‑

invariant classification),可以进行监督学习和非监督学习,其隐含层内的卷积核参数共享和层间连接的稀疏性使得卷积神经网络能够以较小的计算量对格点化(grid

‑

like topology)特征。

[0047]

根据预测误差调整网络权值,使预测输出不断逼近期望输出。将梅尔频谱特征作

为卷积神经网络的输入,利用深度学习提取深度特征,粤剧唱段的预测结果作为输出。

[0048]

具体的,如图7所示,基于卷积神经网络的粤剧流派分类。使用keras api在tensorflow2.2中实现,网络结构主要为输入层、卷积层、池化层、全连接层、softmax层,激活函数为relu函数,输出层激活函数为softmax函数,损失函数为交叉熵函数。

[0049]

一般的分类模型,dropout层通常加在全连接层防止过拟合、提升模型泛化能力。卷积层参数较少,加入dropout作用甚微,较低层,有噪音,较高层,全连接层可以增加模型的鲁棒性,泛化性能。

[0050]

在设计网络时,设定的每层神经元代表一个学习到的中间特征(即几个权值的组合),网络所有神经元共同作用来表征输入数据的特定属性。考虑到粤剧音频资源较少且杂乱,能收集整理出来的有效数据集偏小,相对于网络的复杂程度(即网络的表达能力、拟合能力)而言,数据量过小时,出现过拟合,自然各神经元表示的特征相互之间存在许多重复和冗余。本发明使用的粤剧流派分类模型的网络结构中,卷积层后面接dropout层,可以较好减轻cnn过拟合。相较于使用提取特征的经典方法结合分类器,性能更好。70%的数据集作为训练集样本输入,建立基于cnn的粤剧流派分类模型,使用混淆矩阵对粤剧流派分类模型进行可视化评判。该模型的训练集误差和测试集误差变化曲线如图8所示,该模型的训练集准确率和测试集准确率变化曲线如图9所示,该模型的混淆矩阵如图10所示,经过150epochs后,训练集准确率为96.5%,测试集准确率为95.7%,测试单个粤剧音频文件用时约为0.24s。

[0051]

因此,本发明基于深度学习的粤剧流派分类模型较传统的分类器,如决策树、随机森林、弹性网、逻辑回归、支持向量机等而言,其识别准确率更高,且处理速度更快。

[0052]

本说明书中各个实施例采用递进的方式描述,每个实施例重点说明的都是与其他实施例的不同之处,各个实施例之间相同相似部分互相参见即可。对于实施例公开的装置而言,由于其与实施例公开的方法相对应,所以描述的比较简单,相关之处参见方法部分说明即可。

[0053]

对所公开的实施例的上述说明,使本领域专业技术人员能够实现或使用本发明。对这些实施例的多种修改对本领域的专业技术人员来说将是显而易见的,本文中所定义的一般原理可以在不脱离本发明的精神或范围的情况下,在其它实施例中实现。因此,本发明将不会被限制于本文所示的这些实施例,而是要符合与本文所公开的原理和新颖特点相一致的最宽的范围。