1.本发明属于铁路货车折角塞门手把不正位识别技术领域,具体涉及一种铁路货车折角塞门手把不正位故障的识别方法。

背景技术:

2.铁路货车折角塞门手把不正位故障是一种严重危及行车安全的故障,在折角塞门手把不正位故障检测中,采用人工检查图像的方式进行故障检测是一种比较常用的方式。但是由于检车人员在工作过程中极易出现疲劳、遗漏等情况,造成漏检、错检的出现,影响行车安全。采用图像自动识别的方式可提高检测效率和稳定性,近几年,深度学习与人工智能不断发展,在技术上不断成熟,虽然现有基于深度学习与人工智能的方法在折角塞门手把不正位故障检测中取得了一定的效果,但是现有方法对折角塞门手把不正位故障检测的准确率仍然较低。因而,对折角塞门手把不正位的故障检测进行进一步研究,以提高故障检测的准确率是十分必要的。

技术实现要素:

3.本发明的目的是为解决现有方法对折角塞门手把不正位故障进行检测的准确率低的问题,而提出一种铁路货车折角塞门手把不正位故障的识别方法。

4.本发明为解决上述技术问题所采取的技术方案是:一种铁路货车折角塞门手把不正位故障的识别方法,该方法包括以下步骤:

5.步骤一、获取铁路货车侧部图像,并从获取的图像中截取出互钩差工位区域图像;

6.步骤二、将步骤一中截取出的互钩差工位区域图像输入yolox目标检测网络,利用yolox目标检测网络来预测互钩差工位区域图像中折角塞门部件包围框的像素坐标信息,再利用预测出的像素坐标信息,从输入的互钩差工位区域图像中裁剪出折角塞门部件区域图像;

7.步骤三、提取步骤二中获得的折角塞门部件区域图像的角点特征,基于提取出的角点特征生成角点定位二值图像;

8.步骤四、将折角塞门部件区域图像与角点定位二值图像进行通道合并,获得通道合并后的图像;

9.再将通道合并后的图像输入关键点检测网络中,得到折角塞门部件的关键点定位信息;

10.步骤五、根据关键点定位信息进行相对位置关系运算,得到手把姿态;根据手把姿态判断是否发生折角塞门手把不正位故障。

11.进一步地,步骤三的具体过程为:

12.步骤三一、分别使用不同尺度的参数构建高斯滤波核,再基于高斯滤波核和裁剪出的折角塞门部件区域图像建立多尺度空间图像;

13.步骤三二、对于每个尺度的空间图像,均利用harris角点检测算法寻找图像的角

点,将各尺度空间图像的角点组成的集合记为初始候选角点集p;

14.步骤三三、对于每个尺度的空间图像,均计算出空间图像在各像素点的归一化log特征值;

15.步骤三四、分别对各尺度的空间图像进行小波变换,得到各尺度空间图像在各像素点的小波变换模的归一化特征值;

16.步骤三五、对于初始候选角点集p中的每个角点p

i

,将p

i

在所对应尺度的空间图像上的log特征值与相邻尺度的空间图像上该位置的log特征值进行对比,判断角点p

i

所对应尺度的空间图像上的log特征值是否为极大值点,若是,则角点p

i

为通过验证的角点,若不是,则将角点p

i

删除,得到新的候选角点集q;

17.步骤三六、对于初始候选角点集p中的每个角点p

j

,将角点p

j

在所对应尺度的空间图像上的小波变换模特征值与相邻尺度的空间图像上该位置的小波变换模特征值进行对比,判断角点p

j

是否为极大值点,若是,则角点p

j

为通过验证的角点,若不是,则将角点p

j

删除,得到新的候选角点集s;

18.将集合q和集合s中的角点融合为新的点集m;

19.步骤三七、将点集m中距离小于曼哈顿距离阈值a的角点进行合并,得到最终角点集合f;

20.基于最终角点集合f中的角点生成角点定位二值图像。

21.进一步地,基于最终角点集合f中的角点生成角点定位二值图像,其具体为:

22.对于获得的折角塞门部件区域图像中的任一像素点,若该像素点与最终角点集合f中至少一个角点的曼哈顿距离小于等于阈值b,则将该像素点的像素值设置为255,否则,将该像素点的像素值设置为0。

23.进一步地,将集合q和集合s中的角点融合为新的点集m之前,分别对集合q和集合s中的角点进行筛选,再将对集合q的筛选结果与对集合s的筛选结果进行融合;其具体过程为:

24.以3

×

3像素域为窗口,使用非极大值抑制算法对新的候选角点集q中的角点进行过滤,将过滤后剩余的角点组成的集合记为集合q’;

25.以3

×

3像素域为窗口,使用非极大值抑制算法对新的候选角点集s中的角点进行过滤,将过滤后剩余的角点组成的集合记为集合s’;

26.再将集合q’和集合s’中的角点融合为新的点集m。

27.进一步地,所述yolox目标检测网络的网络权重参数的获得方式为:

28.步骤s1、采集铁路货车侧部图像,并从采集的图像中截取出互钩差工位区域图像;

29.步骤s2、对步骤s1中截取出的图像进行数据增强,获得数据增强后的图像;

30.步骤s3、对数据增强后图像中的折角塞门部件包围框的像素进行标记,获得标记后的图像,将标记后的图像作为训练数据集;

31.再利用训练数据集对yolox目标检测网络进行训练获得训练好的网络权重参数。

32.进一步地,所述数据增强的方式包括图像缩放、网格畸变、图像角度旋转、图像平移以及图像翻转。

33.进一步地,对数据增强后图像中的折角塞门部件包围框的像素进行标记,标记是采用labelimg软件,并通过人工标记的方式进行的。

34.进一步地,分别使用不同尺度的参数构建高斯滤波核,其具体为:

35.分别使用尺度为0.6、0.72、0.86、1.02和1.2的参数构建3

×

3大小的高斯滤波核。

36.进一步地,将通道合并后的图像输入关键点检测网络中,得到折角塞门部件的关键点定位信息;其具体过程为:

37.关键点检测网络中包括resnet50、bifpn模块和head模块;其中:

38.将通道合并后的图像输入resnet50,选择c2、c3、c4、c5四个特征层的输出作为resnet50的输出;

39.将bifpn模块的任意一个输入层删除后,再将resnet50的输出输入到bifpn模块,,并将最后的信息融合传递过程反转,即利用反卷积与维度拼接的方式实现语义信息自上而下的融合,将特征层p1的输出作为bifpn模块的输出;

40.bifpn模块的输出输入到head模块,head模块输出关键点热力图和关键点量化偏移图;

41.根据关键点热力图和关键点量化偏移图获得关键点的定位信息。

42.进一步地,步骤五的具体过程为:

43.利用关键点定位信息计算各关键点的相对位置关系,再根据各关键点的相对位置关系得到手把姿态,所述手把姿态包括手把倾角以及手把抬升幅度;

44.若手把倾角小于设定阈值m或手把抬升幅度大于设定阈值n,则认为发生折角塞门手把不正位故障;

45.反之,若手把倾角大于等于设定阈值m且手把抬升幅度小于等于设定阈值n,则认为未发生折角塞门手把不正位故障。

46.本发明的有益效果是:本发明提出了一种铁路货车折角塞门手把不正位图像的识别方法,本发明设计了一种融合log特征与小波变换模特征的多尺度harris角点检测方法,克服了传统harris角点检测不具有尺度不变性的缺点,提高了角点检测的准确性,有效降低了角点检测的漏检与误检。并设计了一种新的关键点检测网络,关键点检测网络输入为角点定位二值图像与折角塞门部件区域图像的拼接图像,网络输出为关键点像素定位信息,采用本发明方法可以使获取的关键点像素点位信息更加精准,进而提高故障检测的准确率。

附图说明

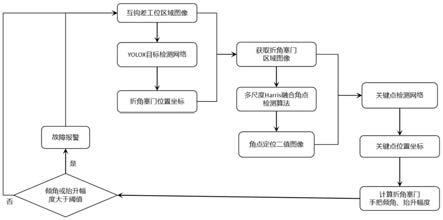

47.图1为本发明一种铁路货车折角塞门手把不正位故障的识别方法的流程图;

48.图2为多尺度harris融合角点检测算法流程图;

49.图3(a)为yolox目标网络检测到的折角塞门部件区域图像;

50.图3(b)为多尺度harris融合角点检测算法检测到的特征角点的示意图;

51.图3(c)为角点定位二值图像;

52.图3(d)为关键点检测网络检测到的三个关键点的示意图;

53.图中,a为手把握把端点,b为塞门体处折弯点,c为手把套扣下端点;

54.图4(a)是原始bifpn模块的示意图;

55.图4(b)是本发明采用的bifpn模块的示意图。

具体实施方式

56.需要特别说明的是,在不冲突的情况下,本技术公开的各个实施方式之间可以相互组合。

57.具体实施方式一、结合图1和图2说明本实施方式。本实施方式的一种铁路货车折角塞门手把不正位故障的识别方法,该方法具体通过以下步骤实现:

58.步骤一、获取铁路货车侧部图像,并从获取的图像中截取出互钩差工位区域图像;

59.步骤二、将步骤一中截取出的互钩差工位区域图像输入yolox目标检测网络,利用yolox目标检测网络来预测互钩差工位区域图像中折角塞门部件包围框的像素坐标信息,再利用预测出的像素坐标信息,从输入的互钩差工位区域图像中裁剪出折角塞门部件区域图像;

60.步骤三、提取步骤二中获得的折角塞门部件区域图像的角点特征,基于提取出的角点特征生成角点定位二值图像;

61.步骤四、将折角塞门部件区域图像与角点定位二值图像进行通道合并,获得通道合并后的图像;

62.再将通道合并后的图像输入关键点检测网络中,得到折角塞门部件的关键点定位信息;

63.步骤五、根据关键点定位信息进行相对位置关系运算,得到手把姿态;根据手把姿态判断是否发生折角塞门手把不正位故障。

64.本实施方式中检测的关键点可以是折角塞门部件的手把握把端点、塞门体处折弯点和手把套扣下端点的定位信息,手把握把端点、塞门体处折弯点和手把套扣下端点的位置分别如图3(d)所示。

65.在本实施方式中,使用高清线阵相机获取货运列车侧方高清图像。采用yolox网络,对图像中的折角塞门部件区域进行精确定位。对于折角塞门部件区域图像,采用多尺度harris角点检测算法提取图像角点特征,生成角点定位二值图像。将折角塞门部件区域图像与角点定位二值图像进行通道合并,将拼接后的图像输入关键点检测网络中,得到折角塞门关键点定位信息。以关键点定位信息为基础,测度折角塞门手把倾角等折角塞门手把姿态信息,判断其是否发生不正位故障。对发生手把不正位的折角塞门部件进行上传报警,工作人员根据识别结果进行相应的处理,保证列车安全运行。

66.具体实施方式二:本实施方式与具体实施方式一不同的是:步骤三的具体过程为:

67.步骤三一、基于高斯尺度空间理论,分别使用不同尺度的参数构建高斯滤波核(具体的尺度可以根据需要人为设定),再基于高斯滤波核和裁剪出的折角塞门部件区域图像建立多尺度空间图像;

68.在进行步骤三一之前,也可以先对裁剪出的折角塞门部件区域图像进行对比度增强,然后,再基于对比度增强后的图像建立多尺度空间图像;

69.步骤三二、对于每个尺度的空间图像,均利用harris角点检测算法寻找图像的角点,将各尺度空间图像的角点组成的集合记为初始候选角点集p;

70.步骤三三、对于每个尺度的空间图像,均计算出空间图像在各像素点的归一化log特征值;

71.步骤三四、分别对各尺度的空间图像进行小波变换,得到各尺度空间图像在各像

素点的小波变换模的归一化特征值;

72.步骤三五、对于初始候选角点集p中的每个角点p

i

,将p

i

在所对应尺度的空间图像上的log特征值与相邻尺度的空间图像上该位置的log特征值进行对比,判断角点p

i

所对应尺度的空间图像上的log特征值是否为极大值点,若是,则角点p

i

为通过验证的角点,若不是,则将角点p

i

删除,得到新的候选角点集q;

73.步骤三六、对于初始候选角点集p中的每个角点p

j

,将角点p

j

在所对应尺度的空间图像上的小波变换模特征值与相邻尺度的空间图像上该位置的小波变换模特征值进行对比,判断角点p

j

是否为极大值点,若是,则角点p

j

为通过验证的角点,若不是,则将角点p

j

删除,得到新的候选角点集s;

74.将集合q和集合s中的角点融合为新的点集m;

75.步骤三七、将点集m中距离小于曼哈顿距离阈值a的角点进行合并,得到最终角点集合f;其中,曼哈顿距离阈值a是根据实际图像大小来人为设定的;

76.基于最终角点集合f中的角点生成角点定位二值图像。

77.具体实施方式三:本实施方式与具体实施方式二不同的是:基于最终角点集合f中的角点生成角点定位二值图像,其具体为:

78.对于获得的折角塞门部件区域图像中的任一像素点,若该像素点与最终角点集合f中至少一个角点的曼哈顿距离小于等于阈值b(阈值b的取值根据实际图像大小人为设定),则将该像素点的像素值设置为255,否则,将该像素点的像素值设置为0。

79.具体实施方式四:本实施方式与具体实施方式二不同的是:所述将集合q和集合s中的角点融合为新的点集m之前,分别对集合q和集合s中的角点进行筛选,再将对集合q的筛选结果与对集合s的筛选结果进行融合;其具体过程为:

80.以3

×

3像素域为窗口,使用非极大值抑制算法对新的候选角点集q中的角点进行过滤,将过滤后剩余的角点组成的集合记为集合q’;

81.以3

×

3像素域为窗口,使用非极大值抑制算法对新的候选角点集s中的角点进行过滤,将过滤后剩余的角点组成的集合记为集合s’;

82.再将集合q’和集合s’中的角点融合为新的点集m。

83.具体实施方式五:本实施方式与具体实施方式一不同的是:所述yolox目标检测网络的网络权重参数的获得方式为:

84.步骤s1、采集铁路货车侧部图像,并从采集的图像中截取出互钩差工位区域图像;

85.步骤s2、对步骤s1中截取出的图像进行数据增强,获得数据增强后的图像;

86.步骤s3、对数据增强后图像中的折角塞门部件包围框的像素进行标记,获得标记后的图像,将标记后的图像作为训练数据集;

87.再利用训练数据集对yolox目标检测网络进行训练获得训练好的网络权重参数。

88.具体实施方式六:本实施方式与具体实施方式五不同的是:数据增强的方式包括图像缩放、网格畸变、图像角度旋转、图像平移以及图像翻转。

89.具体实施方式七:本实施方式与具体实施方式五不同的是:对数据增强后图像中的折角塞门部件包围框的像素进行标记,标记是采用labelimg软件,并通过人工标记的方式进行的。

90.具体实施方式八:本实施方式与具体实施方式二不同的是:分别使用不同尺度的

参数构建高斯滤波核,其具体为:

91.分别使用尺度为0.6、0.72、0.86、1.02和1.2的参数构建3

×

3大小的高斯滤波核。

92.具体实施方式九:结合图4(a)和图4(b)说明本实施方式。本实施方式与具体实施方式一不同的是:将通道合并后的图像输入关键点检测网络中,得到折角塞门部件的关键点定位信息;其具体过程为:

93.关键点检测网络中包括resnet50、bifpn模块和head模块;其中:

94.将通道合并后的图像输入resnet50,选择c2、c3、c4、c5四个特征层的输出作为resnet50的输出;

95.特征层c2是指resnet50网络中下采样倍数为4的层,特征层c3是指resnet50网络中下采样倍数为8的层,特征层c4是指resnet50网络中下采样倍数为16的层,特征层c5是指resnet50网络中下采样倍数为32的层;

96.将bifpn模块的任意一个输入层删除后,再将resnet50的输出输入到bifpn模块,,并将最后的信息融合传递过程反转,即利用反卷积与维度拼接的方式实现语义信息自上而下的融合,将特征层p1的输出作为bifpn模块的输出;

97.特征层p1是指在bifpn模块中,相对于bifpn模块输入图像分辨率下采样倍数为2的层;

98.bifpn模块的输出输入到head模块,head模块输出关键点热力图和关键点量化偏移图;

99.根据关键点热力图和关键点量化偏移图获得关键点的定位信息。

100.具体来说,在本发明中,关键点热力图的大小为96

×

96

×

3,即通道数为3,每一通道特征图上像素点的像素值代表该通道对应类别的置信度分数,置信度分数由0到1的数值表示,设置置信度分数阈值为0.8,可通过对比计算获得对应各类别(即手把握把端点、塞门体处折弯点和手把套扣下端点3个类别)的置信度分数大于0.8且置信度分数最高的点,称得到的点为基准点。

101.而关键点量化偏移图的大小为96

×

96

×

6,即通道数为6,其中每两通道特征图对应1个类别,如通道1特征图上像素点的像素值代表预测的手把握把端点的横向偏移量,通道2特征图上像素点的像素值代表预测的手把握把端点的纵向偏移量。

102.假设存在对应手把握把端点的基准点pa,其在关键点热力图上的像素坐标为(x,y),则在关键点量化偏移图上可得到预测的横向偏移量px和纵向偏移量py,此时可得到手把握把端点的实际定位坐标,即(x+px,y+py)。

103.具体实施方式十:本实施方式与具体实施方式一不同的是:步骤五的具体过程为:

104.利用关键点定位信息计算各关键点的相对位置关系,再根据各关键点的相对位置关系得到手把姿态,所述手把姿态包括手把倾角以及手把抬升幅度;

105.若手把倾角小于设定阈值m或手把抬升幅度大于设定阈值n,则认为发生折角塞门手把不正位故障;

106.反之,若手把倾角大于等于设定阈值m且手把抬升幅度小于等于设定阈值n,则认为未发生折角塞门手把不正位故障。

107.当通道合并后图像的大小为96

×

96且长宽比为1:1时,若塞门体处折弯点和手把握把端点的垂直像素差大于20,或手把握把端点和手把套扣下端点的连线与水平线夹角小

于25度,都可判定为故障,即手把抬升幅度大于20或手把倾角小于25度时,认为是故障情况。但是阈值m和阈值n的取值与图像缩放的大小和比例有关,当图像缩放的大小和比例变化时,上述两个判断阈值需要适应性调整。

108.实施例

109.下面结合附图进一步说明本发明方法,本发明方法的具体实现方案如下:

110.1、获取原始过车图像

111.分别在货车轨道沿途两侧搭建高速线阵成像设备,货车通过设备后,可获取货车完整高清图像,进而通过图像截取的方式获取不同车厢连接处互钩差工位区域图像,所有图像均为清晰的灰度图像。

112.2、yolox目标检测网络的训练与应用

113.第1)步:以上述互钩差工位原始灰度图像为基础,构建折角塞门区域标记数据集,数据集样本主要包含原始灰度图像中折角塞门包围框的像素坐标信息。数据样本采用labelimg软件,通过人工标记的方式获取。

114.第2)步:为了提高yolox目标检测网络的稳定性和泛化性,需要对折角塞门区域标记数据集中的样本数据进行必要的数据增强操作。数据增强的方式包括图像的缩放、网格畸变、小角度旋转、平移与翻转等操作,以上方法都在随机条件下进行,这样可以最大程度的保证样本的多样性和适用性。

115.第3)步:利用折角塞门区域标记数据集对开源的yolox目标检测网络进行训练,得到针对该数据集的网络权重参数文件。

116.第4)步:结合yolox网络模型与权重参数,可对互钩差工位原始灰度图像中折角塞门区域进行检测定位,获取预测的折角塞门包围框的像素坐标信息,并依此将折角塞门区域图像从原始灰度图像中裁剪出来,将裁剪出的折角塞门区域图像分辨率调整为96

×

96大小。

117.3、关键点检测网络的构建

118.关键点检测网络的构建分为以下几部分:

119.(1)主干网络(backbone):使用resnet50作为主干网络,选择下采样倍数分别为4

×

、8

×

、16

×

、32

×

的c2、c3、c4、c5四个特征层作为输出;

120.(2)neck:主体采用了bifpn结构,原始bifpn的输入和输出都为5层特征图,而本网络将原始bifpn最高分辨率输入节点和最低分辨率输出节点删除,并将最后阶段的信息融合传递过程反转,利用反卷积与维度拼接的方式实现语义信息自上而下的融合,最终获得相对于输入图像分辨率下采样倍数为2

×

的输出特征层p1;

121.(3)head:本网络的检测头使用解耦头(decoupled head)的形式,输出两个特征图,分别是关键点热力图(heatmap)和关键点量化偏移图,关键点热力图中每一通道代表一个类别,关键点量化偏移图负责预测关键点热力图中的关键点坐标距离实际关键点的像素坐标的偏移量;

122.(4)损失计算:首先是关于高斯热图中的关键点分类损失,本网络融合了cornernet和centernet的分类损失计算方法,计算方法如公式(1)所示:

[0123][0124]

其中,α和β是超参数,n代表的是图像关键点个数,设定与实际关键点距离小于阈值γ的像素点均为正样本(即y

xyc

=1),其余像素点的y

xyc

值利用以实际关键点为中心的高斯核函数计算。

[0125]

其次是关于关键点量化偏移图中的关键点定位损失,本网络使用了如公式(2)所示的l1 loss损失函数:

[0126][0127]

其中,表示预测的偏移值,p为实际关键点坐标,r为缩放尺度,本网络中r为2,缩放后实际关键点的近似整数坐标。

[0128]

(5)网络优化策略:优化器使用sgd+momentum,在训练过程中采用了warmup训练策略。

[0129]

4、多尺度harris融合角点检测算法

[0130]

针对传统harris角点检测缺乏尺度不变性的问题,设计了融合log特征与小波变换模特征的多尺度harris角点检测方法,以提取折角塞门角点特征。下面对改进的多尺度harris融合角点检测算法进行说明,其检测步骤如下:

[0131]

(1)利用直方图均衡化或伽马变换等方法加强折角塞门区域图像对比度;

[0132]

(2)预设一组尺度(即高斯滤波函数的方差),建立多尺度空间图像;

[0133]

(3)利用harris角点检测算法寻找各尺度空间图像的角点,得到初始候选角点集p;

[0134]

(4)对每个尺度空间的图像,计算图像归一化的log特征;

[0135]

(5)使用三次b样条函数作为平滑函数,其一阶导数作为小波基函数,基于小波基函数对各尺度空间图像进行小波变换,计算不同尺度下归一化的小波变换模的特征值;

[0136]

(6)对于初始候选角点集p中的每个点p

i

,将p

i

所对应尺度图像上的log特征值与相邻尺度上该位置的log特征值进行对比,判断其是否为极大值点,若是,则该点为通过验证的角点,若不是,则删除,得到的新候选角点集为q;

[0137]

(7)对于初始候选角点集p中的每个点p

i

,将p

i

所对应尺度图像上的小波变换模的特征值与相邻尺度上该位置的小波变换模特征值进行对比,判断其是否为极大值点,若是,则该点为通过验证的角点,若不是,则删除,得到的新候选角点集为s;

[0138]

(8)以3

×

3像素域为窗口,使用非极大值抑制算法分别对候选角点集q和s中的角点进行过滤,将q和s两点集过滤后的角点融合为新的点集m;

[0139]

(9)设置两角点最小曼哈顿距离,将点集m中小于最小曼哈顿距离的角点进行合并,得到最终角点集合f。

[0140]

5、关键点检测网络的训练

[0141]

首先是数据集的准备,使用labelme软件对折角塞门区域图像中关键点像素位置进行人工标注,得到折角塞门关键点数据集,并对数据集中样本采用如尺度缩放、小角度旋转、光学畸变、网格失真等数据增强操作以提升模型鲁棒性。

[0142]

其次是对折角塞门区域图像角点特征的提取,采用上述多尺度harris融合角点检测算法对折角塞门关键点数据集中的图像样本进行角点检测,生成与折角塞门区域图像尺度相同的角点定位二值图。注意,该二值图像中,与角点的曼哈顿距离不大于2的像素点的像素值为255,其余像素点像素值置为0。

[0143]

最后是关键点检测网络的训练,采用均值为0,方差为0.01的正态分布模型对网络权重进行随机初始化,将角点定位二值图与其对应的折角塞门区域图像通过concatente操作实现通道维度的合并,将合并后的图像作为关键点检测网络的输入,通过重复迭代,直至得到网络权重的最佳值。

[0144]

6、折角塞门手把不正位故障判别

[0145]

故障检测步骤如下:

[0146]

第1步:将互钩差工位原始灰度图像输入训练完成的yolox目标检测网络,获取折角塞门位置矩形包围框坐标,并裁剪得到折角塞门区域图像,得到的折角塞门部件区域图像如图3(a)所示;

[0147]

第2步:使用多尺度harris融合角点检测算法完成对该折角塞门区域图像的角点检测,角点检测结果如图3(b)所示,基于角点检测结果生成如图3(c)所示的角点定位二值图像,并实现角点定位二值图像与该折角塞门区域图像的通道合并;

[0148]

第3步:使用自主设计的关键点检测网络对第2步中合并图像进行关键点检测,网络将输出手把握把端点、手把套扣下端角点和塞门体处角点关键点位置像素坐标信息,所检测到的三个关键点如图3(d)所示;

[0149]

第4步:利用关键点像素坐标进行相对位置关系运算,可得到如手把倾角、手把抬升幅度等信息,进而可判断折角塞门手把是否发生不正位故障。

[0150]

本发明的上述算例仅为详细地说明本发明的计算模型和计算流程,而并非是对本发明的实施方式的限定。对于所属领域的普通技术人员来说,在上述说明的基础上还可以做出其它不同形式的变化或变动,这里无法对所有的实施方式予以穷举,凡是属于本发明的技术方案所引伸出的显而易见的变化或变动仍处于本发明的保护范围之列。