1.本发明涉及一种多场景交通车驾驶状态分析系统和方法,特别涉及一种考虑听觉信息的多场景交通车驾驶状态分析系统和方法。

背景技术:

2.目前,在汽车智能化背景下,混合交通成为典型交通工况,无人驾驶汽车与人为驾驶车辆之间复杂的交互成为了重要的研究方向。无人驾驶汽车应具备准确识别其他车辆驾驶意图的能力,其行为应尽可能符合人类驾驶习惯。识别交通车驾驶意图,能够使无人车进行更加精准的轨迹预测和决策规划。

3.驾驶风格研究是驾驶意图识别的重要方面,现有交通车驾驶风格研究方法主要基于有限的长期观测的视觉信息和车辆运动信息,应用聚类算法进行辨识。

4.现有的驾驶风格辨识方法存在以下问题:

5.1、没有充分考虑场景因素和驾驶员因素。在混合交通中交互场景复杂多变,不同交互场景中车辆运动状态不同,会影响风格辨识结果。在特定场景下,不同性格驾驶员会产生不同感觉,进而产生不同行为。现有研究没有充分考虑交互行为中人的内在因素,无人车的“智能”与人类智能存在偏差,导致混合交通中无人车行为生硬,难以被充分理解和接受,非正常交互可能导致交通拥堵甚至交通事故;

6.2、提取特征不够充分。在真实的人类驾驶场景中,驾驶员经常通过鸣笛进行信息传递,鸣笛信息表征特定驾驶场景下驾驶员的性格、情绪和状态,是交互过程中传递意图的重要途径。现有驾驶风格辨识方法仅依据车辆运动信息和视觉信息,没有充分考虑听觉信息,导致意图识别过程缺乏全面性和细致性。

7.基于此,在交通车意图识别过程中,应将简单的驾驶风格辨识扩展为更为全面细致的交通车综合状态分析,以能够更准确地识别交通车意图。

8.鉴于以上分析,本发明旨在提供一种考虑听觉信息的多场景交通车驾驶状态分析系统和方法,基于听觉信息,无人车能够充分考虑驾驶人因素,获取准确可靠的交通车状态,依此更准确地识别交通车行驶意图,进行更为合理的轨迹预测和决策规划,使无人车在混合交通中输出更符合人类驾驶习惯的驾驶行为。

技术实现要素:

9.本发明的目的是为了解决现有的驾驶风格辨识方法中存在的诸多问题,而提供的一种考虑听觉信息的多场景交通车驾驶状态分析系统和方法。

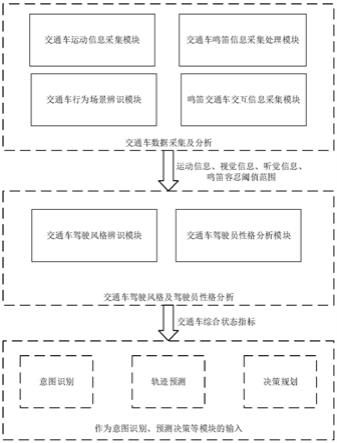

10.本发明提供的考虑听觉信息的多场景交通车驾驶状态分析系统包括有交通车运动信息采集模块、交通车行为场景辨识模块、交通车鸣笛信息采集处理模块、鸣笛交通车交互信息采集模块、交通车驾驶风格辨识模块和交通车驾驶员性格分析模块,交通车运动信息采集模块、交通车行为场景辨识模块、交通车鸣笛信息采集处理模块、鸣笛交通车交互信息采集模块、交通车驾驶风格辨识模块和交通车驾驶员性格分析模块均集成在本无人车

上,其中交通车运动信息采集模块用于采集相邻交通车的运动信息,用于该车驾驶风格辨识;交通车行为场景辨识模块用于获取鸣笛交通车产生鸣笛行为的交互场景;交通车鸣笛信息采集处理模块用于定位鸣笛车辆,采集处理鸣笛声音,记录鸣笛发出者的鸣笛开始时刻、鸣笛持续时间和连续鸣笛次数;鸣笛交通车交互信息采集模块用于采集鸣笛发出者与被鸣笛对象之间的交互信息,并结合交通车行为场景辨识模块、交通车鸣笛信息采集处理模块建立鸣笛容忍阈值范围;交通车驾驶风格辨识模块用于获得相邻交通车驾驶风格分类结果;交通车驾驶员性格分析模块用于提取包含多种信息的特征,训练决策树分类器获得特定场景下驾驶员性格分类结果。

11.本发明提供的考虑听觉信息的多场景交通车驾驶状态分析系统具有以下技术特点:

12.综合多种感觉,结合交通车的运动信息、视觉信息、听觉信息,除辨识其驾驶风格外,充分考虑驾驶员因素,建立鸣笛容忍阈值范围,分析交通车驾驶员性格,综合驾驶风格和驾驶员性格两方面获取交通车综合状态指标,进而提高意图识别、轨迹预测和决策规划的准确性和精度。所述系统和方法打破传统驾驶风格辨识不细致、意图识别不准确的局限性,使混合交通工况下人机交互更为顺畅。

13.本发明提供的考虑听觉信息的多场景交通车驾驶状态分析方法,其方法包括如下步骤:

14.第一步、利用交通车运动信息采集模块中的车载gps、高清摄像头、速度传感器、加速度传感器、角度传感器、毫米波雷达和激光雷达设备采集相邻交通车的视觉信息和运动信息,包括交通车与本无人车之间的横纵向相对距离、横纵向相对速度、横纵向相对加速度、相对转角、相对角速度和相对角加速度,将采集到的数据传至交通车驾驶风格辨识模块;

15.第二步、交通车驾驶风格辨识模块接收交通车运动信息,训练随机森林获取驾驶风格分类结果,规定三类驾驶风格类别标签:激进型、正常型、保守型。采用相对多数投票法对分类结果进行综合,得票最多者作为最终输出结果,若同时有一个以上风格获得最高票,则随机选取其一作为辨识结果,相邻驾驶风格之间存在得票率相近的情况,此时投票结果不可靠,对训练后的模型进行概率校准,绘制分类结果的三维混淆矩阵,多次迭代直至其f

β

分数达到90%;

16.第三步、交通车鸣笛信息采集处理模块中的麦克风阵列检测鸣笛声音,过滤交通环境中嘈杂的背景音,定位鸣笛发出者;应用本模块中的鸣笛声音采集装置采集与本无人车相邻的交通车的鸣笛声音,记录鸣笛发出者的鸣笛开始时刻、鸣笛持续时间和连续鸣笛次数;

17.第四步、利用交通车行为场景辨识模块确定与本无人车相邻交通车的鸣笛交互场景,规定三个交通车鸣笛场景:跟驰场景、换道场景和被切入场景,在鸣笛信息采集处理模块已经定位鸣笛发出者后,通过数个安装高度和角度不同的前置摄像头、后视摄像头、侧视摄像头和环视摄像头录制拍摄其与被鸣笛对象之间的交互行为,将视频和图片传至视觉影像处理系统,处理后运用图像识别算法,提取其交互信息,确定鸣笛交通车与被鸣笛对象间的交互场景;

18.第五步、利用交通车鸣笛信息采集处理模块、交通车行为场景辨识模块、鸣笛交通

车交互信息采集模块和信息处理后台综合建立鸣笛容忍阈值范围,首先获取交通车鸣笛开始时机,鸣笛开始时机是指特定场景下鸣笛开始时刻对应的鸣笛发出者与被鸣笛对象之间的交互信息,自交通车鸣笛信息采集处理模块检测到鸣笛时刻起,鸣笛交通车交互信息采集模块开始工作,该模块中包括与交通车运动信息采集模块不同的另一套运动信息采集设备,采集设备有速度传感器、加速度传感器、角度传感器、毫米波雷达和激光雷达,同时借助交通车行为场景辨识模块中的前置摄像头、后视摄像头、侧视摄像头、环视摄像头,运用多模态信息融合算法,输出鸣笛发出者与被鸣笛对象之间的交互信息,具体包括:若场景辨识结果为跟驰场景,采集鸣笛开始时刻鸣笛发出者与被鸣笛对象之间的相对距离和相对速度;若场景辨识结果为被切入场景,采集鸣笛开始时刻交通车被被鸣笛对象切入的角度,二者横纵向相对距离,横向相对速度;若场景辨识结果为换道场景,采集鸣笛开始时刻鸣笛发出者与被鸣笛对象之间横纵向相对距离,横纵向相对速度,将上述鸣笛开始时机数据传递至信息处理后台进行统计,计算不同场景下鸣笛开始时机的平均值,并取95%置信区间,建立驾驶员鸣笛容忍阈值范围,驾驶员鸣笛容忍阈值是基于不同场景而建立的,且随着数据量的增加,信息处理后台的输出结果不断更新,以保证鸣笛容忍阈值范围的准确性;

19.第六步、利用交通车驾驶员性格分析模块获取性格分类结果,依据驾驶员对可能损失自身驾驶收益行为的容忍度不同,且在交互中攻击性不同,结合人类驾驶员驾驶思维及驾驶习惯,规定驾驶员性格分为三类:暴躁型性格,胆小型性格和沉稳型性格;

20.暴躁型性格的驾驶员对可能损失自身驾驶收益行为的容忍度低,攻击性强,当现实交互条件不满足其速度需求和驾驶乐趣时会产生烦躁愤怒情绪,对交互对象传达不满和催促信息,暴躁型性格驾驶员追求高速体验,耐心较差,对他车在交互中处于利己的竞争者角色;

21.胆小型性格的驾驶员对可能损失自身驾驶收益行为的容忍度低,攻击性弱,对距离和速度的把控谨慎,当现实交互条件不满足其安全需求时会产生紧张不安的情绪,对交互对象传达排斥信息,胆小型性格驾驶员更注重自身安全性;

22.沉稳型性格的驾驶员对可能损失自身驾驶收益行为的容忍度高,攻击性弱,对其他交通对象态度宽容,驾驶心态随和,对高速驾驶追求不高,在交互中处于利他的的合作者角色;

23.本模块获取听觉数据及鸣笛容忍阈值范围,提取三个包含多种信息的特征:是否处于鸣笛容忍阈值范围内、鸣笛持续时间和连续鸣笛次数,其中,是否处于鸣笛容忍阈值范围内这一特征中除包含听觉信息外,还包含鸣笛行为对应的运动信息,依据前述三种性格类别标签和前述三个特征训练决策树分类器,使用信息增益率选择划分属性对驾驶员性格状态进行分类;

24.第七步、将驾驶风格和驾驶员性格进行组合匹配,两类标签匹配后输出交通车综合状态指标,该指标综合了车辆运动状态和驾驶员性格情绪,将交通车综合状态指标作为意图识别、轨迹预测和决策规划模块的输入能够提高其准确率和精度。

25.本发明的有益效果:

26.本发明提供的考虑听觉信息的多场景交通车驾驶状态分析系统和方法打破了传统驾驶风格辨识不细致以及意图识别不准确的局限性。本发明分析鸣笛行为,引入听觉信息,综合多种感觉信息,获取更全面的交通车综合状态,所得交通车综合状态指标可以用于

准确识别交通车真实驾驶意图,能够作为新的高级特征输入无人车预测模块和决策层,规划更为精准且符合人类驾驶习惯的轨迹。

附图说明

27.图1为本发明所述的分析系统架构示意图。

28.图2本发明所述的的鸣笛容忍阈值范围原理示意图。

29.图3本发明所述的交通车驾驶员性格分类原理示意图。

30.图4本发明所述的交通车综合状态指标原理示意图。

具体实施方式

31.请参阅图1至图4所示:

32.本发明提供的考虑听觉信息的多场景交通车驾驶状态分析系统包括有交通车运动信息采集模块、交通车行为场景辨识模块、交通车鸣笛信息采集处理模块、鸣笛交通车交互信息采集模块、交通车驾驶风格辨识模块和交通车驾驶员性格分析模块,交通车运动信息采集模块、交通车行为场景辨识模块、交通车鸣笛信息采集处理模块、鸣笛交通车交互信息采集模块、交通车驾驶风格辨识模块和交通车驾驶员性格分析模块均集成在本无人车上,其中交通车运动信息采集模块用于采集相邻交通车的运动信息,用于该车驾驶风格辨识;交通车行为场景辨识模块用于获取鸣笛交通车产生鸣笛行为的交互场景;交通车鸣笛信息采集处理模块用于定位鸣笛车辆,采集处理鸣笛声音,记录鸣笛发出者的鸣笛开始时刻、鸣笛持续时间和连续鸣笛次数;鸣笛交通车交互信息采集模块用于采集鸣笛发出者与被鸣笛对象之间的交互信息,并结合交通车行为场景辨识模块、交通车鸣笛信息采集处理模块建立鸣笛容忍阈值范围;交通车驾驶风格辨识模块用于获得相邻交通车驾驶风格分类结果;交通车驾驶员性格分析模块用于提取包含多种信息的特征,训练决策树分类器获得特定场景下驾驶员性格分类结果。

33.本发明提供的考虑听觉信息的多场景交通车驾驶状态分析系统具有以下技术特点:

34.综合多种感觉,结合交通车的运动信息、视觉信息、听觉信息,除辨识其驾驶风格外,充分考虑驾驶员因素,建立鸣笛容忍阈值范围,分析交通车驾驶员性格,综合驾驶风格和驾驶员性格两方面获取交通车综合状态指标,进而提高意图识别、轨迹预测和决策规划的准确性和精度。所述系统和方法打破传统驾驶风格辨识不细致、意图识别不准确的局限性,使混合交通工况下人机交互更为顺畅。

35.本发明提供的考虑听觉信息的多场景交通车驾驶状态分析方法,其方法包括如下步骤:

36.第一步、利用交通车运动信息采集模块中的车载gps,高清摄像头,速度传感器,加速度传感器,角度传感器,毫米波雷达,激光雷达设备采集相邻交通车的视觉信息和运动信息,包括交通车与本无人车之间的横纵向相对距离,横纵向相对速度,横纵向相对加速度,相对转角,相对角速度,相对角加速度。将采集到的数据传至交通车驾驶风格辨识模块。

37.第二步、交通车驾驶风格辨识模块接收交通车运动特征,训练随机森林获取驾驶风格分类结果。规定三类驾驶风格类别标签:激进型、正常型、保守型。训练随机森林分类器

的具体过程为:将交通车运动信息采集模块所采集的交通车运动信息(横纵向相对距离,横纵向相对速度,横纵向相对加速度,相对转角,相对角速度,相对角加速度)作为特征输入全集,每次随机选取若干特征作为根节点构造决策树得到分类结果,选择特征个数公式如下:

38.k=log2d

39.式中,k为选择的特征个数,d为特征总数。

40.单棵决策树结构较简单且分类能力较弱,所以重复上述步骤,每次随机选取若干特征,有放回地随机采集样本,获得多棵决策树构成随机森林。采用相对多数投票法对分类结果进行综合,得票最多者作为最终输出结果,若同时有一个以上风格获得最高票,则随机选取一个作为辨识结果。相邻驾驶风格之间可能存在得票率相近的情况,此时投票结果不可靠,故对训练后的模型进行概率校准,绘制分类结果的三维混淆矩阵,多次迭代直至其f

β

分数达到90%。f

β

的计算公式如下:

[0041][0042]

式中,precision为精准率,recall为召回率,β为召回率与精准率之间倍数。

[0043]

第三步、交通车鸣笛信息采集处理模块中的麦克风阵列检测鸣笛声音,过滤交通环境中嘈杂的背景音,定位鸣笛发出者;应用本模块中的鸣笛声音采集装置采集鸣笛声音,记录鸣笛发出者的鸣笛开始时刻、鸣笛持续时间、连续鸣笛次数。由于鸣笛信息是短效信息,只对毗邻车辆具有传递意义,同时考虑到传感器探测范围和车载高清摄像头拍摄范围及安装位置的局限性,故只采集与本无人车相邻的交通车鸣笛信息。

[0044]

第四步、利用交通车行为场景辨识模块确定交互场景,如图2所示。由于鸣笛信息是短效信息,只对毗邻车辆具有传递意义,同时考虑到传感器探测范围和车载高清摄像头拍摄范围及安装位置的局限性,故只识别与本无人车相邻交通车的交互信息。鸣笛信息采集处理模块收集到的听觉信息,只有依托于特定场景,才具备有效性。考虑人类产生鸣笛行为的驾驶场景,确定三个交通车鸣笛场景:跟驰场景、换道场景、被切入场景。在鸣笛信息采集处理模块已经定位鸣笛发出者后,通过数个安装高度和角度不同的前置摄像头、后视摄像头、侧视摄像头、环视摄像头录制和拍摄其与被鸣笛对象之间的交互行为,将图片和视频传至视觉影像处理系统,处理后运用图像识别算法,提取其交互信息,确定鸣笛交通车与被鸣笛对象间的交互行为场景。

[0045]

第五步、利用交通车鸣笛信息采集处理模块、交通车行为场景辨识模块、鸣笛交通车交互信息采集模块、信息处理后台综合建立鸣笛容忍阈值范围。具体过程如下:

[0046]

步骤一、获取交通车鸣笛开始时机,鸣笛开始时机是指特定场景下鸣笛开始时刻对应的鸣笛发出者与被鸣笛对象之间的交互信息。交通车行为场景辨识模块获取场景辨识结果,自交通车鸣笛信息采集处理模块检测到鸣笛时刻起,鸣笛交通车交互信息采集模块开始工作,该模块中包括与交通车运动信息采集模块不同的另一套运动信息采集设备(速度传感器、加速度传感器、角度传感器、毫米波雷达、激光雷达),同时借助交通车行为场景辨识模块中的前置摄像头、后视摄像头、侧视摄像头、环视摄像头,运用多模态信息融合算法,输出鸣笛发出者与被鸣笛对象之间的交互信息,具体包括:若场景辨识结果为跟驰场景,采集鸣笛开始时刻鸣笛发出者与被鸣笛对象之间的相对距离和相对速度;若场景辨识

结果为被切入场景,采集鸣笛开始时刻交通车被被鸣笛对象切入的角度,二者横纵向相对距离,横向相对速度;若场景辨识结果为换道场景,采集鸣笛开始时刻鸣笛发出者与被鸣笛对象之间横纵向相对距离,横纵向相对速度。

[0047]

步骤二、建立驾驶员鸣笛容忍阈值范围。将上述鸣笛开始时机数据传递至信息处理后台进行统计,计算不同场景下鸣笛开始时机的平均值,并取95%置信区间,建立驾驶员鸣笛容忍阈值范围。驾驶员鸣笛容忍阈值是基于不同场景而建立的,且随着数据量的增加,信息处理后台的输出结果不断更新,以保证鸣笛容忍阈值范围的准确性。

[0048]

第六步、利用交通车驾驶员性格分析模块获取性格分类结果,如图3所示。根据运动信息获得的驾驶风格辨识结果表征的是车辆行驶特征,而根据鸣笛信息获得的驾驶员性格分析结果表征的是驾驶员性格、情绪和状态。不同性格的驾驶员虽然车辆运动特征相似,但意图可能有很大差别。在意图识别过程中应考虑驾驶员性格的影响,鸣笛这一信息能够有效表征驾驶人性格、情绪和状态。驾驶员性格分析具体过程如下:

[0049]

步骤一、依据驾驶员对可能损失自身驾驶收益行为的容忍度不同,且在交互中攻击性不同,结合人类驾驶员驾驶思维及驾驶习惯,划分驾驶性格分为三类:暴躁型性格,胆小型性格,沉稳型性格。

[0050]

暴躁型性格的驾驶员对可能损失自身驾驶收益行为的容忍度低,攻击性强,当现实交互条件不满足其速度需求和驾驶乐趣时会产生烦躁愤怒情绪,对交互对象传达不满和催促信息,暴躁型性格驾驶员追求高速体验,耐心较差,对他车在交互中处于利己的竞争者角色;

[0051]

胆小型性格的驾驶员对可能损失自身驾驶收益行为的容忍度低,攻击性弱,对距离和速度的把控谨慎,当现实交互条件不满足其安全需求时会产生紧张不安的情绪,对交互对象传达排斥信息,胆小型性格驾驶员更注重自身安全性;

[0052]

沉稳型性格的驾驶员对可能损失自身驾驶收益行为的容忍度高,攻击性弱,对其他交通对象态度宽容,驾驶心态随和,对高速驾驶追求不高,在交互中处于利他的的合作者角色。

[0053]

步骤二、在现实交互中,对可能损失自身驾驶收益行为的容忍度和攻击性主要通过鸣笛行为表现,鸣笛行为能够反映驾驶员的性格和情绪。本模块接收交通车鸣笛信息采集处理模块、交通车行为场景辨识模块、鸣笛交通车交互信息采集模块输出的鸣笛容忍阈值范围,接收交通车鸣笛信息采集处理模块输出的听觉数据,提取三个包含多种信息的特征:是否处于鸣笛容忍阈值范围内、鸣笛持续时间、连续鸣笛次数。其中,是否处于鸣笛容忍阈值范围内这一特征中除包含听觉信息外,还包含鸣笛行为对应的运动信息。上述基于场景的特征,反映了驾驶员对于损害自车收益行为的容忍程度和驾驶员的攻击性强弱,能够有效表征驾驶员的情绪和性格。依据以上三种性格类别标签和以上三个特征训练决策树分类器,使用信息增益率选择划分属性对驾驶员性格状态进行分类,公式如下:

[0054]

[0055][0056]

式中,d为信息熵,a为属性的固有值。

[0057]

由于鸣笛容忍阈值范围基于不同场景而建立,故驾驶员性格分类过程中已包含特定场景信息。

[0058]

第七步、将驾驶风格和驾驶员性格进行组合匹配,获得交通车综合状态指标,如图4所示。获取交通车驾驶风格辨识模块和交通车驾驶员性格分析模块输出的分类结果,将两类标签匹配后输出交通车综合状态指标,该指标综合了车辆运动状态和驾驶员的性格情绪。无人车在分析交通车综合状态时,只考虑其驾驶风格或只考虑其驾驶员性格是不全面且缺乏准确性的,例如,相同性格驾驶员所处情况不同时,可能输出不同的驾驶风格;相同运动风格的车辆由不同性格及状态的驾驶员控制时,驾驶意图可能有所差别,因此综合驾驶风格和驾驶员性格能够更全面细致地表征交通车所处综合状态。将交通车综合状态指标作为意图识别、轨迹预测、决策规划等模块的输入可以提高其准确性和精度。对于未鸣笛车辆,只输出驾驶风格标签。