一种基于神经网络和mfcc的嘈杂环境下非人声语音过滤方法

技术领域

1.本发明涉及语音信号处理及计算机软件技术领域,具体而言,涉及一种基于神经网络和mfcc(mel frequency cepstrum coefficient)的嘈杂环境下非人声语音过滤方法。

背景技术:

2.近年来,人工智能技术飞速发展且日趋成熟,一方面计算机产业的迅速发展,软、硬件环境的改善为复杂算法的实现提供了良好的环境;另一方面,数字信号处理的理论和算法已有大量积累,如快速傅里叶变换、倒谱计算、线性预测算法、数字滤波器等诸多算法的出现,使得识别系统使用方式逐渐从特定人、孤立词、小词表方式发展到非特定人、连续语音、大词表方式。

3.语音识别和分类技术已广泛应用于各项领域中,但现有的语音识别系统都有一个共同的问题,即在噪音环境下,识别率会大幅下降。在语音分类中由于噪声导致的误吸收最为显著,因此语音分类系统就必须考虑在面对嘈杂环境时的准确率。在将特征输入至神经网络前需确保其维度一致,现有的通用补全策略是对末尾进行补0,但在面对仅在信号末尾处有人声且需进行补齐的极端情况时,这种补全策略不能满足对准确率有高需求的过滤系统。

技术实现要素:

4.本发明旨在提供一种基于神经网络和mfcc的嘈杂环境下非人声语音过滤方法,以解决上述存在的问题。

5.本发明提供的一种基于神经网络和mfcc的嘈杂环境下非人声语音过滤方法,包括如下步骤:

6.步骤s1,训练神经网络:

7.(11)获取不包含人声和包含人声的语音信号;

8.(12)提取该语音信号的mfcc融合特征;所述mfcc融合特征均包括mfcc特征、delta信息、delta

‑

delta信息以及rmse;

9.(13)对该语音信号的mfcc融合特征进行特征处理;所述特征处理包括切分和补齐;

10.(14)利用特征处理后的该语音信号的mfcc融合特征对神经网络进行训练,得到训练好的预测模型;

11.步骤s2,非人声语音过滤:

12.(21)获取待预测语音信号;

13.(22)提取该待预测语音信号的mfcc融合特征;

14.(23)对该待预测语音信号的mfcc融合特征进行特征处理;

15.(24)将特征处理后的该待预测语音信号的mfcc融合特征输入训练好的预测模型,实现对待预测语音信号的非人声语音过滤。

16.进一步的,步骤(12)和步骤(22)中提取mfcc融合特征的方法为:

17.对语音信号进行预校验和添加标记;

18.将进行预校验和添加标记后的语音信号,通过n阶滤波器并剔除第零分量后,得到n

‑

1维的mfcc特征;

19.对n

‑

1维的mfcc特征沿着时间轴做一次savitsky

‑

golay滤波,得到delta信息;

20.对n维的mfcc特征沿着时间轴做两次savitsky

‑

golay滤波,得到delta

‑

delta信息;

21.根据原始的语音信号的梅尔频谱计算rmse;

22.将所述mfcc特征、delta信息、delta

‑

delta信息以及rmse拼接为3n+1维的mfcc融合特征。

23.进一步的,所述对语音信号进行预校验和添加标记的方法为:遍历所有语音信号,若存在语音信号不一致的声道则拼接不一致的声道形成新的语音信号序列参与后续计算,并给予不一致标记;否则仅将语音信号中的一个声道参与后续计算,并给予一致标记。

24.进一步的,步骤(13)和步骤(23)中对mfcc融合特征进行特征处理的方法为:按预设窗口大小m将3n+1维的mfcc融合特征进行切分,得到k个切片;并对k个切片进行自动补齐,获得k个n

‑

1*m维的特征矩阵。

25.进一步的,所述对k个切片进行自动补齐的方法为:

26.若k>1,则通过向前平移进行补齐;

27.若k=1,则通过迭代自身进行补齐。

28.进一步的,步骤(24)的方法为:将k个n

‑

1*m维的特征矩阵输入训练好的预测模型,最终输出一个代表每一个切片是否需要过滤的k维矩阵,若某个切片的k维矩阵中各值均不大于阈值s,则将该切片标记为过滤。

29.作为优选,s=0.5。

30.进一步的,所述神经网络包括:

31.卷积核分别为3*3、2*2的最大池化层;

32.以leakyrelu为激活函数的cnn;

33.一层隐藏单元为128的bilstm层;

34.以及两层隐藏单元分别为256和1的全连接层。

35.综上所述,由于采用了上述技术方案,本发明的有益效果是:

36.本发明将基于mfcc的多维特征进行融合、补全,以及神经网络对每个语音切片的概率评分,解决了现有技术中嘈杂环境下识别准确率低、信号末尾人声无法检测的问题,能够在嘈杂环境下对非人声语音进行快速过滤。具体地:

37.1、本发明在计算mfcc特征时分析各分量对噪声的敏感程度,通过对mfcc特征去除对噪声敏感的第零分量,能够有效提升特征在嘈杂环境下的鲁棒性。结合delta、delta

‑

delta、rmse特征,将多个特征融合作为预测模型的输入特征,能够显著提升嘈杂环境下对非人声语音信号的识别准确率。

38.2、本发明引入了自动补齐的机制,可以有效提升仅在信号末尾处有人声且需进行补齐的极端情况的识别准确率。

39.3、本发明中实现了基于cnn和bilstm的语音信号二分类神经网络模型,结合自动

补齐的机制将会更加充分的挖掘语音信号的上下文关系,最终得出更加准确地识别结果。

附图说明

40.为了更清楚地说明本发明实施例的技术方案,下面将对实施例中的附图作简单地介绍,应当理解,以下附图仅示出了本发明的某些实施例,因此不应被看作是对范围的限定,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他相关的附图。

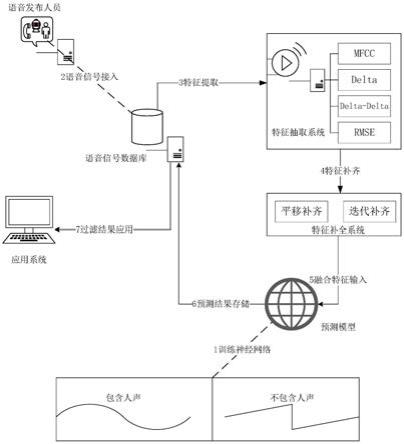

41.图1为本发明实施例的基于神经网络和mfcc的嘈杂环境下非人声语音过滤方法的运行环境业务关系图。

42.图2为本发明实施例的基于神经网络和mfcc的嘈杂环境下非人声语音过滤方法的流程图。

43.图3a为本发明实施例的基于神经网络和mfcc的嘈杂环境下非人声语音过滤方法的自动补齐机制中向前平移补齐与传统补零补齐的对比示意图。

44.图3b为本发明实施例的基于神经网络和mfcc的嘈杂环境下非人声语音过滤方法的自动补齐机制中自身迭代补齐与传统补零补齐的对比示意图。

具体实施方式

45.为使本发明实施例的目的、技术方案和优点更加清楚,下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例是本发明一部分实施例,而不是全部的实施例。通常在此处附图中描述和示出的本发明实施例的组件可以以各种不同的配置来布置和设计。

46.因此,以下对在附图中提供的本发明的实施例的详细描述并非旨在限制要求保护的本发明的范围,而是仅仅表示本发明的选定实施例。基于本发明中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

47.实施例

48.如图1、图2所示,本实施例提出一种基于神经网络和mfcc的嘈杂环境下非人声语音过滤方法,所述嘈杂环境下非人声语音过滤方法包括如下步骤:

49.步骤s1,训练神经网络:

50.(11)获取不包含人声和包含人声的语音信号;

51.(12)提取该语音信号的mfcc融合特征;所述mfcc融合特征均包括mfcc特征、delta信息(mfcc特征的一阶差分)、delta

‑

delta信息(mfcc特征的二阶差分)以及rmse;

52.其中,提取mfcc融合特征的方法为:

53.对语音信号进行预校验和添加标记:遍历所有语音信号,若存在语音信号不一致的声道则拼接不一致的声道形成新的语音信号序列参与后续计算,并给予不一致标记;否则仅将语音信号中的一个声道参与后续计算,并给予一致标记,以此来避免在后续mfcc特征提取时的大量冗余计算。

54.将进行预校验和添加标记后的语音信号,通过n阶滤波器并剔除第零分量后,得到n

‑

1维的mfcc特征。如选择n=21阶的滤波器,由此得到的是除第零分量以外的20维mfcc特

征。

55.对n

‑

1维的mfcc特征沿着时间轴做一次savitsky

‑

golay滤波,得到delta信息;

56.对n维的mfcc特征沿着时间轴做两次savitsky

‑

golay滤波,得到delta

‑

delta信息;

57.根据原始的语音信号的梅尔频谱计算rmse(均方根误差);

58.将所述mfcc特征、delta信息、delta

‑

delta信息以及rmse拼接为3n+1维的mfcc融合特征。

59.(13)对该语音信号的mfcc融合特征进行特征处理;所述特征处理包括切分和补齐;具体地:按预设窗口大小m(即步长,本实施例取m=200)将3n+1维的mfcc融合特征进行切分,得到k个切片;并对k个切片进行自动补齐,获得k个n

‑

1*m维的特征矩阵。所述对k个切片进行自动补齐的方法为:

60.若k>1,则通过向前平移进行补齐;

61.若k=1,则通过迭代自身进行补齐。

62.需要说明的是,通用的采取补零来维持输入特征维度的方法会影响识别效果,补零越多对最终识别结果影响越大。本发明的自动补齐的方法中,向前平移进行补齐带来了更多的上下文关系,如图3a所示,无法向前平移进行补齐则采取了迭代自身进行补齐的方法,如图3b所示,这种方法相当于增加了原始语音信号中短暂人声的权重。因此,该自动补齐的方法可以有效提升仅在信号末尾处有人声且需进行补齐的极端情况的识别准确率。

63.(14)利用特征处理后的该语音信号的mfcc融合特征对神经网络进行训练,得到训练好的预测模型;本实施例中的所述神经网络包括:

64.卷积核分别为3*3、2*2的最大池化层;

65.以leakyrelu为激活函数的cnn,用于学习mfcc融合特征的局部特征;

66.一层隐藏单元为128的bilstm层,用于学习mfcc融合特征中的长短期依赖关系;

67.以及两层隐藏单元分别为256和1的全连接层。

68.步骤s2,非人声语音过滤:

69.(21)获取待预测语音信号;

70.(22)提取该待预测语音信号的mfcc融合特征;该步骤提取mfcc融合特征的方法与步骤(12)一致,在此不再赘述。

71.(23)对该待预测语音信号的mfcc融合特征进行特征处理;该步骤进行特征处理的方法与步骤(23)一致,在此不再赘述。

72.(24)将特征处理后的该待预测语音信号的mfcc融合特征输入训练好的预测模型,实现对待预测语音信号的非人声语音过滤。具体地:将k个n

‑

1*m维的特征矩阵输入训练好的预测模型,最终输出一个代表每一个切片是否需要过滤的k维矩阵,若某个切片的k维矩阵中各值均不大于阈值s(优选取s=0.5),则将该切片标记为过滤。

73.至此,本发明将基于mfcc的多维特征进行融合、补全,以及神经网络对每个语音切片的概率评分,解决了现有技术中嘈杂环境下识别准确率低、信号末尾人声无法检测的问题,能够在嘈杂环境下对非人声语音进行快速过滤。

74.以上所述仅为本发明的优选实施例而已,并不用于限制本发明,对于本领域的技术人员来说,本发明可以有各种更改和变化。凡在本发明的精神和原则之内,所作的任何修

改、等同替换、改进等,均应包含在本发明的保护范围之内。