在语音识别结果中实时地提供提示

背景技术:

1.语音识别(speech recognition)技术旨在将语音信号转变成文本信息。例如,通过执行语音识别,可以从语音波形中提取声学特征,并且该声学特征可以进而被映射为与语音波形对应的文本。语音识别技术已被广泛地应用于多种场景。

技术实现要素:

2.提供本发明内容以便介绍一组概念,这组概念将在以下的具体实施方式中做进一步描述。本发明内容并非旨在标识所保护主题的关键特征或必要特征,也不旨在用于限制所保护主题的范围。

3.本公开的实施例提出了用于在语音识别结果中实时地提供提示的方法和装置。可以获得在针对目标事件的音频流中的当前语音输入。可以识别与所述当前语音输入对应的当前话语文本。可以至少基于所述当前话语文本来生成提示,所述提示包括至少一个预测的后续话语文本序列。可以提供针对所述当前语音输入的语音识别结果,所述语音识别结果包括所述当前话语文本和所述提示。

4.应当注意,以上一个或多个方面包括以下详细描述以及权利要求中具体指出的特征。下面的说明书及附图详细提出了所述一个或多个方面的某些说明性特征。这些特征仅仅指示可以实施各个方面的原理的多种方式,并且本公开旨在包括所有这些方面和其等同变换。

附图说明

5.以下将结合附图描述所公开的多个方面,这些附图被提供用以说明而非限制所公开的多个方面。

6.图1示出了根据实施例的语音识别服务部署的示例性架构。

7.图2示出了根据实施例的语音识别服务部署的示例性架构。

8.图3示出了根据实施例的在语音识别结果中实时地提供提示的示例性场景。

9.图4示出了根据实施例的在语音识别结果中实时地提供提示的示例性场景。

10.图5示出了根据实施例的建立提示生成器的示例性过程。

11.图6示出了根据实施例的在语音识别结果中实时地提供提示的示例性过程。

12.图7示出了根据实施例的在语音识别结果中实时地提供提示的示例性过程。

13.图8至图11示出了根据实施例的在语音识别结果中实时地提供提示的示例。

14.图12示出了根据实施例的用于在语音识别结果中实时地提供提示的示例性方法的流程。

15.图13示出了根据实施例的用于在语音识别结果中实时地提供提示的示例性装置。

16.图14示出了根据实施例的用于在语音识别结果中实时地提供提示的示例性装置。

具体实施方式

17.现在将参考多种示例性实施方式来讨论本公开。应当理解,这些实施方式的讨论仅仅用于使得本领域技术人员能够更好地理解并从而实施本公开的实施例,而并非教导对本公开的范围的任何限制。

18.现有的语音识别技术可以在语音识别结果中提供与输入的语音波形对应的文本。在执行实时语音识别的情形下,音频流中的语音可以被实时地转换为文本。一些软件应用可以支持对实时语音识别功能的调用,例如,远程会议系统、社交网络应用、幻灯片应用等。当一个用户使用这些软件应用并且以音频流形式来提供语音输入或以语音讲述话语时,实时语音识别功能可以将音频流中的语音实时地转换为作为语音识别结果的话语文本序列,该话语文本序列可以被呈现给该用户或其他用户,以便以文本形式来指示讲话者所讲述的内容。实时语音识别功能所提供的语音识别结果可以包括从当前语音输入中识别的话语文本以及可能的从先前语音输入中识别的话语文本。

19.本公开的实施例提出了在语音识别结果中实时地提供提示,该提示包括对可能的后续话语的内容的预测。从而,语音识别结果不仅能够呈现从当前语音输入中识别的当前话语文本,而且还可以呈现所预测的后续话语文本。以一个用户使用幻灯片应用来演讲为例,不仅可以通过语音识别来在该幻灯片应用中呈现与该用户当前讲述的语音话语对应的话语文本,而且还可以以提示的方式来实时地呈现该用户可能接下来讲述的话语的文本。对于作为讲话者的用户而言,该提示可以有助于提醒讲话者接下来应讲述什么内容、避免遗漏内容、避免错误地讲述内容等,从而使得整个讲述过程更为准确流畅。对于听众而言,该提示可以有助于其预先了解接下来将听到什么内容,从而可以更好地理解讲话者的意图。此外,该提示还可以包括利用所预测的后续话语文本来对讲话者实际讲述的话语中的遗漏或错误的修正,从而进一步便于听众的理解。应当理解,在本文中,话语可以包括一个或多个词语。

20.在一个方面,可以随着对音频流中的当前语音输入的识别而实时地提供对应的提示。例如,每当讲话者讲述一个或多个词语时,就提供响应于该当前词语的提示。在本文中,词语可以广泛地指在不用语言中的语言单位,例如,汉语中的字符、英语中的词语等。此外,在本文中,取决于语音识别的具体实现,一个词语可以广泛地包括一个或多个字符、一个或多个词语、一个或多个短语等。

21.在一个方面,提示可以包括一个或多个预测的后续话语文本序列,每个预测的后续话语文本序列可以包括一个或多个预测的后续话语文本,并且每个预测的后续话语文本可以包括一个或多个词语。每个序列中所包括的预测的后续话语文本的不同数量可以提供不同的预测跨度。

22.在一个方面,提示生成过程可以是基于针对当前语音输入所识别的当前话语文本的。例如,可以至少基于当前话语文本来预测后续话语文本序列。此外,提示生成过程可以进一步考虑一个或多个所识别的先前话语文本。例如,可以至少基于当前话语文本和至少一个先前话语文本来预测后续话语文本序列。

23.在一个方面,提示生成过程可以考虑各种有助于提高提示准确性的因素。例如,提示生成过程可以考虑目标事件的事件标识(id)。目标事件可以指音频流或语音输入所针对的事件。以多个参与者通过远程会议系统来进行关于改进生产力工具效率的讨论为例,目

标事件可以是<关于改进生产力工具效率的讨论>,并且来自这些参与者的音频流中的语音话语可以被认为是针对该目标事件的。通过在提示生成过程中使用目标事件的事件id,可以使得该提示以更适应于该目标事件的方式来生成。在本文中,事件id是用于在不同事件之间进行区分的标识,其可以采用例如字符串、数值、向量等各种方式。此外,例如,提示生成过程可以考虑当前语音输入的讲话者的讲话者id。通过在提示生成过程中使用讲话者的讲话者id,可以使得该提示以更适应于该讲话者的方式来生成。在本文中,讲话者id是用于在不同讲话者之间进行区分的标识,其可以采用例如字符串、数值、向量等各种方式。应当理解,除了考虑事件id和讲话者id之外,提示生成过程还可以考虑有助于提高提示准确性的任何其它因素。

24.在一个方面,可以预先建立提示生成器以用于执行提示生成。在一种情形下,可以将与目标事件相关联的文档用于建立提示生成器,以实现针对目标事件的提示生成器定制化。可选地,可以进一步将与目标事件相关联的事件信息用于建立提示生成器。在一种情形下,可以将与多个事件分别关联的多个文档用于建立提示生成器,以使得该提示生成器具有更高的通用性。可选地,可以进一步将与所述多个事件中的每个事件相关联的事件信息用于建立提示生成器。在一种情形下,可以将与多个讲话者分别关联的多个文档用于建立提示生成器,以实现针对特定讲话者的提示生成器定制化。可选地,可以进一步将与每个讲话者相关联的讲话者id用于建立提示生成器。此外,以上所有情形也可以组合用于建立既具有通用性也具有定制性的提示生成器。提示生成器可以是基于各种文本预测技术来建立的,例如,神经网络模型、相关性矩阵等。在应用阶段,所建立的提示生成器可以至少基于当前话语文本和可选的先前话语文本来预测后续话语文本序列。

25.在一个方面,可以在语音识别结果中以不同呈现方式来提供当前话语文本和提示,以便于在视觉上区分当前话语文本和提示。在本文中,呈现方式可以指例如字体、字号、颜色、粗体、斜体、下划线、布局位置、等等。

26.通过根据本公开的实施例在语音识别结果中实时地提供提示,可以实现改进的语音识别服务,使得语音识别结果包含更丰富的信息,由此提高相关软件应用的使用效率和产品效果、改进讲话者和听众两者的用户体验等。

27.图1示出了根据实施例的语音识别服务部署的示例性架构100。在架构100中,根据本公开实施例所生成的包含提示的语音识别结果被直接提供给终端用户所操作的目标应用,从而终端用户可以获得改进的语音识别服务。

28.假设用户102是目标应用110的终端用户。该目标应用110可以是支持对语音识别功能的调用的各种软件应用,例如,远程会议系统、社交网络应用、幻灯片应用等。目标应用110可以包括语音识别应用程序接口(api)112,该语音识别api 112可以调用语音识别服务120以便获得语音识别功能。例如,在用户102使用目标应用110期间,如果用户102想要启用语音识别功能,则其可以通过例如用户界面(ui)中的控制按钮来触发语音识别api 112。此外,可选地,语音识别api 112也可以是默认开启的或由目标应用110的提供方预设为开启的。

29.语音识别服务120可以一般性地指能够实现语音识别功能的各种功能实体,例如,独立于目标应用110的语音识别平台或服务器、包含于目标应用110中的语音识别模块等。因此,尽管为了便于解释而在图1中以不同的方框示出语音识别服务120和目标应用110,但

是应当理解,语音识别服务120既可以独立于目标应用110,也可以被包含在目标应用110中。此外,语音识别服务120是能够在语音识别结果中实时地提供提示的改进的语音识别服务。

30.当用户102以音频流的形式提供一系列语音输入时,例如,当用户102以语音讲述话语时,语音识别api 112可以将该音频流中的当前语音输入104提供给语音识别服务120中的语音识别器122。语音识别器122可以采用任何已知的语音识别技术来将当前语音输入104转换为对应的当前话语文本。

31.语音识别服务120中的提示生成器124可以根据本公开的实施例,至少基于语音识别器122所输出的当前话语文本来生成提示。该提示可以包括至少一个预测的后续话语文本序列。

32.语音识别服务120中的组合模块126可以对语音识别器122所输出的当前话语文本和提示生成器124所输出的提示进行组合,以形成与当前语音输入104对应的语音识别结果106。可选地,组合模块126可以采用不同的呈现方式来对当前对话语文本和提示进行组合。

33.包含提示的语音识别结果106可以被返回到语音识别api 112。从而,目标应用110可以在ui中将该语音识别结果106呈现给用户102以及可以看到该ui的其他人。应当理解,在目标应用110是允许不同用户在各自的终端设备上同时运行的多方应用的情况下,例如,在目标应用110是允许多个参与者在各自终端设备上分别运行客户端的远程会议系统的情况下,语音识别结果106可以被同时提供给运行了目标应用110的不同终端设备,以使得不同用户都可以查看到该语音识别结果。

34.图2示出了根据实施例的语音识别服务部署的示例性架构200。架构200是在图1的架构100基础上的修改,并且图1和图2中的相同参考标号可以指示相同的单元或功能。在架构200中,根据本公开实施例所生成的包含提示的语音识别结果首先被提供给应用提供方平台,在由应用提供方平台处理后,经处理的语音识别结果被提供给终端用户所操作的目标应用。

35.如图2所示,语音识别服务120可以将包含提示的语音识别结果106提供给应用提供方平台210。应用提供方平台210可以指能够为目标应用110提供例如运行控制、业务管理、数据处理、开发等的网络实体。假设目标应用110为远程会议系统,则应用提供方平台210可以是例如该远程会议系统的服务器。应用提供方平台210可以基于预先定义的提示呈现策略212,对语音识别结果106进行处理以产生经处理的语音识别结果220。提示呈现策略212可以控制将语音识别结果106中的提示中的哪些内容呈现给用户102,以及在经处理的语音识别结果220中以什么样的方式来提供提示。例如,语音识别结果106中的提示可能包括多个预测的后续话语文本序列,则提示呈现策略212可以确定仅将排名最高的一个预测的后续话语文本序列包括在经处理的语音识别结果220中。例如,提示呈现策略212可以定义在经处理的语音识别结果220中对当前话语文本和提示的期望呈现方式。

36.经处理的语音识别结果220可以被返回到语音识别api 112。从而,目标应用110可以在ui中呈现该经处理的语音识别结果220。

37.根据架构200,通过将语音识别服务所输出的语音识别结果提供给应用提供方平台并且在应用提供方平台中形成最终将被呈现的语音识别结果,可以由目标应用的提供方来自主地设置关于在语音识别结果中如何提供提示的策略。由此,应用提供方平台可以通

过预定义的提示呈现策略来获得定制化。从而,实际上,该应用提供方平台是直接获得了改进的语音识别服务的“平台用户”,而用户102则是间接获得了改进的语音识别服务的“终端用户”。

38.应当理解,尽管在架构200中示出提示呈现策略212被包括在应用提供方平台210中,但是可选地,也可以将提示呈现策略212部署在目标应用110中。从而,目标应用110可以接收语音识别结果106,并且在根据提示呈现策略212对语音识别结果106进行处理后,在ui中呈现该经处理的语音识别结果。此外,应当理解,尽管在架构200中最终在目标应用110的ui中呈现了经处理的语音识别结果,但是语音识别功能也可以是由目标应用110在后台调用的,从而,目标应用平台210可以不向目标应用110返回经处理的语音识别结果。在这种情况下,目标应用平台210可以作为语音识别结果106的目标接收端点,并且可以对语音识别结果106进行进一步的利用。

39.应当理解,图1和图2仅示出了语音识别服务部署的示例性架构,取决于实际的应用场景,本公开的实施例还可以涵盖任何其它部署架构。

40.图3示出了根据实施例的在语音识别结果中实时地提供提示的示例性场景300。假设终端用户302正在使用幻灯片应用,并且该幻灯片应用具有示例性的ui 310。

41.ui 310可以包括展示区域312,在该展示区域312中展示了幻灯片内容。ui 310可以包括语音识别按钮314,其用于调用语音识别功能。ui 310还可以包括语音识别结果区域316,以用于实时地显示对语音话语的语音识别结果。

42.假设用户302在展示幻灯片的同时正在以语音讲述话语,从而产生了对应的音频流304。作为示例,用户302以英语讲述了“the next topic is how we leverage hidden”,其中“hidden”是当前语音输入。通过根据本公开实施例的改进的语音识别服务,语音识别结果区域316可以显示多个先前话语文本“the next topic is how we leverage”、所识别的当前话语文本“hidden”、以及提示“markov model to evolve”。该提示包括一个预测的后续话语文本序列,该序列包括4个预测的后续话语文本“markov”、“model”、“to”和“evolve”。换句话说,尽管用户302刚刚讲出词语“hidden”,但是语音识别结果区域316已经显示了对用户302接下来可能讲述的话语的预测。

43.如图3所示,提示是以与先前话语文本和当前话语文本不同的呈现方式来提供的。例如,提示中的文本“markov model to evolve”是以不同字体、加粗、斜体的方式来呈现的。

44.图4示出了根据实施例的在语音识别结果中实时地提供提示的示例性场景400。假设终端用户clair正在使用远程会议系统,并且该远程会议系统具有示例性的ui 410。

45.ui 410可以包括信息区域412,在该信息区域412中列出了会议的参与者,例如,david、brown、clair等。ui 410可以包括控制区域414,其包括用于实现不同控制功能的多个控制按钮。控制区域414可以包括语音识别按钮416,其用于调用语音识别功能。ui 410还可以包括语音识别结果区域418,以用于实时地显示对不同参与者在会议中的语音话语的语音识别结果。

46.假设用户clair正在以语音讲述话语,从而产生了对应的音频流402。作为示例,用户clair以英语讲述了“it’s a challenge to improve our productivity”,其中“productivity”是当前语音输入。通过根据本公开实施例的改进的语音识别服务,语音识

别结果区域418可以显示用户clair已经讲述过的多个先前话语文本“it’s a challenge to improve our”、所识别的当前话语文本“productivity”、以及提示“tools in processing”。该提示包括一个预测的后续话语文本序列,该序列包括3个预测的后续话语文本“tools”、“in”和“processing”。换句话说,尽管用户clair刚刚讲出词语“productivity”,但是语音识别结果区域418已经显示了对用户clair接下来可能讲述的话语的预测。

47.如图4所示,提示是以与先前话语文本和当前话语文本不同的呈现方式来提供的。例如,提示中的文本“tools in processing”是以不同字体、加下划线方式来呈现的。

48.应当理解,图3和图4中的所有元素及其布局都是示例性的,其仅仅用于直观地展示根据本公开实施例的示例性场景。此外,本公开的实施例并不局限于所示出的用于提供提示的示例性呈现方式,而是可以采用各种其它呈现方式。此外,尽管示出了采用英语语言的语音话语和话语文本,但是本公开的实施例并不局限于任何具体的语言。

49.图5示出了根据实施例的建立提示生成器的示例性过程500。

50.根据本公开的实施例,为了准确地预测后续话语文本并生成提示,可以至少利用与事件和/或讲话者相关联的文档来构建语料库,并进而将该语料库用于建立提示生成器。

51.在一种实现方式中,可以获得与目标事件t相关联的至少一个文档,例如,文档t_1、文档t_2等。目标事件可以指在目标应用中将被实施语音识别的事件,例如,通过远程会议系统举行的涉及某个讨论议题的会议、利用幻灯片应用做出的关于某个话题的演讲、等等。以通过幻灯片应用做出的的涉及话题l的演讲s为例,该演讲s可能具有一个或多个相关联的文档,例如讲话者将要在演讲时展示的幻灯片文件,这些文档包括与话题l相关的讨论内容。这些文档可能提供有助于预测后续话语文本的信息。例如,假设这些文档中的多个语句包括术语“hidden markov model”,其指示“hidden”、“markov”和“model”这三个词语至少在该演讲s中具有较高的相关性,则该信息将有助于在当前话语文本为例如“hidden”的情况下以更高概率来预测出后续话语文本序列“markov model”。可选地,还可以获得与目标事件t相关联的事件信息。事件信息可以包括,例如,目标事件t的事件id、目标事件t的时间信息、目标事件t的议程、目标事件t的参与者的参与者id、与目标事件t所涉及的文档相关联的讲话者的讲话者id、等等。目标事件t的参与者可以指参与了目标事件的人员,其包括在目标事件中讲话的讲话者以及没有讲话的人员。目标事件t的时间信息可以包括例如目标事件t开始的时间点、目标事件t的时间段等。目标事件t的议程可以包括例如按照时间顺序排列的话题、讲话者等。提示生成器的建立可以进一步基于所获得的事件信息。通过在目标事件t发生之前利用与该目标事件t相关联的文档和可选的事件信息来建立提示生成器,可以使得提示生成器在目标事件t发生期间更准确地生成适应于该目标事件的提示,由此实现针对该目标事件t的提示生成器定制化。与目标事件t相关联的文档以及事件信息可以是由目标事件t的参与者、讲话者或者其他人来提供的。可以将所获得的与目标事件t相关联的文档以及事件信息存储到文档语料库510中。

52.在一种实现方式中,可以收集与多个不同事件分别关联的多个文档,以共同用于建立提示生成器。例如,可以获得与事件a相关联的文档a_1和文档a_2、与事件b相关联的文档b_1、等等。此外,可选地,还可以获得与这些事件分别关联的事件信息。通过利用与多个事件相关联的文档和可选的事件信息来建立提示生成器,可以增强提示生成器的通用性。

可以将所获得的与多个事件相关联的文档以及事件信息存储到文档语料库510中。

53.在一种实现方式中,可以收集与多个不同讲话者分别关联的多个文档,以用于建立提示生成器。例如,可以获得与讲话者m相关联的文档m_1和文档m_2、与讲话者n相关联的文档n_1、n_2和n_3、等等。此外,可选地,还可以获得与这些讲话者分别关联的讲话者id。尽管每个讲话者的多个文档可能关联于不同的事件,但是这些文档有助于共同构建特定于该讲话者的语料库,从而可以实现针对该讲话者的提示生成器定制化。与特定讲话者相关联的文档以及讲话者id可以是由该讲话者或者其他人来提供的。可以将所获得的与多个讲话者相关联的文档以及讲话者id存储到文档语料库510中。

54.通过上述过程,文档语料库510将存储有多个文档,每个文档可以具有对应的标记信息,例如事件信息、讲话者id等。在520处,可以对文档语料库510中的文档执行文本分析以获得用于建立提示生成器的数据。例如,可以通过词语分割来从每个文档中提取出词语序列或词语集合,每个词语将具有与该文档相同的标记信息。此外,取决于提示生成器的具体实现,在520处的文本分析还可以包括可能的进一步处理。

55.根据本公开的实施例,提示生成器530可以是基于神经网络模型的,例如,用于文本预测的循环神经网络(rnn)模型。可以利用预先准备的词语序列,将该神经网络模型训练用于基于一个或多个输入词语来预测下一词语。例如,该神经网络模型可以是n元(n-gram)模型,其中n≥1,从而可以基于n个词语来预测下一词语。在一种实现方式中,可以利用通过520处的文本分析而从与多个事件相关联的多个文档中提取的多个词语序列来训练该神经网络模型,以获得通用的提示生成器。在一种实现方式中,可以利用通过520处的文本分析而从与目标事件相关联的文档中提取的词语序列来训练该神经网络模型,以获得针对该目标事件而定制化的提示生成器。在一种实现方式中,可以利用通过520处的文本分析而从与特定讲话者相关联的文档中提取的词语序列来训练该神经网络模型,以获得针对该特定讲话者而定制化的提示生成器。应当理解,以上多种实现方式也可以以任意方式进行组合。例如,在获得了通用的提示生成器之后,可以利用从与目标事件相关联的文档中提取的词语序列来对该通用的提示生成器进行再训练和优化,以获得针对该目标事件而定制化的提示生成器。例如,在获得了通用的提示生成器之后,可以利用从与特定讲话者相关联的文档中提取的词语序列来对该通用的提示生成器进行再训练和优化,以获得针对该特定讲话者而定制化的提示生成器。例如,可以利用从与目标事件相关联的文档中提取的词语序列和从与特定讲话者相关联的文档中提取的词语序列两者来训练神经网络模型,以获得针对目标事件和该特定讲话者两者而定制化的提示生成器。

56.此外,可选地,在训练基于神经网络模型的提示生成器530时,可以进一步考虑词语的标记信息。例如,在神经网络模型基于一个或多个输入词语来预测下一词语时,可以对具有与该输入词语相同的例如事件id、讲话者id等的候选词语给予更高的权重,使得这些候选词语具有更高的概率被预测作为下一词语。这可以进一步提高预测准确性,因为具有相同事件id和/或讲话者id的词语之间通常具有更高的相关性。

57.此外,可选地,在每一个预测步骤中,基于神经网络模型的提示生成器530也可以输出多个排序最高的下一词语候选。

58.此外,基于神经网络模型的提示生成器530可以被迭代地运行,以便响应于输入词语而预测出后续词语序列。例如,基于神经网络模型的提示生成器530在至少基于输入词语

而预测出第一后续词语后,可以进而至少基于第一后续词语来预测第二后续词语,以此类推,最终得到包括多个后续词语的后续词语序列。进一步地,假设基于神经网络模型的提示生成器530在至少基于输入词语而预测出多个排序最高的第一后续词语候选,则可以进而分别针对每个第一后续词语候选来迭代地预测后续词语,从而最终得到多个预测的后续词语序列。在响应于相同的输入词语而输出多个预测的后续词语序列的情况下,可以分别计算每个序列的总置信度,并且基于总置信度来对这些序列进行排序。可选地,可以输出置信度排序最高的至少一个后续词语序列。

59.根据本公开的实施例,提示生成器530可以是基于相关性矩阵的。该相关性矩阵可以包括多个文本项以及在所述多个文本项之间的相关性值,其中,每个文本项可以是一个或多个词语。例如,相关性矩阵可以是n元矩阵,其中n≥1,从而每个文本项可以包括n个词语。如果n>1,则每个文本项包括在文档中的n个连续的词语。在这种情况下,在520处的文本分析可以进一步包括确定所提取的多个词语序列中的文本项之间的相关性值。可以通过任何已知的方式来确定两个文本项之间的相关性值,例如,可以考虑以下因素中至少之一:两个文本项之间的语义相关性、两个文本项是否相邻、两个文本项是否属于同一个文档、两个文本项是否具有相同的事件id和/或讲话者id、等等。在下面的表1中示出了示例性的相关性矩阵。

60.文本项topicleveragehiddenmarkovmodeltoevolvescenario

…

topic

--

1234567 leverage-1

--

123456 hidden-2-1

--

12345 markov-3-2-1

--

1234 model-4-3-2-1

--

123 to-5-4-3-2-1

--

12 evolve-6-5-4-3-2-1

--

1 scenario-7-6-5-4-3-2-1

--ꢀ…ꢀꢀꢀꢀꢀꢀꢀꢀꢀ

61.表1

62.表1中的相关性矩阵是1元矩阵,其示出了在示例性文本项“topic”、“leverage”、“hidden”、“markov”、“model”、“to”、“scenario”等之间的相关性值。表1中的数值指示列中的文本项相对于行中的文本项的相关性值。假设这些文本项是从文档中的一个语句“the next topic is how we leverage hidden markov model to evolve scenario

…”

中提取的。通过在520处的文本分析,可以获得这些文本项之间的相关性值,例如,“leverage”具有相对于“topic”的相关性值“1”、“model”具有相对于“hidden”的相关性值“2”、“markov”具有相对于“model”的相关性值

“-

1”、等等。两个文本项之间的相关性值的绝对值越小,表明这两个文本项的相关性越高。正相关性值指示按照语言顺序的相关性,负相关性值指示按照逆语言顺序的相关性。例如,对于上述示例性语句中的文本项“hidden”、“markov”和“model”,语言顺序为“hidden

→

markov

→

model”,从而“markov”具有相对于“hidden”的正相关性值且“model”具有相对于“markov”的正相关性值,而逆语言顺序为“hidden

←

markov

←

model”,从而“hidden”具有相对于“markov”的负相关性值且“markov”具有相对于“model”的负相关性值。尽管“hidden”相对于“markov”的相关性值

“-

1”与“model”相对于

“

markov”的相关性值“1”的绝对值相等,即,相关性程度相同,但是就语言顺序而言,“model”具有相对于“markov”的更高相关性。应当理解,表1中的所有元素都是示例性的,在实际应用中,相关性矩阵可以包括更多内容或具有不同格式。例如,相关性矩阵中的文本项可以来自不同语句或文档、相关性值可以采用不同表示方法、等等。例如,相关性矩阵中的每个文本项可以包括一个以上的词语。

63.对于输入词语,基于相关性矩阵的提示生成器530可以根据矩阵中的文本项与该输入词语的相关性值来选择或预测下一文本项或词语。例如,假设输入词语为“markov”,则根据表1的相关性矩阵,可以选择具有与文本项“markov”的最高相关性的文本项“model”来作为所预测的下一文本项或词语,其中,文本项“model”具有相对于文本项“markov”的正相关性值“1”,并且与其它文本项相比,该正相关性值的绝对值最小。可选地,对于每一个输入词语,基于相关性矩阵的提示生成器530可以输出多个排序最高的下一文本项或词语候选。例如,假设输入词语为“leverage”,则根据表1的相关性矩阵,可以选择与文本项“leverage”的相关性最高的两个文本项“hidden”和“model”来作为两个所预测的下一文本项或词语候选,其中,具有正相关性值“1”的文本项“hidden”比具有正相关性值“2”的文本项“model”排序更高,从而更可能是实际的下一词语。

64.尽管在520处确定文本项之间的相关性值时考虑到了文本项或词语的标记信息,例如事件id、讲话者id等,但是可选地,也可以在相关性矩阵中对每个文本项附加对应的标记信息。从而,在利用相关性矩阵来基于输入词语预测下一词语时,可以对具有与该输入词语相同的例如事件id、讲话者id等的文本项给予更高的权重,使得这些文本项具有更高的概率被预测作为下一词语。这可以进一步提高预测准确性。

65.此外,基于相关性矩阵的提示生成器530可以被迭代地运行,以便响应于输入词语而预测或选择出后续文本项序列或后续词语序列。例如,基于相关性矩阵的提示生成器530在至少基于输入词语而预测出第一后续文本项后,可以进而至少基于第一后续文本项来预测第二后续文本项,以此类推,最终得到包括多个后续文本项的后续文本项序列。进一步地,假设基于相关性矩阵的提示生成器530在至少基于输入词语而预测出多个排序最高的第一后续文本项候选,则可以进而分别针对每个第一后续文本项候选来迭代地预测后续文本项,从而最终得到多个预测的后续文本项序列。在响应于相同的输入词语而输出多个预测的后续文本项序列的情况下,可以分别计算每个序列的总相关性,并且基于总相关性来对这些序列进行排序。可选地,可以选择相关性排序最高的至少一个文本项序列来输出。

66.应当理解,以上结合过程500所讨论的提示生成器530的建立过程仅仅是示例性的,根据具体的应用需求和设计,可以对过程500进行任意方式的修改。例如,文档语料库510可以包括以下中的一个或多个:与目标事件t相关联的文档;与多个事件相关联的多个文档;以及与某个特定讲话者相关联的文档。例如,可以通过文档语料库510中的不同语料来分别建立不同的提示生成器,并且这些提示生成器可以被共同地用于预测后续话语文本。作为示例,可以预先建立通用的提示生成器和针对目标事件t的定制化提示生成器,并且在目标事件t发生期间进行预测时,可以通过各种方式来选择由这两个提示生成器所产生的预测结果中的最佳预测结果,以作为最终的所预测的后续话语文本。此外,应当理解,通过过程500所建立的提示生成器530可以被应用于至少基于当前话语文本来预测后续话语文本或后续话语文本序列,其中,提供给提示生成器530的输入词语可以为当前话语文

本,而提示生成器530所预测的下一词语/文本项或后续词语/文本项序列可以是后续话语文本或后续话语文本序列。

67.图6示出了根据实施例的在语音识别结果中实时地提供提示的示例性过程600。

68.假设在目标应用中正在发生目标事件602,并且讲话者604正在以语音讲述话语并从而产生针对该目标事件602的音频流。对于该音频流中的当前语音输入610,例如,讲话者604当前正在讲述的词语,可以在620处对该语音输入610执行语音识别,以生成与当前语音输入610对应的当前话语文本630。可以通过例如图1和图2中的语音识别器122来执行620处的语音识别。

69.在640处,可以至少基于当前话语文本630来生成包括至少一个预测的后续话语文本序列的提示660。可以采用通过图5的过程500所预先建立的提示生成器530来执行640处的提示生成。例如,通过提示生成器,可以至少基于当前话语文本630来预测所述至少一个预测的后续话语文本序列。

70.可选地,在一种实现方式中,在640处的提示生成可以进一步基于在当前话语文本630之前识别的至少一个先前话语文本650,例如,针对音频流中的当前语音输入610之前的一个或多个语音输入而识别出的一个或多个词语。假设提示生成器是n元的(n>1),则至少一个先前话语文本650可以包括例如n-1个先前话语文本。

71.可选地,在一种实现方式中,可以获取目标事件602的事件id 606和/或讲话者604的讲话者id 608,并将事件id 606和/或讲话者id 608用于640处的提示生成。事件id 606和/或讲话者id 608可以是与目标事件602相关联的参与者、讲话者或其他人所提供的。可选地,事件id 606和/或讲话者id 608可以是基于预先获得的目标事件602的事件信息来确定的。例如,可以基于当前时间与目标事件602的时间信息的比较,来确定发生了目标事件602并且提取对应的事件id。例如,可以基于目标事件602的议程来确定与当前的讲话者604对应的讲话者id。

72.取决于提示生成器的具体实现,在640处可以通过不同的方式来使用事件id 606和/或讲话者id 608。例如,在一种情况下,可以利用事件id 606和/或讲话者id 608来选择预先建立的与事件id 606和/或讲话者id 608对应的定制化提示生成器,以执行640处的提示生成。例如,在一种情况下,可以利用事件id 606和/或讲话者id 608来影响通用的提示生成器对后续话语文本的预测,使得具有相同事件id 606和/或讲话者id 608的候选词语可以以更高的概率被确定为后续话语文本。例如,在一种情况下,如果采用多个提示生成器来共同地预测后续话语文本,则这些提示生成器中的一个或多个可以基于事件id 606和/或讲话者id 608来预测后续话语文本。

73.应当理解,提示660中的所预测的后续话语文本序列可以包括一个或多个后续话语文本。例如,在至少基于当前话语文本630预测出与该当前话语文本630相邻的第一后续话语文本之后,可以继续至少基于该第一后续话语文本来预测第二后续话语文本,等等。这些预测的后续话语文本可以以序列的形式而被包括在提示660中。

74.在670处,可以对当前话语文本630和提示660进行组合,以形成语音识别结果680。可选地,在语音识别结果680中,当前话语文本630和提示660可以采用不同呈现方式,以便于在视觉上区分当前话语文本630和提示660。

75.应当理解,上述的过程600仅仅是示例性的,根据具体的应用需求和设计,可以对

过程600进行任何方式的变型和修改。例如,随着音频流中不断地出现新的语音输入,可以针对新的语音输入迭代地执行过程600,以便实时地提供包括提示的语音识别结果。此外,过程600还可以包括确定当前话语文本和/或提示的相关信息,并且将该相关信息被包括在语音识别结果中。该相关信息可以指与当前话语文本和/或提示中的所预测的后续话语文本序列相关联的各种信息。例如,假设当前话语文本为“hidden”,而提示中的所预测的后续话语文本序列为“markov model”,则可以确定与“hidden markov model”相关联的文本描述、链接等,以作为相关信息。本公开的实施例可以通过在语音识别结果中包括相关信息来增强语音识别结果的信息丰富度,但是并不局限于确定或获得该相关信息的任何具体方式。此外,应当理解,语音识别结果680还可以包括所识别的一个或多个先前话语文本。

76.图7示出了根据实施例的在语音识别结果中实时地提供提示的示例性过程700。过程700可以被视为是图6中的过程600的示例性延续。

77.假设已经通过过程600生成了与第一语音输入702对应的第一语音识别结果704,其中,第一语音输入702和第一语音识别结果704可以分别对应于图6中的当前语音输入610和语音识别结果680。第一语音识别结果704可以包括第一话语文本706和第一提示708,其分别对应于图6中的当前话语文本630和提示660。

78.假设在获得了第一语音输入702之后,在音频流中进一步获得了后续的第二语音输入710,该第二语音输入710成为当前语音输入。在720处,可以对第二语音输入710执行语音识别,以生成与第二语音输入710对应的第二话语文本730,该第二话语文本730成为当前话语文本。在720处的语音识别可以类似于图6中的在620处的语音识别。

79.在740处,可以至少基于第二话语文本730来生成第二提示760。在一种实现方式中,过程700可以包括在750处对第二话语文本730与第一提示708中的所预测的后续话语文本序列进行比较,并且将该比较的结果用于在740处的提示生成。通过750处的比较,可以识别出讲话者的语音话语是否包括错误或遗漏。

80.以讲话者想要以语音讲述“the next topic is how we leverage hidden markov model to evolve

…”

为例。假设第一语音输入702对应于“hidden”,第一话语文本706被识别为“hidden”,并且第一提示708为“markov model to”。

81.如果讲话者的第二语音输入710对应于“macao”,其是被错误讲述的,并且第二话语文本730被识别为“macao”,则通过将第二话语文本730与第一提示708进行比较可以发现,讲话者可能将“markov”错误地讲成发音类似的“macao”。在这种情况下,可以将该比较结果提供给在740处的提示生成。相应地,在740处,可以至少基于修正后的第二话语文本“markov”来预测后续话语文本序列,或者可选地,基于所识别的第二话语文本“macao”和纠正后的第二话语文本“markov”来分别预测各自的后续话语文本序列。

82.如果讲话者的第二语音输入710对应于“model”,并且第二话语文本730被识别为“model”,则通过将第二话语文本730与第一提示708进行比较可以发现讲话者可能遗漏了在词语“hidden”与词语“model”之间的词语“markov”。在这种情况下,可以将该比较结果提供给在740处的提示生成。相应地,在740处,可以通过将所遗漏的词语“markov”作为第二话语文本730的先前话语文本来预测后续话语文本序列。

83.除了以上针对错误或遗漏情形的处理外,在740处的提示生成过程可以类似于图6中的640处的提示生成过程。应当理解,根据预定的规则,可以以任意方式来在第二提示760

中包括对错误讲述的词语的修正或者对遗漏词语的添加。

84.在770处,可以将第二话语文本730和第二提示760组合为第二语音识别结果780。

85.应当理解,上述的过程700仅仅是示例性的,根据具体的应用需求和设计,可以对过程700进行任何方式的变型和修改。

86.图8示出了根据实施例的在语音识别结果中实时地提供提示的示例800。示例800旨在示出以不同方式提供的语音识别结果。

87.假设来自讲话者的音频流810包括对应于“the next topic is how we leverage hidden”的语音,其中,“hidden”为当前语音输入812。在820处,可以识别出与该当前语音输入812对应的当前话语文本“hidden”。此外,在830处,可以至少基于当前话语文本来生成提示。在830处的提示生成可以类似于图6中的640处的提示生成。可以将当前话语文本与提示组合为语音识别结果。图8示出了以不同方式提供的三个示例性的语音识别结果。

88.在示例性的语音识别结果840a中,提示仅包括一个所预测的后续话语文本序列。如图所示,语音识别结果840a可以包括当前话语文本840a-2“hidden”以及提示840a-4。提示840a-4仅包括一个预测的后续话语文本序列“markov model to evolve”,其中,该预测的后续话语文本序列包括依次预测的多个后续话语文本“markov”、“model”、“to”、“evolve”等。词语“markov”是至少基于当前话语文本“hidden”来预测的,例如,提示生成器可以基于“hidden”来预测出“markov”,或者提示生成器可以基于“leverage”和“hidden”来预测出“markov”,等等。类似地,词语“model”是至少基于词语“markov”来预测的,词语“to”是至少基于词语“model”来预测的,词语“evolve”是至少基于词语“to”来预测的。此外,语音识别结果840a还包括在当前话语文本840a-2之前所识别的多个先前话语文本,例如,“leverage”、“we”、“how”等。当前话语文本840a-2和提示840a-4是以不同呈现方式来提供的。

89.在示例性的语音识别结果840b中,提示包括多个所预测的后续话语文本序列。如图所示,语音识别结果840b可以包括当前话语文本840b-2“hidden”以及提示840b-4。提示840b-4包括三个预测的后续话语文本序列,例如,“markov model to evolve”,“layer neural network to”,“state information to get”等,其中,每个预测的后续话语文本序列包括依次预测的多个后续话语文本。所述多个预测的后续话语文本序列可以是按照总置信度或总相关性来排序的。例如,“markov model to evolve”被排在第一个位置,其表明讲话者接着讲述该预测的后续话语文本序列的可能性最高。此外,语音识别结果840b还包括在当前话语文本840b-2之前所识别的多个先前话语文本。当前话语文本840b-2和提示840b-4是以不同呈现方式来提供的。

90.在示例性的语音识别结果840c中,提示仅包括一个所预测的后续话语文本序列,但是该语音识别结果840c进一步包括当前话语文本和/或该提示的相关信息。如图所示,语音识别结果840c可以包括当前话语文本840c-2“hidden”、提示840c-4以及相关信息840c-6。提示840c-4包括一个预测的后续话语文本序列“markov model to evolve”。相关信息840c-6是对当前话语文本840c-2和提示840c-4中包括的“hidden markov model”的描述。此外,语音识别结果840c还包括在当前话语文本840c-2之前所识别的多个先前话语文本。当前话语文本840c-2、提示840c-4以及相关信息840c-6是以不同呈现方式来提供的。

91.图9示出了根据实施例的在语音识别结果中实时地提供提示的示例900。示例900

旨在示出随着音频流的进行而实时提供提示的示例性过程。

92.假设在来自讲话者的音频流910中当前出现的语音对应于“hidden”,即,该对应于“hidden”的语音是当前语音输入912。在920处,可以识别出与该当前语音输入912对应的当前话语文本“hidden”。此外,在930处,可以至少基于当前话语文本来生成提示,该提示包括一个预测的后续话语文本序列“markov model to evolve”。可以提供与当前语音输入912对应的语音识别结果940。语音识别结果940可以包括当前话语文本942和提示944。

93.假设在来自讲话者的音频流910中,在对应于“hidden”的语音后接着出现对应于“markov”的语音,即,该对应于“markov”的语音成为当前语音输入914。在920处,可以识别出与该当前语音输入914对应的当前话语文本“markov”。此外,在930处,可以至少基于当前话语文本来生成提示,该提示包括一个预测的后续话语文本序列“model to evolve scenario”。可以提供与当前语音输入914对应的语音识别结果950。语音识别结果950可以包括当前话语文本952和提示954。

94.参照示例900,随着音频流的进行,可以在针对后续语音输入的语音识别结果中实时地提供相应的提示。

95.图10示出了根据实施例的在语音识别结果中实时地提供提示的示例1000。示例1000旨在示出在讲话者进行了的错误讲述的情况下以不同方式来提供提示。

96.假设在来自讲话者的音频流1010中当前出现的语音对应于“hidden”,即,该对应于“hidden”的语音是当前语音输入1012。在1020处,可以识别出与该当前语音输入1012对应的当前话语文本“hidden”。此外,在1030处,可以至少基于当前话语文本来生成提示,该提示包括一个预测的后续话语文本序列“markov model to evolve”。可以提供与当前语音输入1012对应的语音识别结果1040。语音识别结果1040可以包括当前话语文本1042和提示1044。

97.假设在来自讲话者的音频流1010中,在对应于“hidden”的语音后接着出现对应于“macao”的语音,即,该对应于“macao”的语音成为当前语音输入1014。实际上,讲话者将本打算讲述的词语“markov”错误地讲成了“macao”。在1020处,可以识别出与该当前语音输入1014对应的当前话语文本“macao”。

98.通过将当前话语文本“macao”与语音识别结果1040中的提示1044所包括的预测的后续话语文本序列“markov model to evolve”进行比较,可以判断出讲话者可能将提示1044中所预测的话语文本“markov”错误地讲述成了词语“macao”。可以根据不同的策略来在对应于当前语音输入1014的语音识别结果中提供提示。

99.根据一种策略,可以继续基于错误讲述的词语“macao”来预测后续话语文本序列以形成提示。例如,在1030处,可以至少基于当前话语文本“macao”来生成提示,该提示包括一个预测的后续话语文本序列“city to travel this year”。可以提供与当前语音输入1014对应的语音识别结果1050a,其包括当前话语文本1050a-2和提示1050a-4。提示1050a-4包括预测的后续话语文本序列“city to travel this year”。

100.根据另一种策略,可以基于通过上述比较而确定为正确的词语“markov”来预测后续话语文本序列以形成提示。相应地,可以采用图7中的740处的提示生成过程。例如,在1030处,可以至少基于词语“markov”来生成提示,该提示包括一个预测的后续话语文本序列“model to evolve”。可以提供与当前语音输入1014对应的语音识别结果1050b,其包括

当前话语文本1050b-2和提示1050b-4。提示1050b-4包括对正确词语的指示“(markov)”以及预测的后续话语文本序列“model to evolve”。

101.根据又一种策略,可以对以上两种策略进行组合。例如,在一方面,基于错误讲述的词语“macao”来预测一个后续话语文本序列以形成第一提示部分,并且在另一方面,基于正确的词语“markov”来预测另一个后续话语文本序列以形成第二提示部分。相应地,可以提供与当前语音输入1014对应的语音识别结果1050c,其包括当前话语文本1050c-2、第一提示部分1050c-4和第二提示部分1050c-6。第一提示部分1050c-4包括预测的后续话语文本序列“city to travel this year”,而第二提示部分1050c-6包括对正确词语的指示“(markov)”以及预测的后续话语文本序列“model to evolve”。

102.图11示出了根据实施例的在语音识别结果中实时地提供提示的示例1100。示例1100旨在示出在讲话者的讲述遗漏了词语的情况下提供提示的方式。

103.假设在来自讲话者的音频流1110中当前出现的语音对应于“hidden”,即,该对应于“hidden”的语音是当前语音输入1112。在1120处,可以识别出与该当前语音输入1112对应的当前话语文本“hidden”。此外,在1130处,可以至少基于当前话语文本来生成提示,该提示包括一个预测的后续话语文本序列“markov model to evolve”。可以提供与当前语音输入1112对应的语音识别结果1140。语音识别结果1140可以包括当前话语文本1142和提示1144。

104.假设在来自讲话者的音频流1110中,在对应于“hidden”的语音后接着出现对应于“model”的语音,即,该对应于“model”的语音成为当前语音输入1114。实际上,讲话者遗漏了在本打算讲述的短语“hidden markov model”中的词语“markov”,即,在讲述了词语“hidden”后直接讲述了词语“model”。在1120处,可以识别出与该当前语音输入1114对应的当前话语文本“model”。

105.通过将当前话语文本“model”与语音识别结果1140中的提示1144所包括的预测的后续话语文本序列“markov model to evolve”进行比较,可以判断出讲话者可能遗漏了提示1044中的所预测的话语文本“markov”。根据一种策略,可以将所遗漏的词语“markov”作为在当前话语文本“model”之前的先前话语文本,以便可以用于预测后续话语文本序列。相应地,可以采用图7中的740处的提示生成过程。例如,在1130处,可以至少基于当前话语文本“model”和作为先前话语文本的所遗漏词语“markov”来预测一个后续话语文本序列“to evolve scenario”。可以提供与当前语音输入1114对应的语音识别结果1150,其包括当前话语文本1152、第一提示部分1154和第二提示部分1156。第一提示部分1154包括对所遗漏词语的指示“(markov)”,而第二提示部分1156包括预测的后续话语文本序列“to evolve scenario”。

106.应当理解,根据具体的应用需求和设计,以上结合图8至图11所描述的示例可以以任意方式进行修改或组合。此外,取决于具体的应用场景,在这些示例中的语音识别结果可以被提供给例如终端用户、平台用户等。

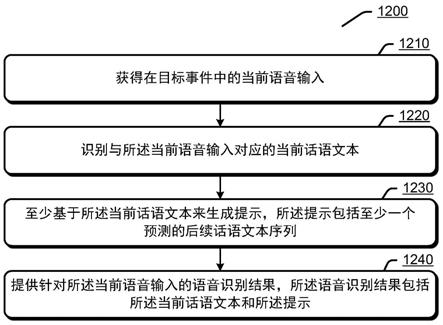

107.图12示出了根据实施例的用于在语音识别结果中实时地提供提示的示例性方法1200的流程。

108.在1210处,可以获得在针对目标事件的音频流中的当前语音输入。

109.在1220处,可以识别与所述当前语音输入对应的当前话语文本。

110.在1230处,可以至少基于所述当前话语文本来生成提示,所述提示包括至少一个预测的后续话语文本序列。

111.在1240处,可以提供针对所述当前语音输入的语音识别结果,所述语音识别结果包括所述当前话语文本和所述提示。

112.在一种实现方式中,所述当前话语文本可以包括一个或多个词语,每个预测的后续话语文本序列可以包括一个或多个预测的后续话语文本,并且每个预测的后续话语文本可以包括一个或多个词语。

113.在一种实现方式中,所述提示可以是进一步基于在所述当前话语文本之前识别的至少一个先前话语文本来生成的。

114.在一种实现方式中,方法1200还可以包括:获得所述目标事件的事件id和/或所述当前语音输入的讲话者的讲话者id。所述提示可以是进一步基于所述事件id和/或所述讲话者id来生成的。

115.在一种实现方式中,所述生成提示可以包括:通过预先建立的提示生成器,至少基于所述当前话语文本来预测所述至少一个预测的后续话语文本序列。

116.所述提示生成器可以是基于神经网络模型的。

117.所述提示生成器可以是基于相关性矩阵的。所述相关性矩阵可以包括多个文本项以及在所述多个文本项之间的相关性值。所述预测所述至少一个预测的后续话语文本序列可以包括:至少基于所述当前话语文本,从所述多个文本项中选择相关性排序最高的至少一个文本项序列。

118.方法1200还可以包括:获得与所述目标事件相关联的至少一个文档;以及至少基于所述至少一个文档来建立所述提示生成器。

119.方法1200还可以包括:获得与所述目标事件相关联的事件信息,所述事件信息包括以下至少之一:所述目标事件的事件id、所述目标事件的时间信息、所述目标事件的议程、所述目标事件的参与者的参与者id、以及与所述至少一个文档相关联的讲话者的讲话者id。所述提示生成器可以是进一步基于所述事件信息来建立的。

120.方法1200还可以包括:获得与多个事件和/或多个讲话者相关联的多个文档;以及至少基于所述多个文档来建立所述提示生成器。方法1200还可以包括:获得与所述多个事件分别关联的事件信息和/或与所述多个讲话者分别对应的多个讲话者id。所述提示生成器可以是进一步基于所述事件信息和/或所述多个讲话者id来建立的。

121.在一种实现方式中,所述当前话语文本和所述提示可以是以不同呈现方式提供的。

122.在一种实现方式中,方法1200还可以包括:获得在所述音频流中的、在所述当前语音输入之后的第二语音输入;识别与所述第二语音输入对应的第二话语文本;将所述第二话语文本与所述至少一个预测的后续话语文本序列进行比较;至少基于所述第二话语文本和/或所述比较的结果来生成第二提示;以及提供针对所述第二语音输入的语音识别结果,所述语音识别结果包括所述第二话语文本和所述第二提示。

123.在一种实现方式中,方法1200还可以包括:确定所述当前话语文本和/或所述提示的相关信息。所述语音识别结果还可以包括所述相关信息。

124.应当理解,方法1200还可以包括根据上述本公开实施例的用于在语音识别结果中

实时地提供提示的任何步骤/过程。

125.图13示出了根据实施例的用于在语音识别结果中实时地提供提示的示例性装置1300。

126.装置1300可以包括:语音输入获得模块1310,用于获得在针对目标事件的音频流中的当前语音输入;话语文本识别模块1320,用于识别与所述当前语音输入对应的当前话语文本;提示生成模块1330,用于至少基于所述当前话语文本来生成提示,所述提示包括至少一个预测的后续话语文本序列;以及语音识别结果提供模块1340,用于提供针对所述当前语音输入的语音识别结果,所述语音识别结果包括所述当前话语文本和所述提示。

127.在一种实现方式中,装置1300还可以包括:标识获得模块,用于获得所述目标事件的事件id和/或所述当前语音输入的讲话者的讲话者id。所述提示可以是进一步基于所述事件id和/或所述讲话者id来生成的。

128.在一种实现方式中,所述提示生成模块可以用于:通过预先建立的提示生成器,至少基于所述当前话语文本来预测所述至少一个预测的后续话语文本序列。

129.装置1300还可以包括:文档获得模块,用于获得与所述目标事件相关联的至少一个文档;以及提示生成器建立模块,用于至少基于所述至少一个文档来建立所述提示生成器。

130.此外,装置1300还可以包括执行根据上述本公开实施例的用于在语音识别结果中实时地提供提示的方法的步骤的任何其它模块。

131.图14示出了根据实施例的用于在语音识别结果中实时地提供提示的示例性装置1400。

132.装置1400可以包括:至少一个处理器1410;以及存储器1420,其存储计算机可执行指令。当所述计算机可执行指令被执行时,所述至少一个处理器1410可以:获得在针对目标事件的音频流中的当前语音输入;识别与所述当前语音输入对应的当前话语文本;至少基于所述当前话语文本来生成提示,所述提示包括至少一个预测的后续话语文本序列;以及提供针对所述当前语音输入的语音识别结果,所述语音识别结果包括所述当前话语文本和所述提示。此外,处理器1410还可以执行根据上述本公开实施例的用于在语音识别结果中实时地提供提示的方法的任何其它步骤/过程。

133.本公开的实施例可以实施在非暂时性计算机可读介质中。该非暂时性计算机可读介质可以包括指令,当所述指令被执行时,使得一个或多个处理器执行根据上述本公开实施例的用于在语音识别结果中实时地提供提示的方法的任何操作。

134.应当理解,以上描述的方法中的所有操作都仅仅是示例性的,本公开并不限制于方法中的任何操作或这些操作的顺序,而是应当涵盖在相同或相似构思下的所有其它等同变换。

135.还应当理解,以上描述的装置中的所有模块都可以通过各种方式来实施。这些模块可以被实施为硬件、软件、或其组合。此外,这些模块中的任何模块可以在功能上被进一步划分成子模块或组合在一起。

136.已经结合各种装置和方法描述了处理器。这些处理器可以使用电子硬件、计算机软件或其任意组合来实施。这些处理器是实施为硬件还是软件将取决于具体的应用以及施加在系统上的总体设计约束。作为示例,本公开中给出的处理器、处理器的任意部分、或者

处理器的任意组合可以实施为微处理器、微控制器、数字信号处理器(dsp)、现场可编程门阵列(fpga)、可编程逻辑器件(pld)、状态机、门逻辑、分立硬件电路、以及配置用于执行在本公开中描述的各种功能的其它适合的处理部件。本公开给出的处理器、处理器的任意部分、或者处理器的任意组合的功能可以实施为由微处理器、微控制器、dsp或其它适合的平台所执行的软件。

137.软件应当被广泛地视为表示指令、指令集、代码、代码段、程序代码、程序、子程序、软件模块、应用、软件应用、软件包、例程、子例程、对象、运行线程、过程、函数等。软件可以驻留在计算机可读介质中。计算机可读介质可以包括例如存储器,存储器可以例如为磁性存储设备(如,硬盘、软盘、磁条)、光盘、智能卡、闪存设备、随机存取存储器(ram)、只读存储器(rom)、可编程rom(prom)、可擦除prom(eprom)、电可擦除prom(eeprom)、寄存器或者可移动盘。尽管在本公开给出的多个方面中将存储器示出为是与处理器分离的,但是存储器也可以位于处理器内部(如,缓存或寄存器)。

138.以上描述被提供用于使得本领域任何技术人员可以实施本文所描述的各个方面。这些方面的各种修改对于本领域技术人员是显而易见的,本文限定的一般性原理可以应用于其它方面。因此,权利要求并非旨在被局限于本文示出的方面。关于本领域技术人员已知或即将获知的、对本公开所描述各个方面的元素的所有结构和功能上的等同变换,都将由权利要求所覆盖。