1.本发明涉及通信技术领域,特别涉及为一种语音识别处理视频会议系统及方法。

背景技术:

2.随着通信技术的发展,会议的形式逐渐向多元化发展;现在的会议形式不仅包括传统的单点会议,还包括多点视频会议、多点语音会议等;其中,单点会议是指在单个物理地点进行的会议,多点会议是指在不同的物理地点进行的、通过音频通信和/或视频通信等方式建立的实时会议,并且通常每个物理地点会有不同的会议参与人员。

3.目前的视频会议系统参会者可以实时同步看到和听到其他会场的参会人员图像和声音,还可以实时发送电子文档,极大地降低了会议成本,压缩了会议时间。

4.但是在现有技术中,视频会议生成的语音通常会由于各种突如其来的情况而产生识别干扰,对视频会议记录的整个过程带来不便利,例如视频会议过程中会议屏幕伴生的翻译语言和翻译文字出现偏差。

5.鉴于此,针对以上背景技术提出的问题,本发明提供一种语音识别处理视频会议系统及方法,以解决视频会议过程中会议屏幕伴生的翻译语言和翻译文字出现偏差的问题。

技术实现要素:

6.本发明旨在解决视频会议过程中会议屏幕伴生的翻译语言和翻译文字出现偏差的问题,提供一种语音识别处理视频会议系统及方法。

7.本发明提供一种语音识别处理视频会议系统,包括:获取模块,用于获取会议人物特征,所述会议人物特征包括为次要人物特征和重要人物特征;收录所述会议次要人物语音和会议重要人物语音,其中,所述会议次要人物语音和会议重要人物语音,包括为人物音色和人物语句;识别模块,用于识别所述会议次要人物语音和会议重要人物语音,得到收录语音的语句数据格式,根据所述语句数据格式列出所述会议次要人物和会议重要人物的语句数据表单,根据所述会议人物语句数据表单分类单一语句和连续语句的文本格式;将所述会议次要人物和会议重要人物语句数据表单中的语句数据特征转化进行语音分类并输入至预设有的会议屏幕上,进而得到语音识别处理完成的语音数据。

8.进一步地,获取模块还包括:获取子单元,用于获取会议人物特征,所述会议人物特征包括为次要人物特征和重要人物特征;收录子单元,用于收录所述会议次要人物语音和会议重要人物语音,其中,所述会议次要人物语音和会议重要人物语音,包括为人物音色和人物语句。

9.进一步地,识别模块还包括:识别子单元,用于识别所述会议次要人物语音和会议重要人物语音,得到收录语

音的语句数据格式,根据所述语句数据格式列出所述会议次要人物和会议重要人物的语句数据表单,根据所述会议次要人物和会议重要人物的语句数据表单分类单一语句和连续语句的文本格式;;推算子单元,用于将所述会议次要人物和会议重要人物语句数据表单中的语句数据特征转化进行语音分类并输入至预设有的会议屏幕上,进而得到语音识别处理完成的语音数据。

10.本发明还提供一种语音识别处理视频会议方法,包括:获取会议人物特征,所述会议人物特征包括为次要人物特征和重要人物特征;收录所述会议次要人物语音和会议重要人物语音,其中,所述会议次要人物语音和会议重要人物语音,包括为人物音色和人物语句;识别所述会议次要人物语音和会议重要人物语音,得到收录语音的语句数据格式,根据所述语句数据格式列出所述会议次要人物和会议重要人物的语句数据表单,根据所述会议次要人物和会议重要人物的语句数据表单分类单一语句和连续语句的文本格式;将所述会议次要人物和会议重要人物语句数据表单中的语句数据特征转化进行语音分类并输入至预设有的会议屏幕上,进而得到语音识别处理完成的语音数据;其中,语句数据格式转化具体过程为:系统把语句数据与系统自设有的模型化声音数据进行比对,匹配相似度的声音数据,进行语音分类提取声音数据的声学特征。

11.进一步地,获取会议人物特征包括为次要人物特征和重要人物特征的步骤前还包括:根据预设有的会议人物表单,标识所有参加会议人物;取得参加会议人物信息,所述会议人物信息包括为人物衣着、人物身形和人物脸部;根据所述会议人物信息,匹配并分类所述会议人物包括为会议次要人物和会议重要人物。

12.进一步地,收录所述会议次要人物语音和会议重要人物语音的步骤后还包括:根据所述收录会议次要人物语音和会议重要人物语音,采用预设有的语句编码器,获取所述会议次要人物语音和会议重要人物语音解析编码后的语句数据向量,所述语句数据向量包括为语句文本模型、语句文本特征和语句文本类型;对所述语句数据向量进行向量分词,得到若干向量分词包括为语句的token串和词法的token串;将所述语句的token串和词法的token串分别列为第一文本向量和第二文本向量。

13.进一步地,识别会议次要人物语音和会议重要人物语音的步骤包括:将所述收录会议次要人物语音和会议重要人物语音生成语音向量类别包括为语音频率、语音滤波和语音译码,根据所述收录语音对所述语音频率进行取样,且取样的量为所述语音频率的一半,得到取样完成的语音滤波;根据所述语音滤波通过采样得到波形数据后,提取波形数据特征参数,通过所述系统预设有的语音译码将波形数据特征参数进行参数合成,得到可识别的收录语音。

14.进一步地,分类单一语句和连续语句的文本格式的步骤包括:

根据预设有的文本内容限量,限定所述语句的文本内容范围为五十个字以内或五十个字以上,采用公式表示为或;查看记录完成的语句数据表单,并根据所述语句数据表单,选中上述文本内容范围为的文本内容为单一语句;选中上述文本内容范围为为连续语句。

15.进一步地,单一语句进行分类的步骤包括:采用预设于所述语句数据推算层的文本内容整理,获取所述单一语句的语句数据特征向量;通过集成得到语句数据中不同潜在因素映射到单个文本的特征向量表示;通过迭代的方法更新在每个潜在因素上语句数据特征向量与单个文本特征向量相连接的次数;整合所述语句数据特征向量,得到推算完成的单一语句数据。

16.进一步地,连续语句进行语音分类的步骤包括:连续语句进行分类的步骤包括:采用预设于所述语句数据推算层的文本内容整理,获取所述连续语句的语句数据特征向量;通过集成得到语句数据中不同潜在因素映射到多个文本的特征向量表示;通过迭代的方法更新在每个潜在因素上语句数据特征向量与多个文本特征向量相连接的次数;整合所述语句数据特征向量总和,得到推算完成的连续语句数据。

17.本发明提供了一种语音识别处理视频会议系统及方法,具有以下有益效果:本发明通过修正语音识别翻译转化过程中可能出现重复或无效数据,有效降低了语音会议的过程中出现翻译错误的问题。

附图说明

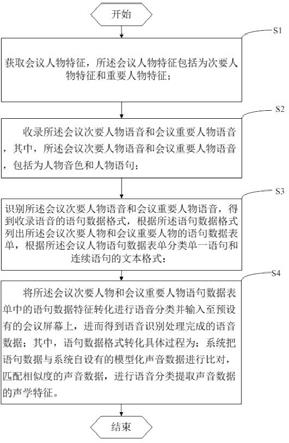

18.图1为本发明一种语音识别处理视频会议系统一个实施例的结构框图;图2为本发明一种语音识别处理视频会议方法一个实施例的工作流程图。

具体实施方式

19.应当理解,此处所描述的具体实施例仅仅用以解释本发明,并不用于限定本发明,本发明为目的的实现、功能特点及优点将结合实施例,参照附图做进一步说明。

20.下面将结合本发明的实施例中的附图,对本发明的实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本发明的一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域次要技术人员在没有作出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

21.参考附图1,为本发明一实施例中的一种语音识别处理视频会议系统,获取模块,用于获取会议人物特征包括为次要人物特征和重要人物特征;收录所述会议次要人物语音和会议重要人物语音;识别模块,用于识别所述会议次要人物语音和会议重要人物语音,得到收录语音

的语句数据格式,根据所述语句数据格式列出所述会议次要人物和会议重要人物的语句数据表单,根据所述会议人物语句数据表单分类单一语句和连续语句的文本格式;将所述会议次要人物和会议重要人物语句数据表单中的语句数据特征转化进行语音分类并输入至预设有的会议屏幕上,进而得到语音识别处理完成的语音数据。

22.在具体实施例中:获取模块获取会议人物特征包括为次要人物特征和重要人物特征;收录所述会议次要人物语音和会议重要人物语音;识别模块识别所述会议次要人物语音和会议重要人物语音,得到收录语音的语句数据格式,根据所述语句数据格式列出所述会议次要人物和会议重要人物的语句数据表单,根据所述会议人物语句数据表单分类单一语句和连续语句的文本格式;将所述会议次要人物和会议重要人物语句数据表单中的语句数据特征转化进行语音分类并输入至预设有的会议屏幕上,进而得到语音识别处理完成的语音数据;其中,人物特征具体为:会议次要人物和会议重要人物的声音特征,声音特征包括为每个人物发出不同的音调和波长;人物语音具体为会议中每个人物的语句音色和响度;语句数据格式具体为:会议中每个人物的语音信号分帧,要分帧是因为语音信号是快速变化;在语音识别中,一般帧长为20~50ms,这样一帧内既有足够多的周期,又不会变化太剧烈;每帧语音信号通常要与下一帧语音信号相乘,让帧两端平滑地衰减到零,这样就可以降低语音变换后的强度,取得更高的质量频谱,帧与帧之间的时间差一般取10s,这样帧与帧之间会产生重叠,使得帧与帧连接处的信号不因为失去信号重叠从而丢失该部分语音信息;单一语句的文本格式具体为:会议中的每个人物产生的短时或瞬间语音数据,例如:人物发出的语气词,“额”、“嗯”、“是的”和“对”;连续语句的文本格式具体为:会议中的每个人物产生的长时或长串语音数据,例如:人物发出的开场白,“女士们先生们大家好,欢迎来到这里参加会议

……”

;语音数据表单具体为:会议次要人物和会议重要人物的整个会议过程中产生的所有语音数据,包括会议过程前、会议过程中和会议过程后的语音数据,并将会议过程前、会议过程中和会议过程后的语音数据按顺序重新整合得到语音数据表单;语音分类具体为:提取系统数据库中声音数据的声学特征,包括语句中的词序列、位置编码、音素序列和音素特征,将词序列、位置编码、音素序列和音素特征拼接从而得到词声学特征;语句数据特征转化的具体过程为:获取语音数据的文本向量及其token串,合并为文本token集,并识别文本token集中字符串的字符特征,构建字符特征相应的字符向量,重新合并文本token集的字符向量集;对重整合并后的字符向量集进行相似剔除,得到语音分类完成的语音数据,具体包括为:不同语音间的转换;例如:英语转换为中文,中文转换为英语;其中,对重整合并后的字符向量集进行相似剔除具体为将组建后的词语加入至token集中的字符串中,搜寻token集中的字符串中是否存在有相同字符串或相同字符串的向量,对同一相同字符串或字符串向量进行对应删除并修正。

23.参考附图2,为本发明一实施例中语音识别处理视频会议方法,s1:获取会议人物特征,所述会议人物特征包括为次要人物特征和重要人物特征;

s2:收录所述会议次要人物语音和会议重要人物语音,其中,所述会议次要人物语音和会议重要人物语音,包括为人物音色和人物语句;s3:识别所述会议次要人物语音和会议重要人物语音,得到收录语音的语句数据格式,根据所述语句数据格式列出所述会议次要人物和会议重要人物的语句数据表单,根据所述会议次要人物和会议重要人物的语句数据表单分类单一语句和连续语句的文本格式;s4:将所述会议次要人物和会议重要人物语句数据表单中的语句数据特征转化进行语音分类并输入至预设有的会议屏幕上,进而得到语音识别处理完成的语音数据;其中,语句数据格式转化具体过程为:系统把语句数据与系统自设有的模型化声音数据进行比对,匹配相似度的声音数据,进行语音分类提取声音数据的声学特征。

24.在具体实施例中:获取会议人物特征,收录所述会议次要人物语音和会议重要人物语音,识别所述会议次要人物语音和会议重要人物语音,得到收录语音的语句数据格式,根据所述语句数据格式列出所述会议次要人物和会议重要人物的语句数据表单,根据所述会议人物语句数据表单分类单一语句和连续语句的文本格式,将所述会议次要人物和会议重要人物语句数据表单中的语句数据特征转化进行语音分类并输入至预设有的会议屏幕上,进而得到语音识别处理完成的语音数据。

25.在一个实施例中:获取会议人物特征包括为次要人物特征和重要人物特征的步骤前还包括:根据预设有的会议人物表单,标识所有参加会议人物;取得参加会议人物信息,所述会议人物信息包括为人物衣着、人物身形和人物脸部;根据所述会议人物信息,匹配并分类所述会议人物包括为会议次要人物和会议重要人物。

26.在具体实施例中:捕捉参加会议的所有人物,根据会议人物的人物衣着、人物身形和人物脸部,与预设有的会议参与人员做适配比对,以此判别参加会议中的人物中的次要人物和重要人物;并根据判别出来的人物做相应的匹配操作以及分类,将没有穿着会议服装的人物判别为次要人物,例如:打扫卫生的清洁工或整理会议过程秘书;将穿着会议服装的人物判别的重要人物,例如:穿着会议服装和佩戴工牌的经理或引领会议过程的ceo。

27.在一个实施例中:所述收录所述会议次要人物语音和会议重要人物语音的步骤后还包括:根据所述收录会议次要人物语音和会议重要人物语音,采用预设有的语句编码器,获取所述会议次要人物语音和会议重要人物语音解析编码后的语句数据向量,所述语句数据向量包括为语句文本模型、语句文本特征和语句文本类型;对所述语句数据向量进行向量分词,得到若干向量分词包括为语句的token串和词法的token串;将所述语句的token串和词法的token串分别列为第一文本向量和第二文本向量。

28.在具体实施例中:对会议人物语音采用预设有的语句编码器进行语音编码解析,

得到语句数据向量具体为语句文本模型、语句文本特征和语句文本类型;将语句文本模型、语句文本特征和语句文本类型进行向量分词,得到若干向量分词包括为语句的token串和词法的token串;其中,语音编码解析具体为通过类型为audio且频宽为5.3kbps的双速率语音编码算法对音频信号进行压缩和解压缩,由于采用了执行不连续传输的静音压缩,除了可以预留宽带外,同时也避免了载波信号的时通时断;向量分词具体为将语句数据中的token词转化为合并成token串,例如:把语句数据中的单个字转化为语句,“欢”“迎”“大”“家”“参”“加”“会”“议”,合并为“欢迎大家参加会议”。

29.在一个实施例中:所述识别会议次要人物语音和会议重要人物语音的步骤包括:将所述会议次要人物语音和会议重要人物语音生成语音向量类别包括为语音频率、语音滤波和语音译码,根据所述收录语音对所述语音频率进行取样,且取样的量为所述语音频率的一半,得到取样完成的语音滤波;根据所述语音滤波通过采样得到波形数据后,提取波形数据特征参数,通过所述系统预设有的语音译码将波形数据特征参数进行参数合成,得到可识别的收录语音。

30.在具体实施例中:将收录语音生成语音向量类别,包括语音频率、语音滤波和语音译码;对收录语音的频率进行样本取样,取语音频率中的半数,得到取样完成的语音滤波;将取样完成的语音滤波通过采集其中的样本获得波形数据,并提取波形数据的特征参数,结合语音译码配合波形数据的特征参数进行参数合成,得到可识别的收录语音;其中,对语音频率的采样过程具体为采集语音频率中波长较为特殊的频率,例如:产生语音过程中较为昂扬的语音则频率会与其他语音频率稍有不同,则为特殊频率;提取波形数据的特征参数具体为依据产生语音过程中的特殊频率语音按时间先后顺序记录,取时间顺序为至后的特殊频率为特征参数;系统预设有的语音译码配合波形数据特征参数进行参数合成的过程具体为针对每一帧语音数据的译码改变一次参数,对于语音较为浑浊的频率段,根据控制参数改变时刻的选取不同,进行帧同步合成;帧同步合成指的是按帧改变参数。

31.在一个实施例中:分类单一语句和连续语句的文本格式的步骤包括:根据预设有的文本内容限量,限定所述语句的文本内容范围为五十个字以内或五十个字以上,采用公式表示为或;查看记录完成的语句数据表单,并根据所述语句数据表单,选中上述文本内容范围为的文本内容为单一语句;选中上述文本内容范围为为连续语句。

32.在具体实施例中:分别获取单一语句和连续语句的文本格式内容,根据预设定的文本内容限量,对单一语句的文本内容进行范围限量,单一语句的文本内容限量范围具体为;对连续语句的文本内容进行范围限量,连续语句的文本内容限量范围具体为。

33.在一个实施例中:单一语句进行分类的步骤包括:采用预设于所述语句数据推算层的文本内容整理,获取所述单一语句的语句数据

特征向量;通过集成得到语句数据中不同潜在因素映射到文本的特征向量表示;通过迭代的方法更新在每个潜在因素上语句数据特征向量与文本特征向量相连接的次数;整合所述语句数据特征向量,得到推算完成的单一语句数据。

34.在具体实施例中:对单一语句的语句数据进行文本内容的整理,得到单一语句的语句数据特征向量,包括为词序列和位置编码;将词序列和位置编码在语句数据中进行集成,得到其他不同的潜在因素映射文本的特征向量,包括音素序列和音素特征;将语句数据特征向量和潜在因素映射文本的特征向量通过迭代的方法对语句数据进行向量相连,重新整合迭代完成的语句数据,得到推算完成的单一语句数据;其中,集成具体为将词序列和位置编码从语句数据中所有的数据调取出词序列和词序列相应的位置编码;通过迭代对语句数据进行向量相连的过程具体为将词序列和位置编码相对于语句数据中进行索引,映射出不同的潜在因素映射文本的特征向量即音素序列和音素特征;词序列伴生的音素序列所存在的位置编码与音素特征为对称轴的位置编码关系,即词序列的位置编码与音素特征基于语句数据中为坐标的对称位置,将词序列和位置编码与音素序列和音素特征基于语句数据中进行向量的连接,得到分类完成的单个语句数据。

35.在一个实施例中:连续语句进行分类的步骤包括:采用预设于所述语句数据推算层的文本内容整理,获取所述连续语句的语句数据特征向量;通过集成得到语句数据中不同潜在因素映射到多个文本的特征向量表示;通过迭代的方法更新在每个潜在因素上语句数据特征向量与多个文本特征向量相连接的次数;整合所述语句数据特征向量总和,得到推算完成的连续语句数据。

36.在具体实施例中:对连续语句的语句数据进行文本内容的整理,得到连续语句的语句数据特征向量,包括为词序列和位置编码;将词序列和位置编码在语句数据中进行集成,得到其他不同的潜在因素映射多个文本的特征向量,包括若干个音素序列和若干个音素特征;将语句数据特征向量和潜在因素映射多个文本的特征向量通过迭代的方法对语句数据进行向量相连,重新整合迭代完成的语句数据,得到推算完成的连续语句数据;其中,集成具体为将词序列和位置编码从语句数据中所有的数据调取出词序列和词序列相应的位置编码;通过迭代对语句数据进行向量相连的过程具体为将词序列和位置编码相对于语句数据中进行索引,映射出不同的潜在因素映射多个文本的特征向量即若干个音素序列和若干个音素特征;词序列伴生的音素序列所存在的位置编码与音素特征为对称轴的位置编码关系,即词序列的位置编码与音素特征基于语句数据中为坐标的对称位置,将词序列和位置编码与音素序列和音素特征基于语句数据中进行向量的连接,得到分类完成的连续语句数据。

37.尽管已经示出和描述了本发明的实施例,对于本领域的次要技术人员而言,可以理解在不脱离本发明的原理和精神的情况下可以对这些实施例进行多种变化、修改、替换

和变型,本发明的范围由所附权利要求及其等同物限定。